Human Picks

Staff

Criar em volume com IA deixou de ser um problema, mas manter coerência visual de uma imagem para outra ainda pode ser. Em poucos minutos, é possível gerar dezenas de variações, mas o ponto crítico aparece quando nenhuma delas conversa entre si.

No Midjourney, por exemplo, criar uma imagem bonita nunca foi uma questão. O desafio começa no segundo passo: repetir aquela estética com intenção, em escala, de um jeito que funcione dentro de um projeto real.

É exatamente aqui que a maioria dos fluxos criativos trava.

E é também aqui que entra o Style Reference.

O parâmetro --sref permite usar uma imagem como referência de estilo para novas gerações, sem copiar o conteúdo. Em vez de replicar todos os elementos, ele captura o que realmente sustenta a estética: cores, luz, textura, acabamento.

É o tipo de controle esperado em qualquer processo sério de direção de arte, mas que, até pouco tempo atrás, a IA ainda entregava de forma instável.

O --sref não resolve tudo, mas resolve o que transforma imagem em sistema visual.

Abaixo, seis formas práticas de usar o recurso na construção de uma linguagem visual consistente.

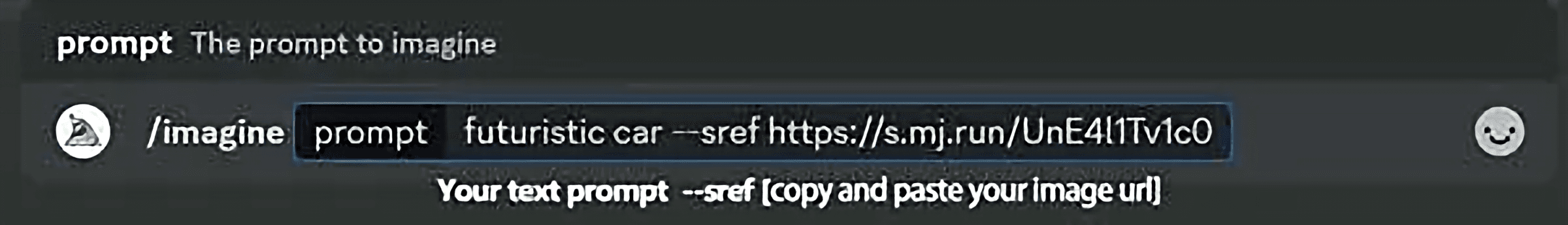

1. Referência única por URL no --sref do Midjourney para consistência visual

A forma mais direta de usar o --sref também é uma das formas mais eficientes quando bem aplicada. Você escolhe uma imagem, coloca em um link público (imagens enviadas no próprio Discord já geram uma URL utilizável) e adiciona a URL ao final do prompt:

/imagine [descrição do conteúdo] --sref [URL da imagem]

Na prática, o Midjourney não tenta copiar a imagem de referência. O que ele faz é mapear o espaço visual dessa imagem e aplicar esses padrões no novo resultado. Diferente de um prompt com imagem tradicional, que busca reproduzir o que está na imagem, o --sref atua na forma como a imagem é construída, não no que aparece nela.

A aplicação mais consistente aqui é simples: usar uma única imagem como base visual de um projeto inteiro. Pode ser uma foto com a iluminação certa, um tratamento de cor já aprovado ou uma cena com o nível de detalhe que o briefing pede.

Mantendo o prompt de texto focado no conteúdo e a referência focada na estética, o resultado fica mais consistente e evita a confusão que surge quando você tenta descrever estilo complexo só com palavras.

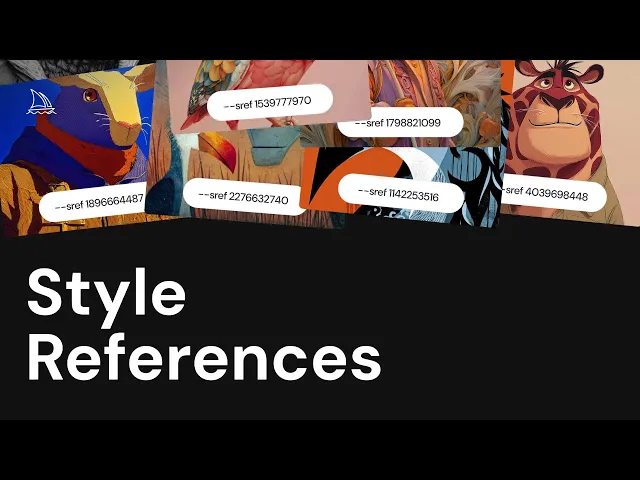

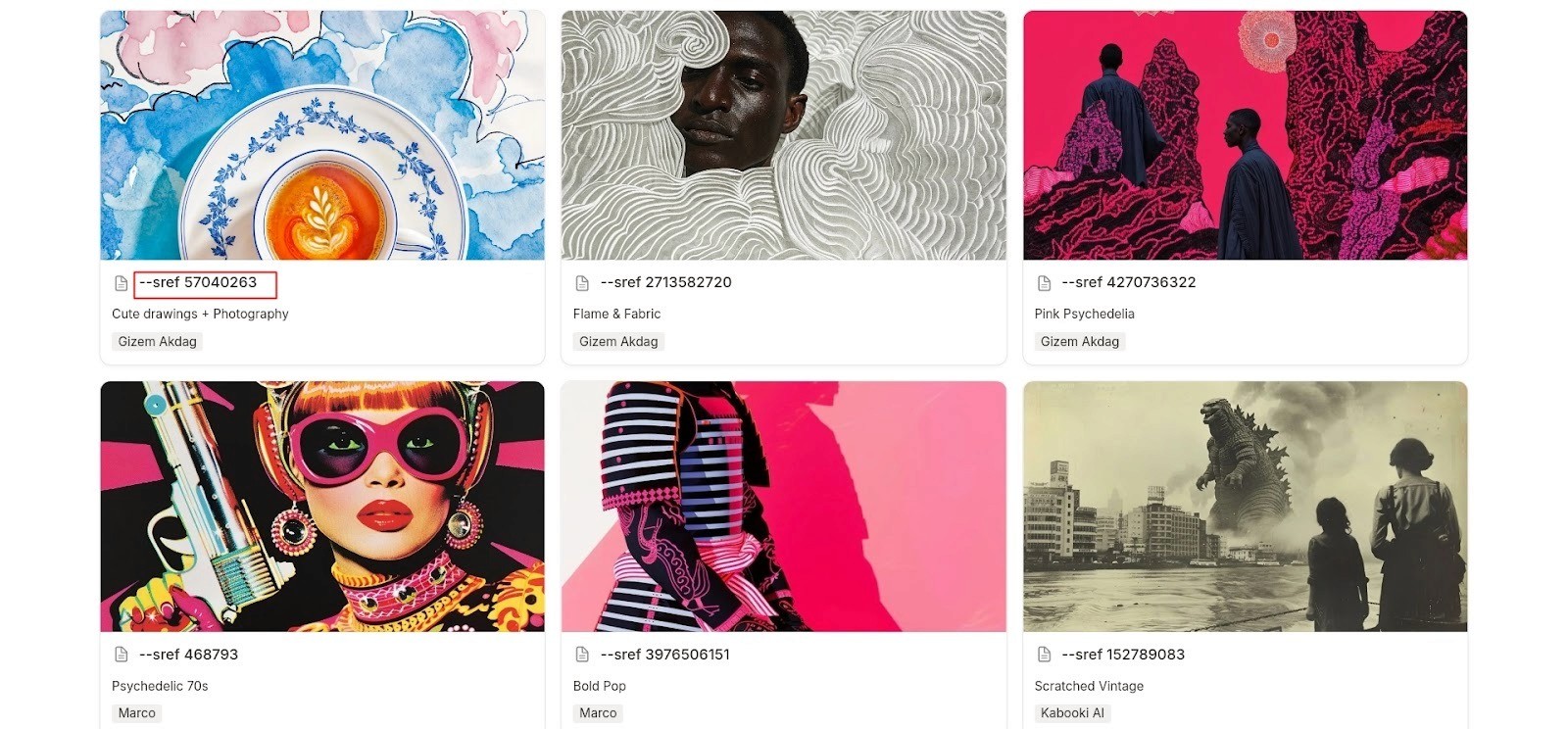

2. Códigos numéricos no --sref do Midjourney como padrão de estilo

O --sref também pode ser usado sem imagem. Em vez de uma URL, você usa um código numérico que já corresponde a um estilo mapeado pelo próprio Midjourney.

Ao usar algo como --sref 1122938831, por exemplo, você acessa uma estética específica sem depender de link externo ou hospedagem de imagem.

Isso facilita muito quando o projeto envolve mais gente ou precisa ser retomado depois. Um código pode ser compartilhado por texto, reaproveitado semanas depois e mantém o padrão visual sem depender de arquivos de referência.

Comunidades como a Midlibrary organizam esses códigos com exemplos visuais, geralmente separados por estilo. Na prática, você encontra um código que conversa com o projeto, testa com variações de prompt e, quando funciona, passa a usar aquilo como base.

Fica mais previsível do que tentar descrever estilo só com texto e torcer pra IA interpretar do mesmo jeito toda vez.

❗ Um ponto importante pra quem usa o V7: muitos desses códigos foram gerados no V6, então o mesmo número pode gerar resultados diferentes dependendo da versão do modelo. Para manter consistência, vale adicionar --sv 4 ao prompt, o que força o uso do padrão de estilo anterior.

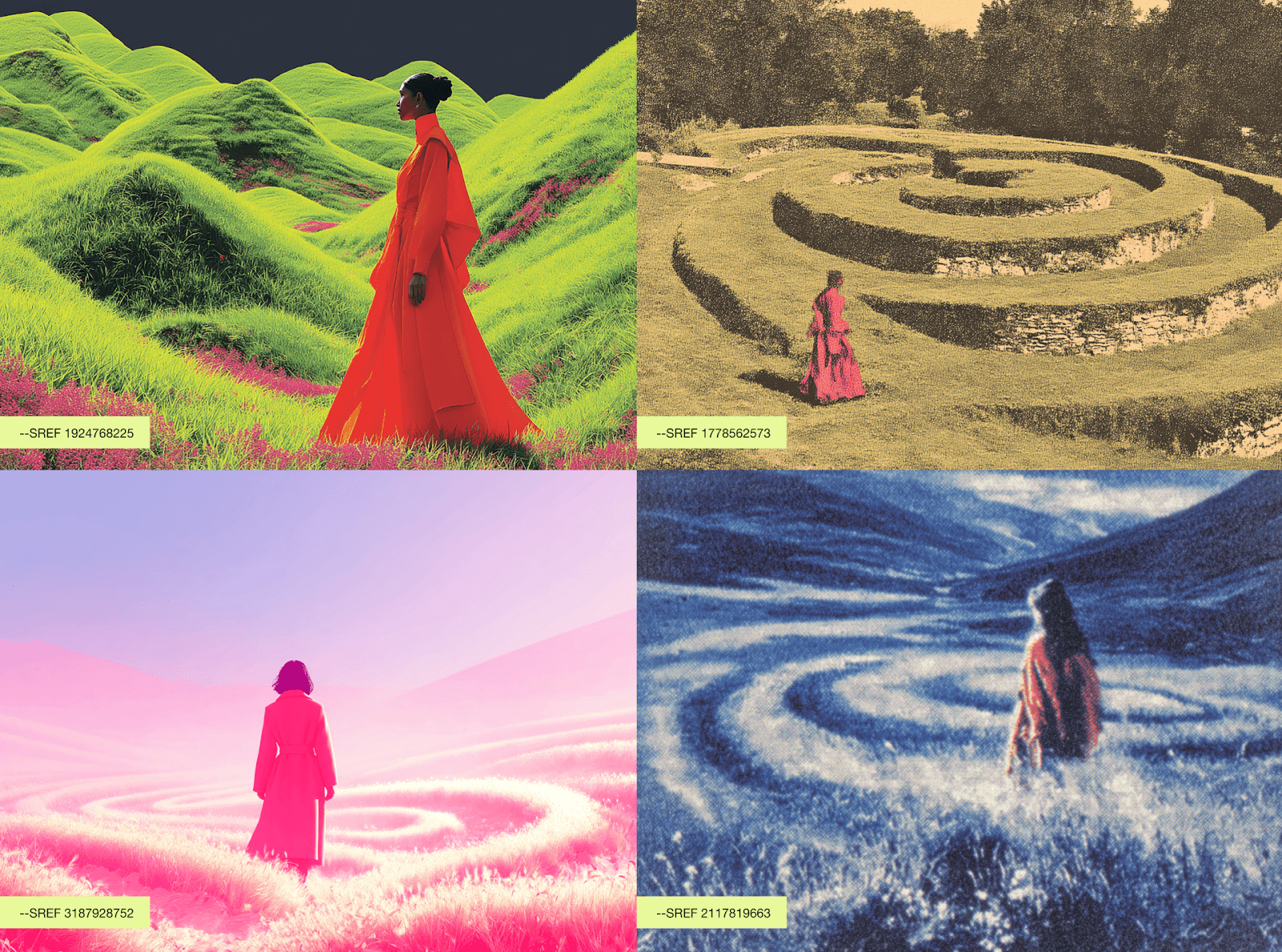

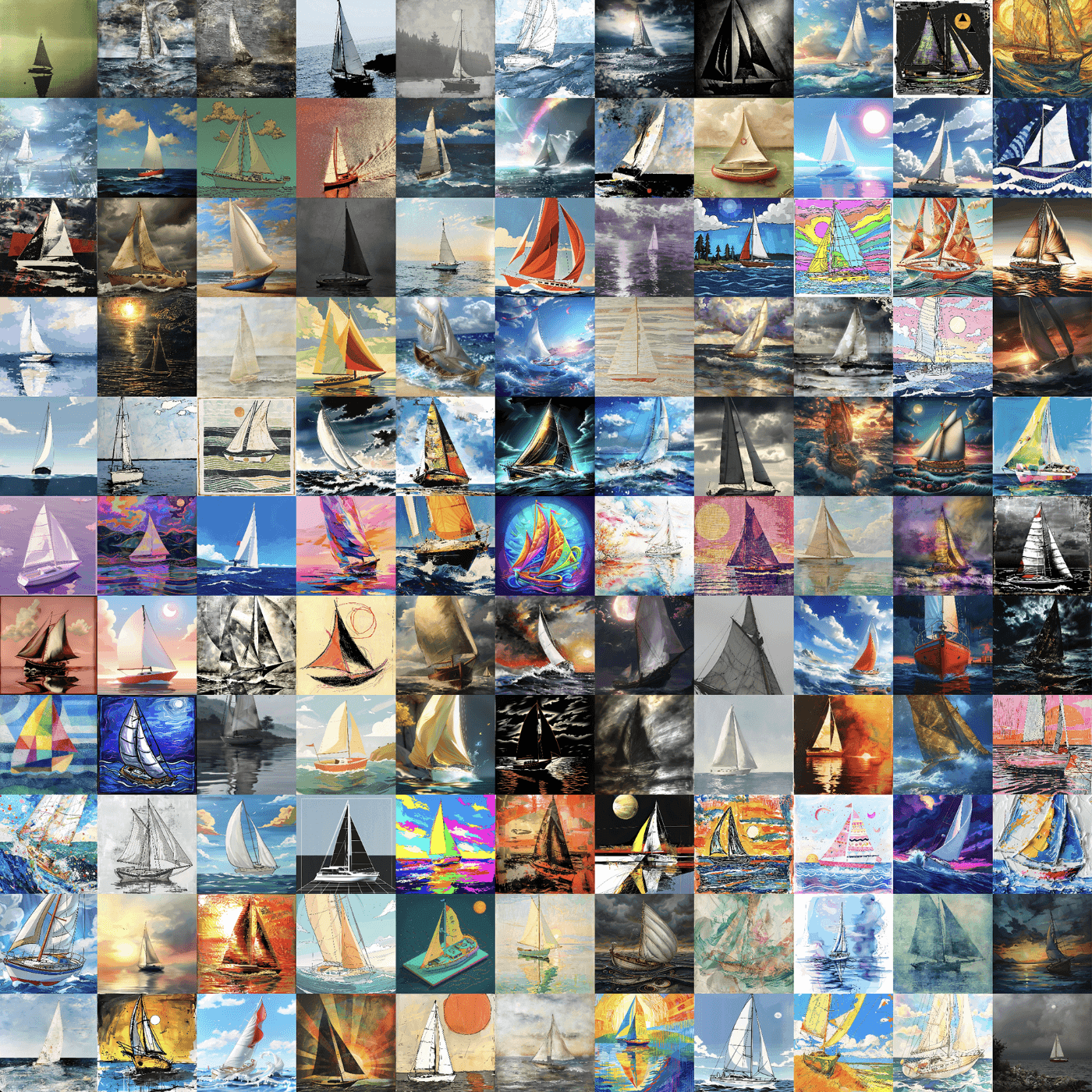

3. Gerar estilos com --sref random e transformar em referência

Quando o projeto ainda não tem uma direção estética clara, escolher uma referência pode acabar travando o processo. É aqui que o --sref random entra.

Em vez de definir um estilo manualmente, você deixa o próprio Midjourney aplicar um código aleatório. No resultado, o “random” é substituído pelo número correspondente àquele estilo.

O ponto que faz isso valer a pena é simples: você pode guardar o que funcionou. Uma estética que surgiu por acaso vira um código que pode ser reutilizado depois.

Se você roda múltiplas variações com --repeat, em poucos minutos já tem uma galeria de caminhos visuais diferentes para explorar, cada um com um estilo que pode ser identificado e repetido.

Não é uma ferramenta para entrega final. Mas, na fase de exploração, resolve um problema comum: sair do óbvio.

Em vez de passar horas buscando referências, você gera possibilidades novas, sem partir diretamente de estilos já conhecidos.

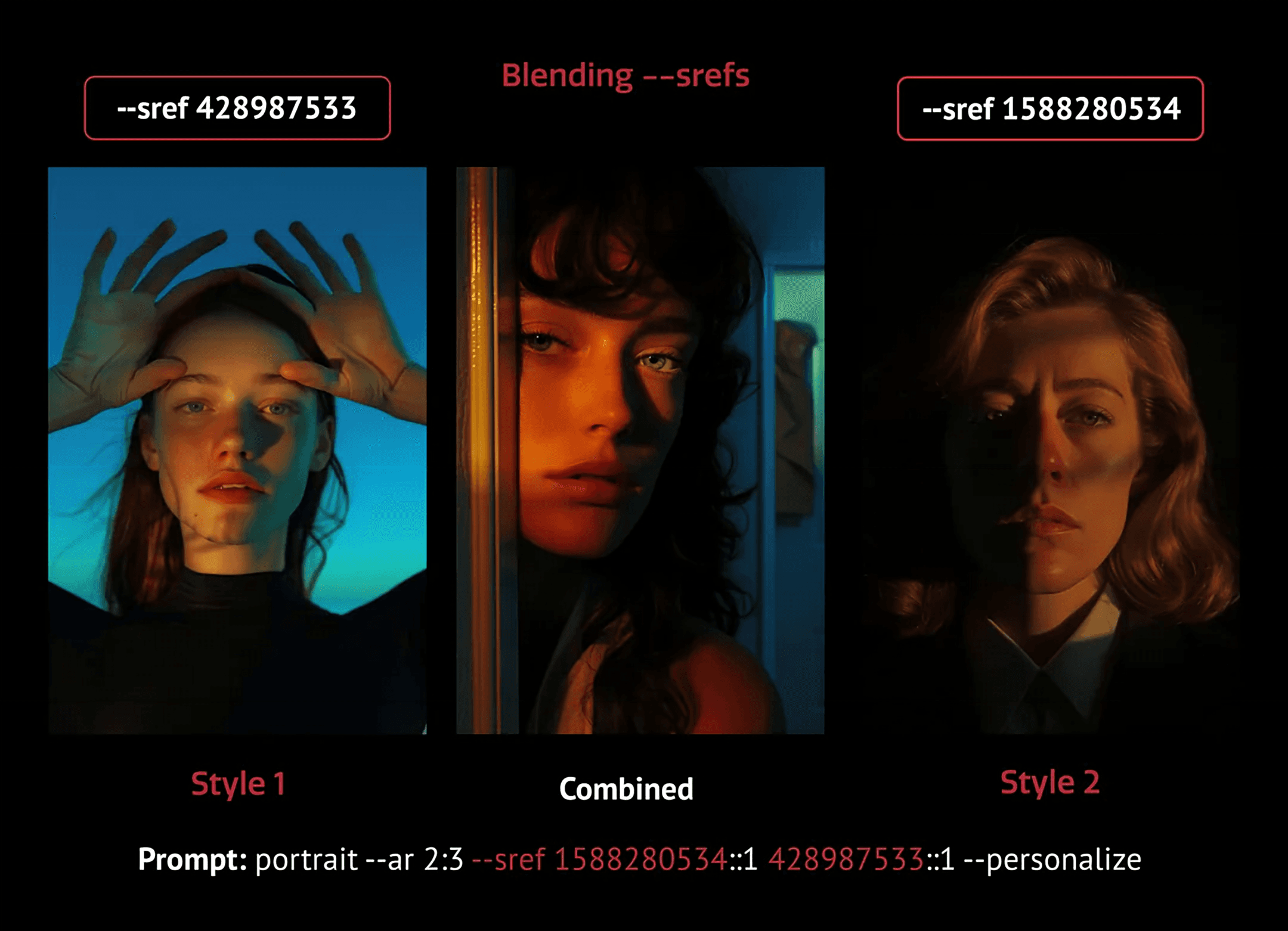

4. Combinação de referências com --sref para criar novos estilos

O --sref também permite usar mais de uma referência ao mesmo tempo. Em vez de escolher um único estilo, você pode combinar dois ou mais e gerar um estilo novo a partir dessa mistura.

Basta adicionar várias URLs ou códigos no mesmo prompt, separados por espaço:

--sref URL1::2 URL2::1

Aqui, a primeira referência influencia mais o resultado do que a segunda. Não é sobre números exatos, mas sobre proporção. Nesse exemplo, a primeira pesa o dobro da segunda, independentemente dos valores usados.

Na prática, isso abre um nível novo de controle. Você pode, por exemplo, usar a paleta de cores de uma imagem e a textura de outra. Ou combinar a luz de uma cena cinematográfica com a construção gráfica de uma ilustração.

Em vez de tentar descrever tudo isso em texto, você mostra ao modelo exatamente o que quer combinar.

Nos testes recentes, a combinação de referências funcionou no Discord, mas apresentou erro na interface web.

Só vale um cuidado: quanto mais referências você adiciona, mais difícil fica manter o resultado estável. Na maioria dos casos, duas ou três já são suficientes. Acima disso, a imagem começa a perder unidade.

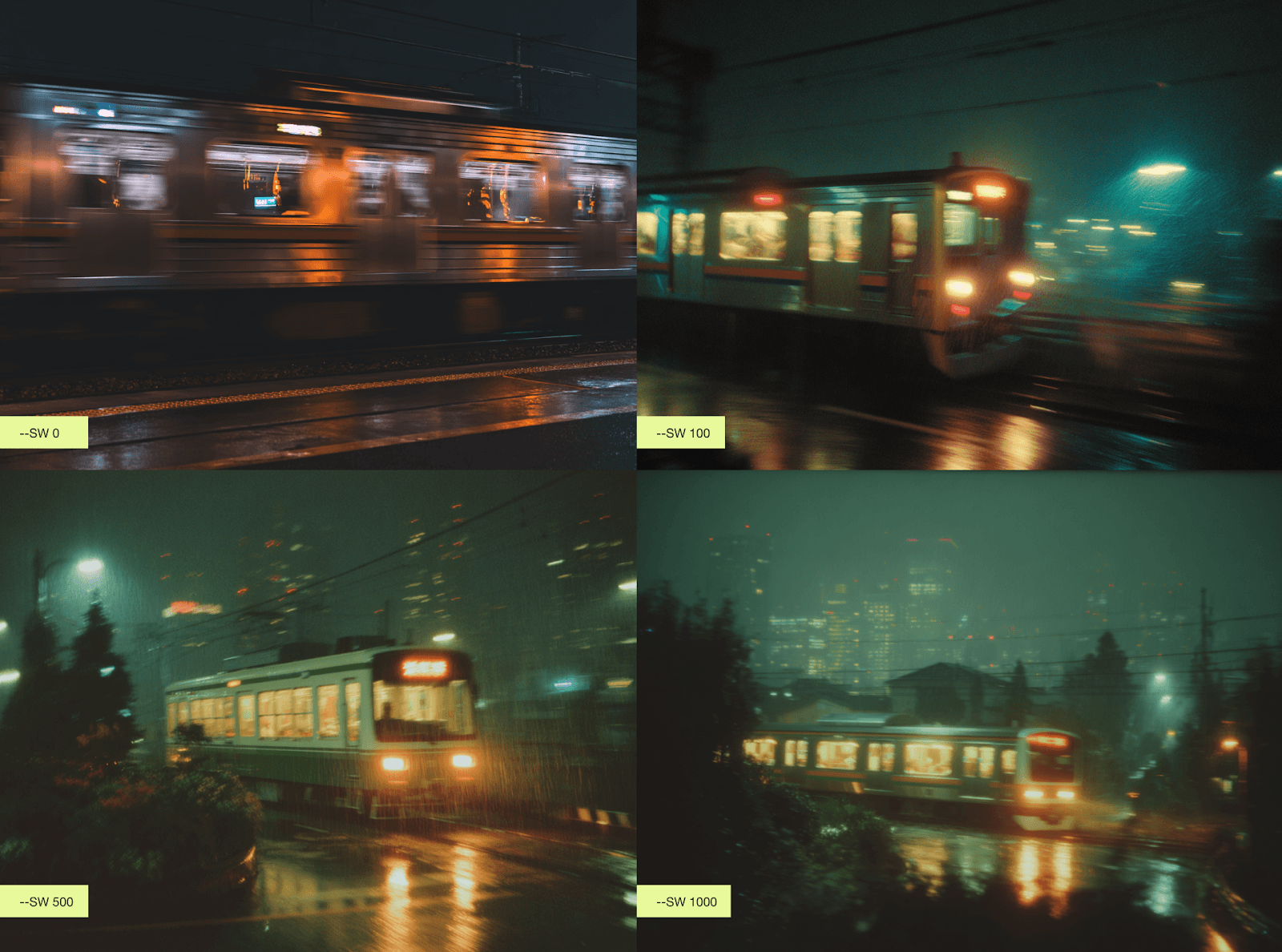

5. Ajustar a intensidade do estilo com Style Weight (--sw)

O --sw define o quanto a referência de estilo influencia o resultado final. Por padrão, ele fica em 100, mas pode variar de 0 a 1000.

Na prática, isso muda bastante o comportamento da imagem.

Com valores mais baixos, como --sw 25 ou --sw 50, o estilo entra de forma mais leve. O modelo segue o prompt com mais liberdade e interpreta a referência sem ficar preso a ela.

Já com valores mais altos, como --sw 800 ou --sw 1000, a referência passa a guiar quase tudo. Mesmo que o texto diga outra coisa, o estilo tende a prevalecer.

Isso faz diferença principalmente em projetos em série. Campanhas com várias peças, coleções de imagens ou qualquer trabalho que precise manter uma aparência consistente se beneficiam de valores mais altos, porque você não precisa reforçar o estilo a cada prompt.

Por outro lado, quando a ideia é testar caminhos e variar mais, reduzir o --sw ajuda a manter essa flexibilidade.

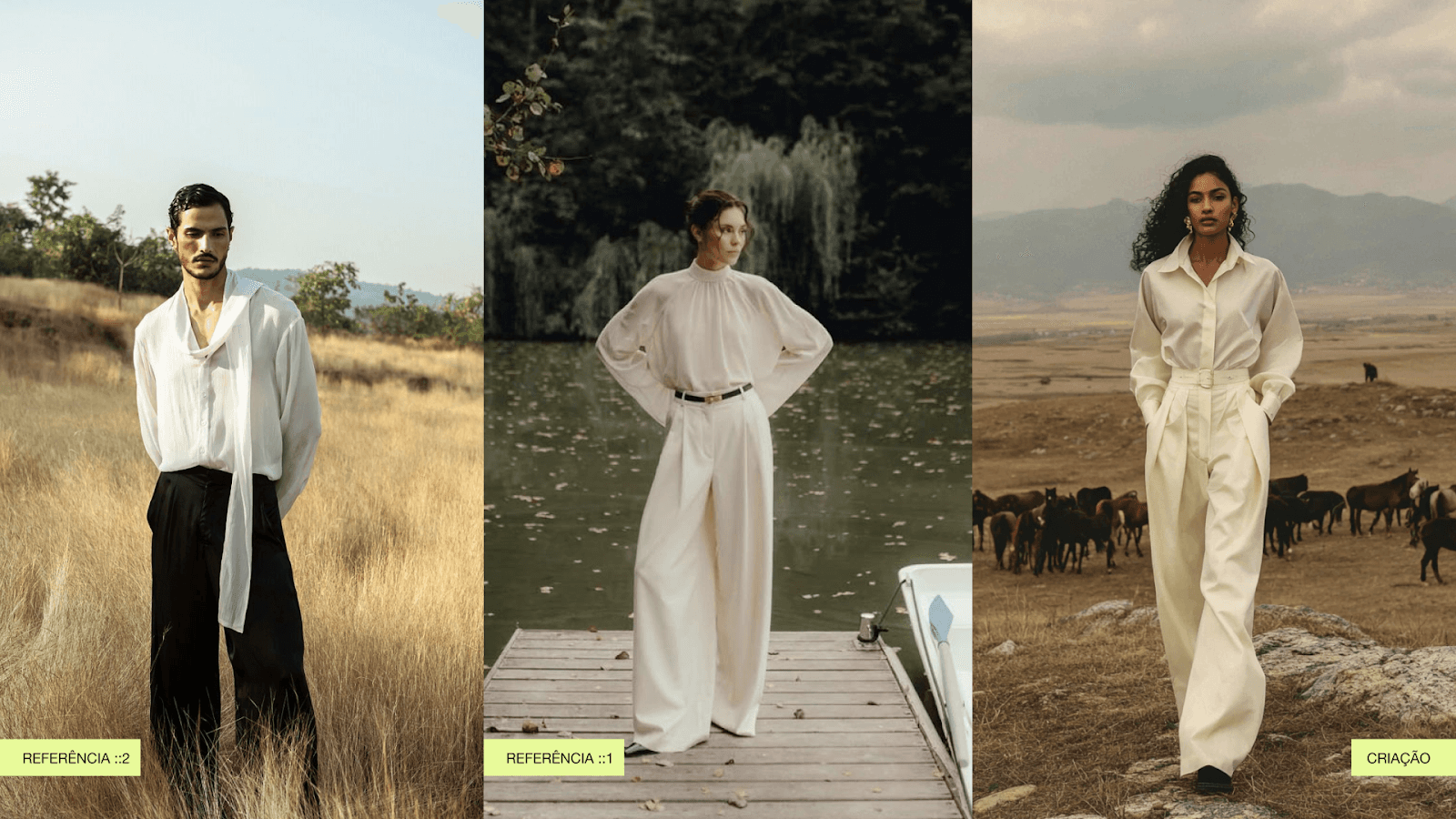

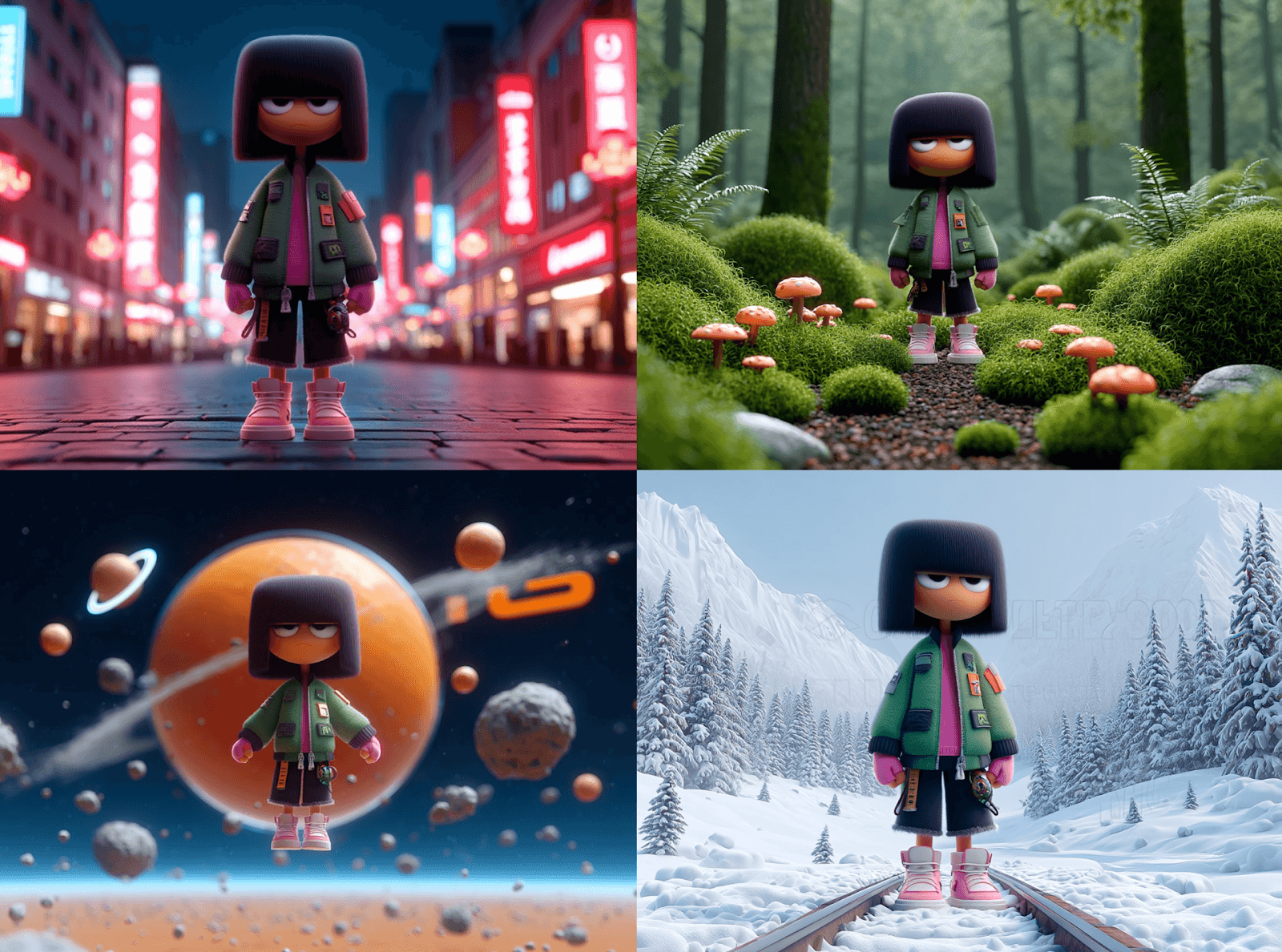

6. Personagem e estilo consistentes com --sref e --oref

O --sref cuida do estilo da imagem. O --oref e o --cref cuidam do personagem. Quando você combina os dois, resolve um dos problemas mais comuns em projetos com IA: manter o mesmo personagem em cenas diferentes sem perder a unidade visual.

No V7, o --oref é o principal parâmetro para consistência de personagem. Ele preserva traços, estrutura e, com --ow 100, até o figurino. No V6, esse papel era do --cref, com --cw 100.

Quando você adiciona o --sref junto, garante que o personagem e o ambiente sigam a mesma linguagem visual. Luz, textura e acabamento passam a conversar entre si.

Isso abre caminho para produzir storyboards, séries editoriais e campanhas com consistência do início ao fim.

Para quem trabalha com ilustração e estética anime, é importante saber que o Niji 7 chegou com melhorias diretas na performance do --sref, oferecendo traços mais definidos e maior fidelidade ao prompt.

Na prática, o estilo referenciado é aplicado com mais consistência entre gerações, facilitando projetos com personagens recorrentes ou séries com identidade visual definida. O --sref random também funciona no Niji 7, mantendo a mesma lógica de captura de código descrita na seção 3.

Um exemplo de prompt com os dois parâmetros:

/imagine [descrição da cena] --oref [URL do personagem] --sref [URL do estilo] --sw 300

Se você ainda usa o V6, basta trocar o --oref por --cref.

Cada parâmetro tem seu próprio controle. O --ow ajusta o quanto o personagem é preservado. O --sw faz o mesmo com o estilo. Isso permite equilibrar os dois sem precisar reescrever todo o prompt.

Leia também: Animação com IA e os novos fluxos de criação com Midjourney e Freepik

Conclusão: o resultado não começa no código, mas no repertório que você traz para a IA

Tratar o Style Reference do Midjourney como filtro é reduzir o que ele realmente faz. Quando usado com critério, ele se torna uma ferramenta de direção criativa. E a diferença entre quem usa esse recurso de forma superficial e quem trabalha com ele de verdade começa na construção da referência visual, muito antes de qualquer prompt.

O mesmo vale para URLs escolhidas na pressa e sem um propósito definido. O --sref só entrega o que promete quando existe uma decisão estética anterior, quando você já sabe qual é a linguagem visual do projeto, de onde ela vem, o que comunica e por que faz sentido naquele contexto.

O --sref executa, mas a qualidade dessa execução é diretamente proporcional ao repertório de quem está por trás. Quanto mais bagagem você tem, mais ele consegue traduzir isso em resultado coerente.

Para quem trabalha com Midjourney de forma contínua, vale acompanhar o que o Midjourney V8 Alpha vem testando em termos de arquitetura de modelo, já que essas mudanças afetam diretamente como parâmetros como o --sref e o --sw se comportam nas próximas versões.

E se o seu processo criativo começa antes da geração, na fase de definir e organizar a linguagem visual de um projeto, vale explorar também a construção de moodboards com IA. É um caminho eficiente para estruturar referências e dar consistência ao que será executado depois.