Human Picks

Staff

A ByteDance lançou o Seedance 2.0 inicialmente na China, em fevereiro de 2026, em um cenário de alta expectativa. O desempenho do beta já circulava entre criadores e levantava discussões sobre um possível salto na geração de vídeo com IA.

O impacto foi imediato: a capacidade de produzir vídeos com qualidade próxima ao padrão hollywoodiano a partir de comandos simples chamou atenção da indústria ao mesmo tempo em que acendeu alertas sobre uso indevido de imagem e possíveis violações de direitos autorais.

Isso acabou pressionando o rollout global, que precisou ser pausado e reconfigurado poucas semanas depois em meio a tensões com a indústria de entretenimento.

No dia 26 de março, o modelo começou a ser liberado para novos mercados via CapCut, incluindo Brasil, México e países da Ásia, África e Oriente Médio.

O resultado é um contraste claro. De um lado, avanços consistentes, especialmente em física de cena, coerência visual e sincronização de áudio. Do outro, um conjunto de restrições que não estavam presentes nas versões iniciais e que mudam o tipo de uso possível na prática.

Ainda assim, o Seedance 2.0 chega com mudanças relevantes, como geração em 1080p, estruturação de múltiplos planos, áudio sincronizado e maior controle por prompt, características que já impactam fluxos reais de produção.

É nesse equilíbrio entre avanço e contenção estratégica que o Seedance 2.0 precisa ser analisado. Mais do que entender o que mudou, o ponto aqui é mapear o que de fato entra no fluxo criativo hoje e o que ainda fica como expectativa.

O que realmente chega no Seedance 2.0

Vídeo com IA mais consistente com áudio sincronizado

Para entender a evolução, vale partir de onde o modelo estava. O Seedance 1.0, lançado em junho de 2025, gerava clipes silenciosos e, na prática, você precisava de várias tentativas até sair algo realmente aproveitável. O 1.5 melhorou a estabilidade e a coerência das cenas, mas ainda tratava áudio e vídeo como coisas separadas, o que limitava a sincronização em produções mais complexas. O 2.0 unifica texto, imagem, áudio e vídeo no mesmo sistema e promete reduzir a quantidade de tentativas até chegar em um bom resultado.

Na prática, som, ambiente e fala já nascem junto com a imagem, o que melhora sincronismo labial, resposta sonora e coerência geral da cena. O modelo suporta mais de oito idiomas nesse processo, incluindo português, e vídeos de até 15 segundos, o que amplia onde ele pode ser usado e o tipo de cena que é possível criar.

Outro ponto importante é o tratamento do movimento. Em vez de montar o vídeo quadro a quadro, o Seedance trabalha a cena como um fluxo contínuo, reduzindo pequenas quebras de fluidez que ainda aparecem em outros modelos.

Referências que dão mais controle ao processo

O Seedance 2.0 permite usar até doze arquivos simultâneos para guiar uma única geração. Entram imagens, vídeos, áudios e o próprio prompt textual, todos organizados dentro do mesmo comando. Cada elemento pode ser ativado diretamente no prompt com o símbolo “@”, como em @image1, @video2 ou @audio3.

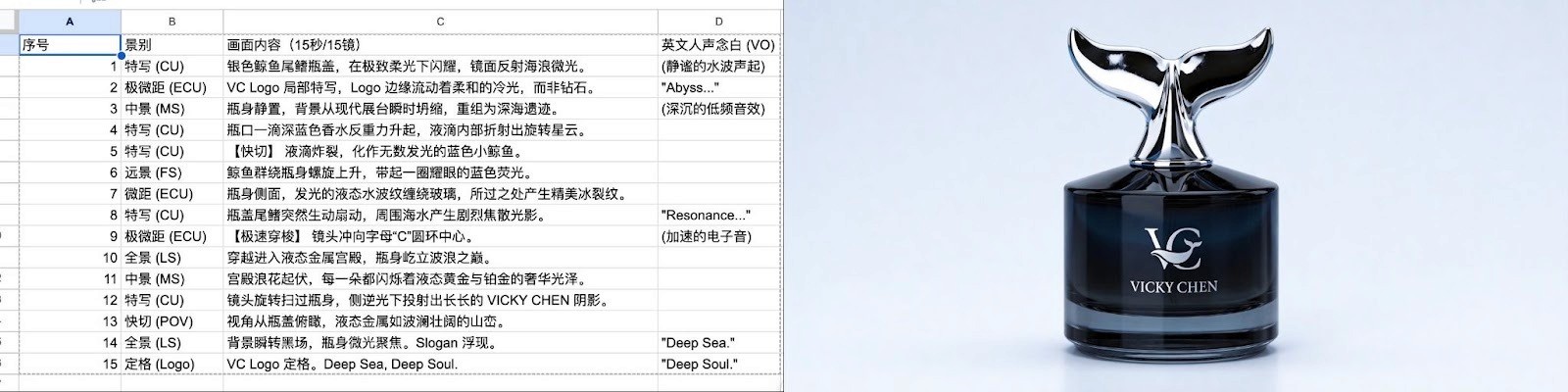

Crédito: 尾鳍Vicky

Na prática, isso reduz a dependência da descrição escrita e transforma o processo em um sistema de criação por referência.

Cada tipo de entrada cumpre um papel específico dentro da construção da cena:

Imagens ajudam a fixar identidade visual. Subir diferentes ângulos de um personagem aumenta a consistência ao longo do vídeo e reduz o problema do rosto que muda de um segundo para outro, que ainda aparece em outros modelos.

Vídeos entram como guia de movimento e linguagem de câmera. Se a ideia é executar um dolly zoom específico ou replicar uma coreografia, o modelo extrai esse padrão de movimento sem necessariamente herdar a estética visual do arquivo original.

Áudios funcionam como guia de ritmo. Batidas, pausas e intensidade passam a influenciar diretamente a velocidade dos cortes e a energia da cena.

Crédito: Changning Liu

Planejamento de cena antes da geração

Outro avanço relevante é a inteligência multi-shot. Antes de renderizar, o modelo interpreta o prompt e estrutura a sequência com base em linguagem cinematográfica. Ele organiza planos, transições e ritmo de forma coerente, mantendo iluminação, atmosfera e elementos de cena consistentes ao longo do vídeo.

O resultado é um output que já nasce com lógica de edição, reduzindo etapas de montagem e aproximando o material de algo mais utilizável no fluxo real de produção.

Crédito: John

Seedance 2.0 na percepção de criadores que já testaram na prática

Entre quem acompanhou o Seedance 2.0 desde o beta, a percepção é mista. Existe um avanço claro na qualidade e na consistência, mas o modelo chegou ao lançamento mais restrito do que nas versões de teste, uma diferença que não passou despercebida em quem já vinha explorando o modelo com mais liberdade.

Ainda assim, o que mais chama atenção não é só a qualidade visual, mas a forma como ele interpreta referências.

O modelo não funciona apenas como um gerador que recebe um comando e devolve algo parecido. Ele demonstra uma capacidade mais refinada de leitura e combinação de elementos, principalmente quando várias referências são usadas na mesma geração.

Um exemplo é usar um vídeo 3D como referência de movimento combinado com uma imagem estática para guiar a estética. O Seedance consegue interpretar cada referência separadamente e gerar a cena de forma coerente, mantendo o movimento e o estilo visual com precisão.

Esse tipo de resultado ainda é mais inconsistente em outros modelos.

Crédito: Changning Liu

Outro ponto relevante é a leitura de linguagem audiovisual. Ritmo, cortes e organização de cena entram na geração de forma mais estruturada, o que melhora a coerência do resultado.

A aderência ao prompt também se destaca, principalmente em comandos mais técnicos. Tipos de plano, movimentos de câmera e iluminação tendem a ser executados com mais precisão.

Crédito: Eltan Nouri

No geral, mesmo com as limitações introduzidas no lançamento, o Seedance 2.0 não fica atrás dos concorrentes diretos no que realmente pesa para produção criativa e, em alguns cenários, supera modelos como o Kling 3.0.

Limitações do Seedance 2.0: o que ainda impede uso mais amplo

As restrições do Seedance 2.0 aparecem rápido no uso real. O modelo entrega avanço técnico, mas limites e decisões de moderação ainda moldam o que de fato é possível produzir hoje.

Bloqueio de rostos

Essa é, de longe, a restrição mais sensível.

O Seedance 2.0 bloqueia o uso de rostos reais como referência, o que impacta diretamente campanhas, personagens recorrentes e qualquer produção baseada em identidade facial.

Na prática, os criadores estão contornando isso com enquadramentos mais abertos, planos de costas ou ângulos que evitam exposição direta do rosto. Funciona em alguns casos, mas exige adaptação de linguagem e pode descaracterizar a proposta original.

Erros em interação física

Aqui o Seedance se sai muito bem com objetos e ações isoladas, mas ainda encontra dificuldade quando existe contato direto entre elementos.

Apertos de mão, abraços ou qualquer tipo de toque entre personagens podem gerar distorções visuais. Em vez de um contato natural, surgem fusões estranhas ou sobreposição de formas.

Esse tipo de erro fica mais evidente em cenas mais detalhadas, com muitas ações acontecendo ao mesmo tempo, limitando o uso em cenas que dependem de atuação física mais próxima.

Problemas de consistência em cenas complexas

Aqui entra uma diferença importante entre inteligência de interpretação e qualidade de imagem.

O Seedance entende bem o que foi pedido, mas nem sempre sustenta o mesmo nível técnico ao longo do vídeo.

Em cenas mais exigentes, aparecem perdas de nitidez, pequenas instabilidades e variações de detalhe. Em clipes mais longos, traços faciais e elementos como acessórios também podem oscilar.

Na prática, isso exige cortes mais curtos e ajustes de continuidade na edição.

Em comparação direta, modelos como o Kling 3.0 ainda mantêm vantagem em estabilidade de imagem em cenários mais críticos.

Ainda assim, quando o modelo acerta, o nível de controle é bem alto:

Crédito: Riccardo Wolf

Prompts bloqueados

O sistema de moderação do Seedance 2.0 ainda é pouco previsível. Alguns prompts são bloqueados sem padrão claro, o que leva a um processo de tentativa e repetição.

Em certos casos, insistir no envio acaba liberando a geração, o que indica mais inconsistência do que regra bem definida.

Além disso, prompts em chinês ainda tendem a performar melhor, criando uma diferença prática para usuários fora desse contexto.

Dicas práticas que melhoram resultados no Seedance 2.0

Alguns padrões já começaram a se repetir entre quem está usando o Seedance 2.0 com mais frequência. São ajustes simples, mas que melhoram consistência e reduzem retrabalho.

Na estrutura de prompt, formatos em JSON com até cinco timestamps têm funcionado melhor em vídeos de até 15 segundos. Quando há muitas mudanças dentro da mesma cena, o modelo tende a perder consistência ao longo da geração.

Outro ponto recorrente é separar geração e pós-produção. Remover logos e marcas antes de gerar o vídeo e inserir esses elementos depois, em ferramentas como o After Effects, evita bloqueios e dá mais controle sobre o resultado final. No áudio, incluir efeitos sonoros ajuda na construção da cena, mas evitar trilhas completas facilita a edição posterior.

Também aparecem ajustes de linguagem visual. Planos mais abertos, ângulos de costas ou enquadramentos que evitam close no rosto têm passado com mais consistência dentro das limitações atuais.

Por fim, alguns fluxos já combinam o Seedance com outros modelos em pontos específicos. Em cenas que exigem maior presença de personagem ou mais estabilidade, ferramentas como Kling ou Hailuo entram nos planos mais críticos para complementar o resultado.

Leia também: Workflow híbrido: combinando IA com ferramentas tradicionais

Conclusão: vale a pena usar o Seedance 2.0 hoje?

De junho de 2025 a fevereiro de 2026, em menos de oito meses, o Seedance saiu de um gerador de clipes silenciosos para uma das ferramentas com o sistema de controle criativo multimodal mais completo do mercado.

O Seedance 2.0 é tecnicamente mais sofisticado do que as versões anteriores da família Seed e hoje compete de forma direta com o que existe de mais avançado em geração de vídeo com IA. Os avanços ampliam, e bastante, o nível de controle possível em direção de cena.

O problema é que o modelo chegou num estado mais contido do que o beta sugeria. O bloqueio de rostos reais como referência limita aplicações relevantes. A inconsistência em cenas mais densas exige escolhas mais conservadoras. E o fluxo de trabalho ainda demanda mais contorno operacional do que seria esperado em um lançamento oficial.

No fim, ele impressiona mais pela inteligência do que pela estabilidade, o que reforça a percepção de um produto reconfigurado sob pressão. Ainda assim, entrega valor concreto dentro das regras atuais, mesmo abaixo do potencial que já demonstrou.

Para quem trabalha com cenas físicas complexas, várias referências e direção mais cinematográfica, o Seedance 2.0 já faz sentido no fluxo real. Para demandas que exigem consistência absoluta de personagem e controle fino de imagem, outros modelos ainda respondem melhor hoje.

Esse cenário também aponta o caminho das próximas atualizações. A tendência é que o modelo avance justamente nesses pontos, já incorporando limites mais claros ligados a uso de imagem e propriedade intelectual, numa tentativa de evitar novos conflitos regulatórios.

Por enquanto, a resposta honesta é simples: o Seedance 2.0 vale ser usado pelo que já entrega, desde que as restrições atuais sejam levadas em consideração.

Outra atualização recente que tem movimentado a comunidade criativa é o Midjourney V8 Alpha, que promete gerar imagens até cinco vezes mais rápido, com maior controle de personalização. Já testamos o modelo e vale a pena conferir nossas primeiras impressões, especialmente considerando que os outputs do V8 podem funcionar como referências diretas no Seedance 2.0 dentro de um fluxo híbrido de IA mais inteligente.