Human Picks

Staff

Existe um desafio antigo na animação: quanto mais ousado o estilo visual, mais complexa e trabalhosa se torna sua execução dentro de cronogramas e orçamentos reais. Estilos artísticos, visuais que mudam de textura e linguagem a cada cena, tudo isso costuma exigir um trabalho intensivo, frame a frame, equipes maiores e prazos que facilmente se estendem por meses ou até anos.

"Dear Upstairs Neighbors", curta-metragem que estreou no Sundance Film Festival em janeiro de 2026, enfrentou exatamente essa questão. A história de Ada, uma jovem desesperada por uma noite de sono enquanto lida com vizinhos barulhentos, transita constantemente entre realidade e fantasia em um estilo expressionista bem marcado. Cada transição exigia paletas visuais distintas, visuais próprios e movimentos com timing narrativo preciso.

A solução ideal para produzir o curta nasceu de uma colaboração entre veteranos da Pixar, incluindo a diretora Connie He, e pesquisadores do Google DeepMind. O objetivo era descobrir se ferramentas de IA poderiam ampliar possibilidades criativas sem sacrificar controle artístico. O resultado mostra que sim, mas só quando a tecnologia acompanha as necessidades dos artistas, e nunca o contrário.

O papel das referências visuais na animação com IA

A diretora Connie He começou o projeto como qualquer diretor tradicional começa: desenvolvendo storyboards detalhados, baseados em sua experiência pessoal com vizinhos barulhentos. Na sequência, ela trouxe o designer de produção premiado Yingzong Xin para criar concept art e desenhar personagens. A visão dos dois já estava clara, documentada, pronta para ser executada.

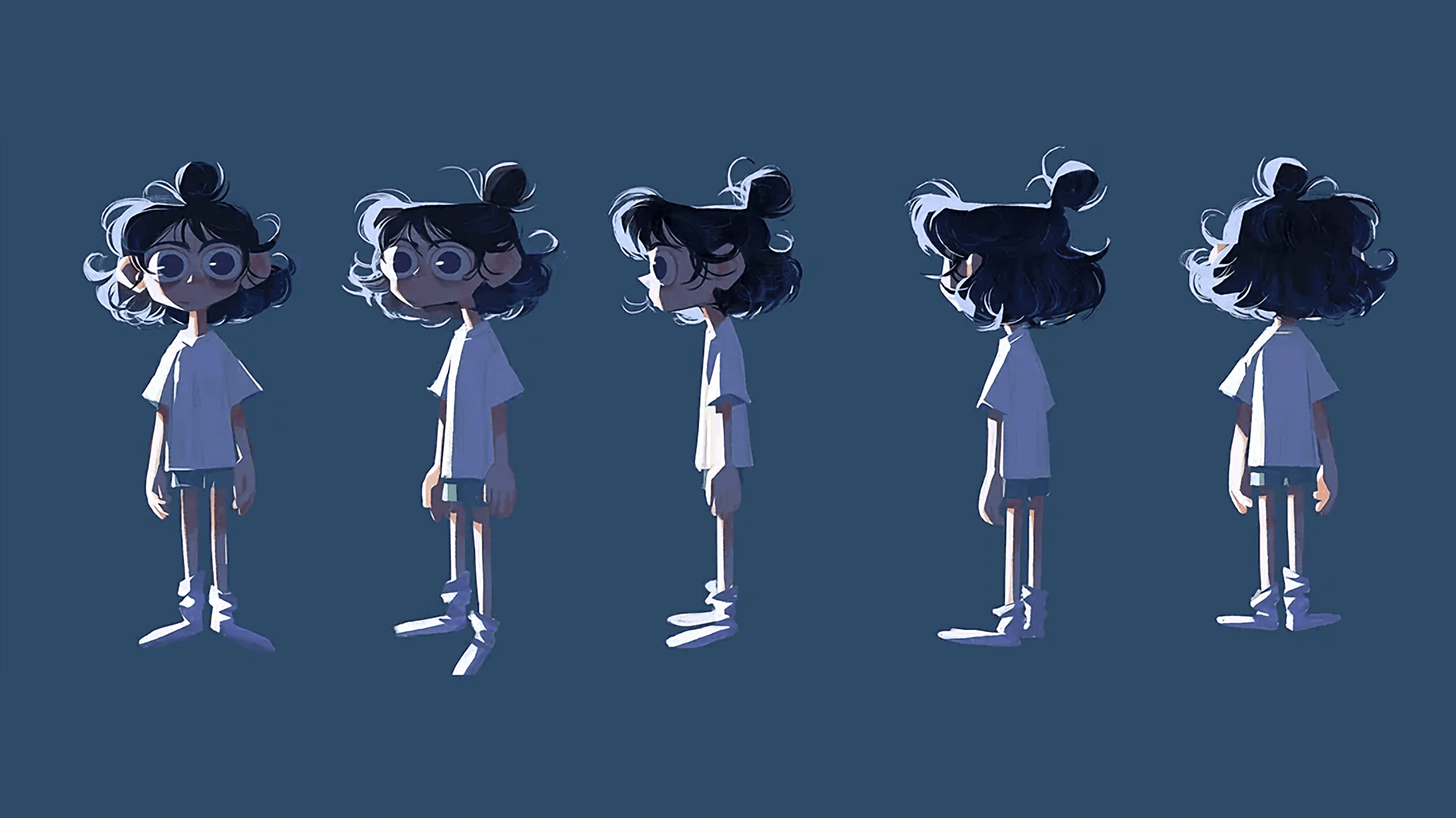

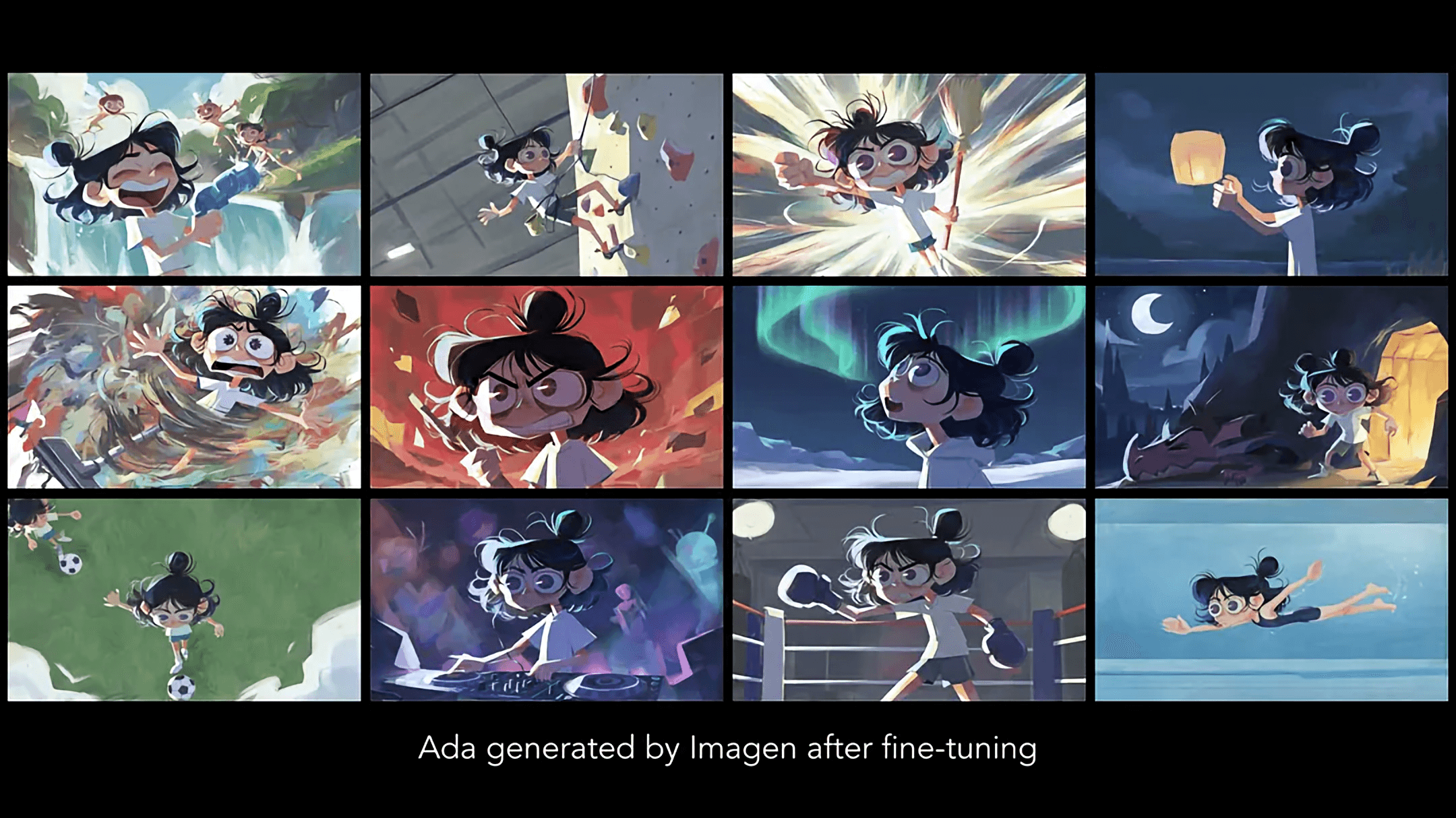

Para a personagem principal, Ada, Yingzong Xin criou um design peculiar e único, com proporções exageradas e uma linguagem de formas angulares. O rosto de Ada é bastante expressivo, capaz de transmitir frustração, exaustão e momentos de completo desânimo.

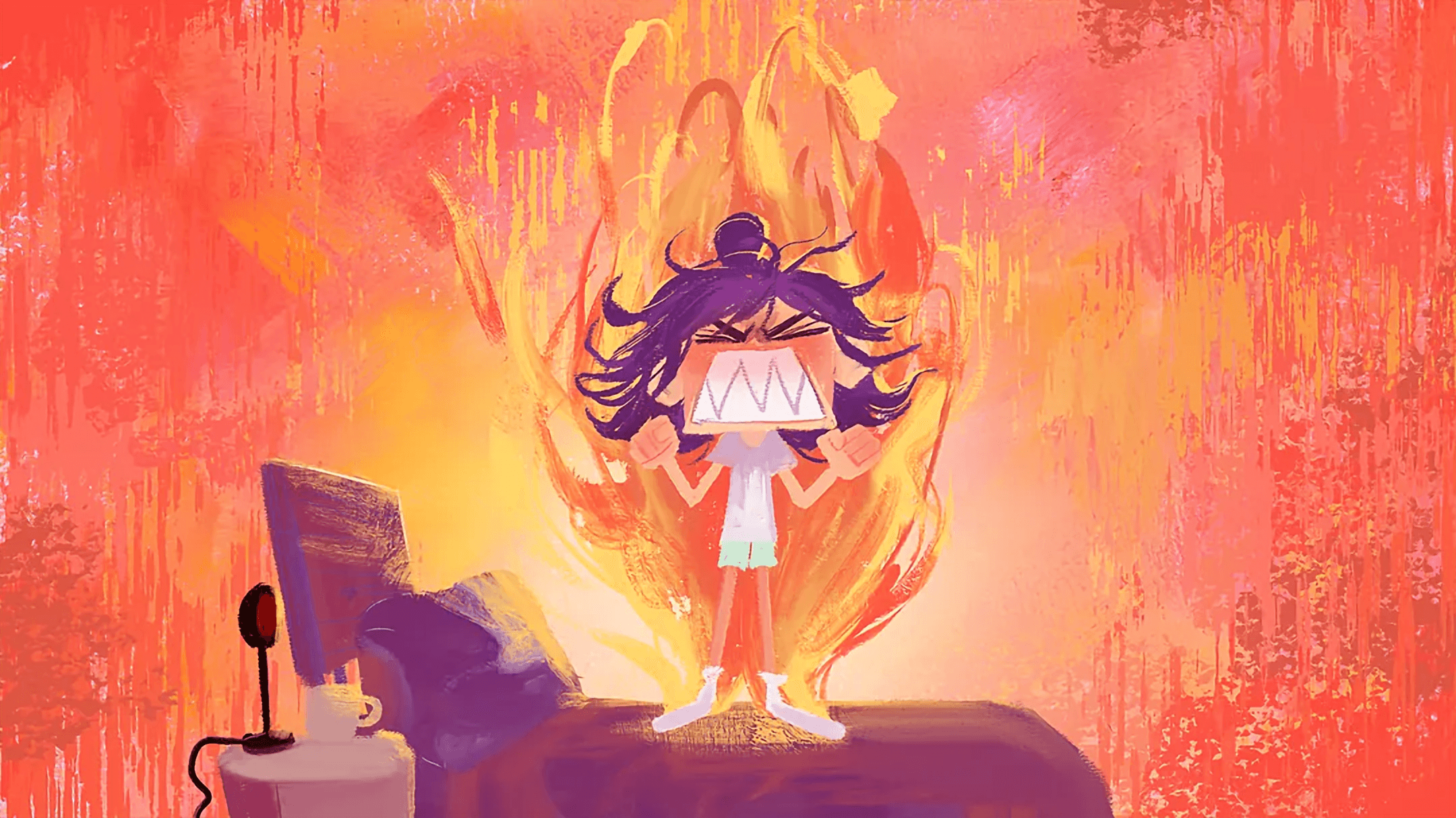

O quarto de Ada foi renderizado em cores frias, transmitindo uma sensação de calma, conforto e refúgio, um contraste deliberado com o caos que vem do andar de cima.

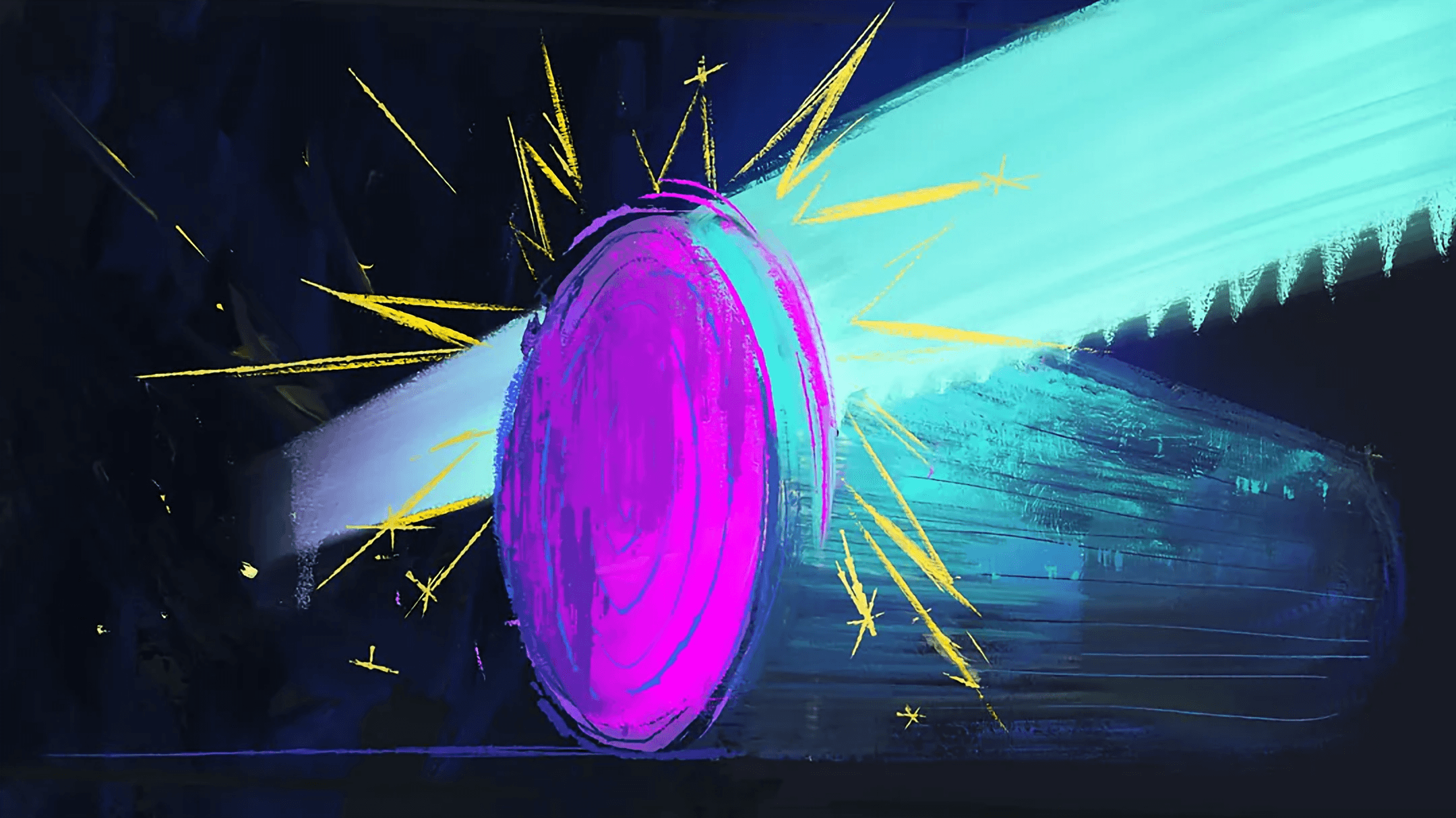

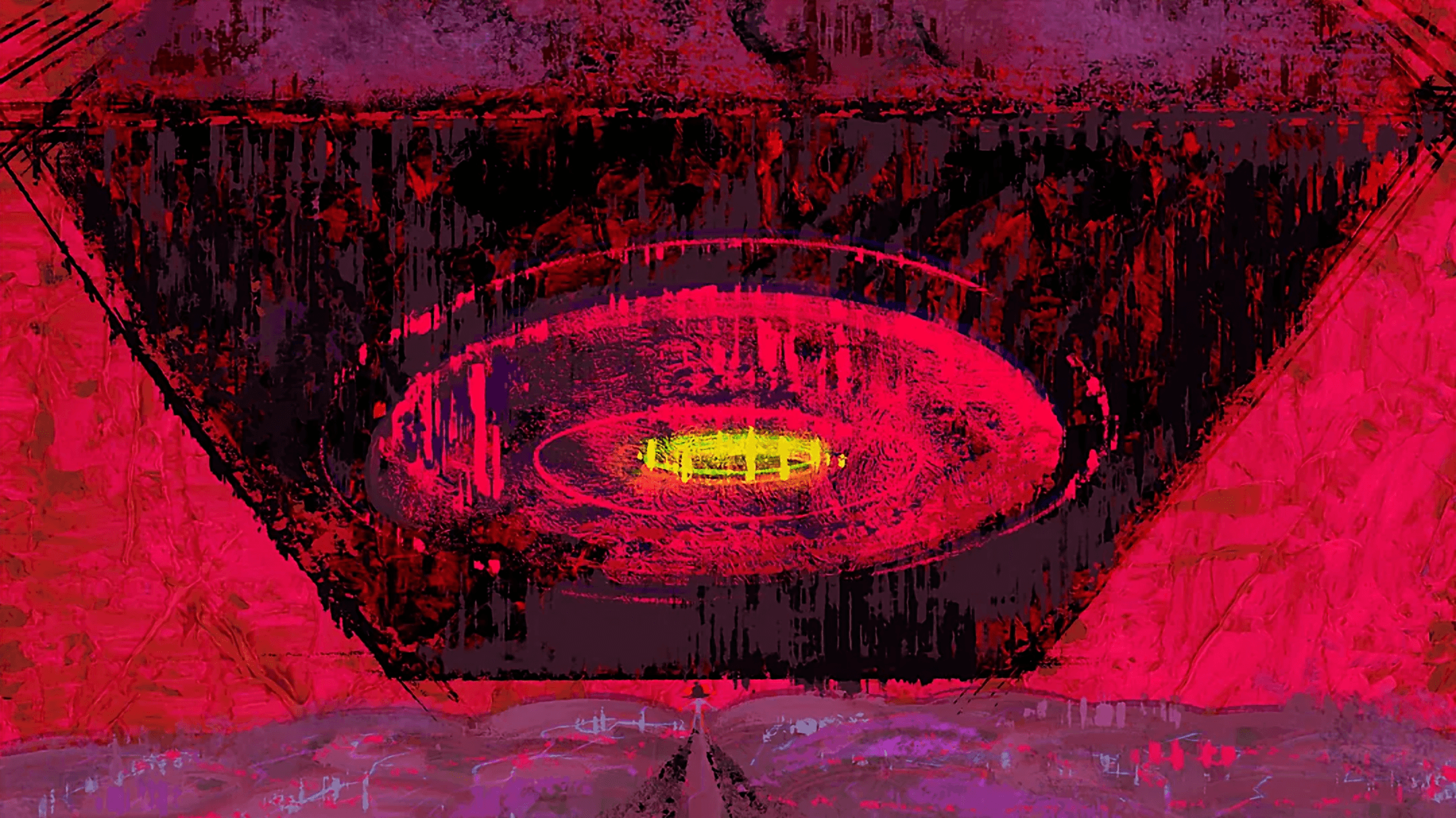

As alucinações de Ada têm um estilo visual completamente diferente: mais cru, porém com paleta neon que as distingue do "mundo real" de seu quarto. O estilo muda de momento a momento, expressando as emoções variáveis de Ada por meio de cor e textura.

Nos momentos mais intensos, o estilo expressionista abstrato cresce até dominar toda a cena, consumindo o espaço visual por completo.

O conceito já era forte, com visuais bem pensados, mas o problema real surgiu quando a equipe tentou usar modelos de IA padrão para reproduzir as cenas. Ferramentas como Veo e Imagen conseguem criar vídeos a partir de descrições textuais, mas elas ainda não sabiam quem era “Ada” e não compreendiam o estilo visual específico que definia cada momento da narrativa. Modelos de uso geral, por padrão, operam com bases mais amplas, não com identidades visuais únicas.

Aqui está o insight fundamental que definiu todo o projeto: IA funciona melhor quando aprende uma linguagem visual específica do seu projeto antes de começar a produzir. A equipe do Google DeepMind então trabalhou para que as ferramentas permitissem aos artistas fazer um ajuste fino personalizado.

O processo envolveu ensinar aos Veo e ao Imagen conceitos visuais novos usando algumas imagens de referência. Pense nisso como criar um catálogo visual exclusivo. O modelo aprende que "Ada" não significa qualquer mulher jovem, mas uma personagem com expressões faciais particulares, proporções exatas, uma personalidade visual única. Assim, a IA aprende que cada cena do filme possui uma identidade própria que precisa ser respeitada.

Esse ajuste transformou resultados genéricos em extensões verdadeiras de todo o processo criativo. A equipe inteira já podia explorar variações de Ada em diferentes poses, expressões e enquadramentos, sempre preservando coerência com o design original.

O que surpreendeu o time de criação foi justamente o nível de compreensão que o Veo desenvolveu após o ajuste fino. O modelo não aprendeu apenas detalhes superficiais como cor e textura das pinturas de Yingzong Xin, mas conceitos artísticos profundos como perspectiva.

Mais impressionante ainda: Ada foi desenhada totalmente em 2D. Seu topete e coque bagunçado fazem parte da silhueta e nunca podem esconder o rosto. Uma escultura 3D do cabelo de Ada não funcionaria, porque a forma sólida quebra essas regras de design 2D. Depois de um ajuste fino com imagens de Ada, o Veo conseguiu resolver esse conflito, adaptando as formas de modo que a silhueta continue correta mesmo quando a cabeça gira. O modelo internalizou esses princípios de design 2D sem que ninguém precisasse escrever uma nova programação para isso.

Por que prompts sozinhos não são suficientes na animação com IA

Prompts textuais são ótimos pontos de partida, mas, sozinhos, nem sempre dão conta de descrever movimento com precisão. Detalhes como ritmo, timing e progressão visual são difíceis de traduzir apenas em palavras. Como explicar por escrito o ritmo exato dos dedos cansados de alguém digitando? Ou o timing cômico preciso de uma expressão facial que muda gradualmente de frustração para desânimo? Ou o enquadramento de uma revelação de câmera que precisa acontecer em três segundos e meio?

Você vai escrever parágrafos tentando capturar nuances que um animador comunica em segundos desenhando, pintando ou simplesmente encenando a cena. Linguagem verbal é linear, sequencial e por isso mais limitada. Movimento é espacial, temporal, multidimensional.

Os testes iniciais usando apenas text-to-video com o modelo Veo já ajustado produziram cenas que pareciam visualmente com Ada, mantendo a consistência geral de personagem, mas o movimento ainda era bem aleatório, descontrolado e muitas vezes bizarro.

A equipe entendeu que precisava abandonar a dependência exclusiva de prompts para ter mais controle criativo. A solução veio de observar como os animadores realmente se comunicam entre si: visualmente. Eles desenham, pintam, filmam referências, criam animatics rápidas. Tudo é mostrado ao invés de ser só descrito.

Então os pesquisadores desenvolveram fluxos de trabalho de vídeo-to-vídeo mais precisos, e os animadores passaram a criar animações brutas com suas ferramentas favoritas, como sketches digitais rápidos, storyboards animados ou filmagens de atores interpretando as cenas. Esses vídeos funcionaram como guias de movimento e composição.

Os modelos de IA receberam essas animações e as transformaram em vídeos completamente estilizados que seguiam o movimento de entrada. O diferencial estava no equilíbrio ajustável entre fidelidade e improvisação. Para cenas que exigiam timing perfeito, como as expressões faciais cômicas de Ada, os animadores mantinham controle rígido. Em momentos de caos e fantasia, eles permitiam que o modelo acrescentasse variações criativas dentro de parâmetros definidos.

Para criar uma performance equilibrada, mas forte o suficiente para carregar a história, os animadores usaram métodos tradicionais. O animador Ben Knight criou animação rough 3D para cenas específicas no Maya, o software de animação 3D que é padrão da indústria. O pesquisador Andy Coenen então usou modelos Veo ajustados para transformar essa animação 3D no visual final estilizado, preservando cada nuance de timing e expressão que Ben havia criado.

A abordagem vídeo-to-vídeo permitiu que cada artista trabalhasse em sua zona de conforto, usando suas ferramentas favoritas sem precisar aprender novos softwares. O animador Mattias Breitholtz criou animação rough 2D usando TV Paint, um software especializado em animação tradicional frame a frame.

O pesquisador Forrester Cole transformou essa animação frame a frame no visual final, usando versões ajustadas do Imagen em um workflow customizado no ComfyUI. ComfyUI é uma interface visual baseada em nós para controlar modelos de difusão, permitindo workflows complexos e customizados que vão muito além de simples prompts de texto.

Já o animador Steven Chao trabalhou com uma abordagem híbrida: ele animou Ada e criou efeitos dinâmicos low-poly no Maya. A pesquisadora Ellen Jiang, trabalhando em colaboração com a diretora Connie He, usou modelos Veo e Imagen ajustados para transformar esses elementos no visual expressionista final. O ritmo staccato da mudança de textura, onde a pintura parece pulsar e se reorganizar frame a frame, adicionava a intensidade à ação e reforçava o estado mental alterado de Ada.

Esse workflow resolve um dos maiores gargalos da animação tradicional: a distância entre conceito e execução.

👉 Aprofunde: Workflow híbrido: combinando IA com ferramentas tradicionais

Refinamento com IA: ajustes pontuais sem recomeçar do zero em cada cena

É sempre bom lembrar que, no audiovisual, a primeira tentativa quase nunca é o resultado final. Mesmo com ajuste fino e controle detalhado, cada cena passa por várias rodadas de refinamento. Com IA, não é diferente. Quanto mais próximo do resultado desejado, mais iterações o processo exige.

A produção de "Dear Upstairs Neighbors" seguiu exatamente o mesmo processo de produção de qualquer filme tradicional: revisões diárias, análise crítica de cada tomada, feedback detalhado, ajustes sucessivos até cada frame estar exato. A diferença estava somente nas ferramentas de trabalho.

Para criar a alucinação de Ada com um cachorro uivante, por exemplo, a equipe começou com uma pintura conceitual de Yingzong Xin e usou a capacidade image-to-video do Veo para dar vida à cena. A primeira tentativa do Veo sem ajuste fino era “realista” demais para o estilo do filme. A equipe então usou a versão ajustada do Veo para aproximar o plano do estilo visual esperado. O workflow vídeo para vídeo permitiu alternar livremente entre o Veo e ferramentas tradicionais como Adobe Premiere Pro, aproveitando o melhor de cada abordagem.

Usar Veo ajustado com workflows vídeo-to-vídeo permitiu iterar no design, tanto do cão quanto dos efeitos ao redor dele. A equipe explorou variações estilísticas com liberdade e controle, testando diferentes intensidades de textura, diferentes paletas dentro do espectro neon, diferentes níveis de exagero. Cada iteração mantinha a coerência com a visão original enquanto refinava detalhes específicos.

Em workflows de VFX com IA, você pode trabalhar com camadas e máscaras, ajustando regiões específicas. A equipe construiu ferramentas de refinamento localizadas para geração de vídeo.

O supervisor de animação Cassidy Curtis criou esboços 3D para planos específicos no Maya. A pesquisadora Erika Lu ajustou um modelo Veo para transformar esses esboços no visual final. Para melhorar a silhueta do cabelo de Ada em um plano específico, Erika adicionou uma máscara indicando a região onde mais cabelo era necessário. O Veo então improvisou um tufo extra de cabelo que se encaixou perfeitamente no resto do plano, mantendo consistência de estilo, movimento e iluminação. O modelo compreendeu o contexto visual e criou uma forma de cabelo que parece ter estado lá desde sempre.

Na prática, se a expressão facial de Ada em um momento específico precisasse mudar, mas o resto da cena estava perfeito, apenas aquela região era retrabalhada. Se o movimento de fundo funcionava, mas a iluminação do primeiro plano precisava de ajuste, os animadores mexiam só na iluminação. O processo foi de controle detalhado, mas com liberdade para intervir apenas onde fazia sentido.

Abordagens assim economizam tempo e preservam elementos que deram certo, enquanto aprimoram os pontos que precisam de refinamento. Mais importante, mantêm o processo criativo familiar. Diretores, supervisores de VFX e animadores já pensam em termos de camadas, regiões e ajustes pontuais. Agora as ferramentas se adaptam ao fluxo de trabalho existente em vez de forçar um novo.

Upscaling com IA na animação: como chegar ao 4K sem perder estilo artístico

Filmes que estreiam em festivais como Sundance precisam de qualidade de projeção e, hoje, isso significa 4K. Mas aqui está o problema: aumentar a resolução é fácil, agora fazer isso sem destruir nuances artísticas é mais complexo.

Algoritmos tradicionais de upscaling adicionam pixels, mas não entendem o estilo. Eles não sabem que aquelas pinceladas digitais específicas carregam intenção artística. Eles não percebem que a textura expressionista daquela cena é parte essencial da narrativa. Eles simplesmente preenchem e suavizam, muitas vezes destruindo exatamente os detalhes que importam.

A equipe utilizou a capacidade de upscaling do Veo para levar os planos finais a 4K, mas o processo envolveu muito mais do que apertar um botão. Guiados pela crítica constante dos artistas, os pesquisadores ajustaram cuidadosamente o comportamento do modelo. O objetivo era que a versão adaptada mantivesse a integridade das pinceladas, das texturas e dos contrastes de luz característicos de cada cena.

O modelo aprendeu a adicionar detalhes ricos que parecem ter estado lá desde sempre, com uma interpretação mais consciente do estilo. Cada cena apresentou desafios únicos de upscaling, exigindo ajustes específicos para preservar sua identidade visual. As cenas com texturas expressionistas intensas demandaram calibrações diferentes das cenas mais calmas do quarto de Ada.

O modelo de upscaling 4K do Veo está agora disponível no Flow e sendo liberado no Google AI Studio e Vertex AI. A intenção é atender necessidades reais de quem precisa de qualidade de exibição profissional sem comprometer decisões artísticas no processo.

O papel da colaboração entre especialistas em projetos de animação com IA

Nenhum projeto de exploração tecnológica acontece sem falhas. Cassidy Curtis detalha que os modelos de IA geraram uma coleção de resultados curiosos ao longo do caminho. Expressões faciais absurdas que desafiavam a anatomia humana, movimentos fisicamente impossíveis que quebravam as leis da física, interpretações completamente equivocadas de prompts que resultavam em imagens surreais e não intencionais. Tudo isso foi encarado como parte natural do processo de desenvolvimento.

Mas a imprevisibilidade também trouxe surpresas positivas, como visuais interessantes que nenhum dos artistas tinha planejado conscientemente. Essas variações criativas abrem sempre novas possibilidades narrativas, momentos em que a ‘alucinação’ da IA gera resultados mais expressivos, emocionantes ou impactantes do que a intenção original. A equipe de ‘Dear Upstairs Neighbours’ aprendeu na prática a valorizar esses acidentes felizes.

A colaboração diária entre artistas e pesquisadores criou um processo contínuo de inovação. Os artistas descobriram novas possibilidades criativas ao terem acesso direto às pesquisas experimentais. Eles não estavam apenas usando ferramentas prontas, entregues por uma equipe de tecnologia distante. Estavam lado a lado com os pesquisadores, ajudando a definir como as ferramentas iriam funcionar. Seu olhar e experiência influenciaram diretamente o desenvolvimento das capacidades técnicas.

Os pesquisadores ganharam experiência prática como artistas técnicos. Eles perceberam que teoria e aplicação criativa são mundos diferentes, cada um com seus próprios desafios. Um modelo pode funcionar perfeitamente em testes controlados com métricas objetivas e ainda assim falhar quando confrontado com necessidades narrativas reais e subjetivas.

O sucesso não se mede pela similaridade matemática com os exemplos usados para treinar o modelo, mas por como o plano funciona emocionalmente dentro da história. Prototipar soluções rapidamente, testar em contexto real e iterar com base em feedback artístico se tornou o ritmo diário de trabalho.

7 lições importantes para inspirar criadores de animação com IA

1️⃣ "Dear Upstairs Neighbors" teve recursos do Google DeepMind, acesso a modelos experimentais e uma equipe de pesquisadores dedicados. Mas os princípios fundamentais da animação tradicional funcionam e sempre vão funcionar bem em qualquer projeto, com ou sem IA.

2️⃣ A abordagem focada no artista prioriza controle sobre automação. As ferramentas ampliam capacidades criativas sem substituir decisões humanas. Essa filosofia se aplica independentemente do tamanho do projeto ou do orçamento disponível.

3️⃣ Se você trabalha com produção audiovisual e quer explorar ferramentas de IA, comece definindo sua visão artística antes de pensar em qualquer tecnologia. Desenvolva storyboards, produza concept arts e estabeleça suas referências visuais. A tecnologia deve apoiar sua visão artística, jamais definir.

4️⃣ Invista tempo em ajuste fino quando o projeto exigir consistência visual específica. Por padrão, a IA raramente captura identidades visuais únicas logo de cara. Algumas horas treinando um modelo com suas próprias referências podem economizar semanas de trabalho.

5️⃣ Use animações brutas, sketches, filmagens de referência para comunicar movimento e timing. Mostre o que você quer em vez de tentar descrever em texto. A limitação da linguagem verbal é real e você vai poupar frustração se comunicando visualmente desde o início.

6️⃣ Mantenha processos iterativos com revisões constantes. IA não resolve problemas criativos em uma tentativa. Trate gerações como rascunhos que precisam de refinamento, exatamente como você trata animatics ou pré-visualização em fluxos tradicionais. A primeira versão quase nunca é a versão final.

7️⃣ Combine pontos fortes de cada abordagem. A animação tradicional pode oferecer controle preciso e timing narrativo perfeito. IA oferece escala, flexibilidade estilística e velocidade de iteração. A combinação das duas supera o que cada uma faz isoladamente. Saber quando usar cada ferramenta, quando confiar no controle manual e quando aproveitar a inteligência artificial é a habilidade crítica que separa bons resultados de resultados profissionais.

Por que projetos com IA estão mudando a indústria audiovisual

A exibição de ‘Dear Upstairs Neighbors’ no Story Forum do Sundance Institute não aconteceu por acaso. O Story Forum é um espaço dedicado a ferramentas e tecnologias feitas para artistas contarem histórias visuais. Apresentar o filme ali, em vez de numa sessão técnica ou de tecnologia, mostra que o projeto vai além de um experimento isolado. Ele representa uma nova maneira de pensar a relação entre artistas e tecnologia.

A indústria audiovisual está passando por uma grande transição. As ferramentas de IA já estão maduras o suficiente para uso profissional, mas muitas vezes quem observa de fora vê os artistas como meros usuários passivos de tecnologias fechadas. Ou, no outro extremo, as ferramentas ainda são encaradas com ceticismo profundo e medo de substituição. Continua a ideia de que basta digitar um prompt, esperar e aceitar o que a inteligência artificial entrega, como se o processo criativo não exigisse esforço, intenção ou sensibilidade artística.

"Dear Upstairs Neighbors" demonstra um caminho diferente. Ferramentas de IA construídas com artistas, para artistas, em colaboração constante. A customização profunda acontece por meio de ajustes finos, enquanto o controle detalhado é garantido com vídeo-to-vídeo e refinamento localizado. A iteração constante respeita os fluxos de trabalho já estabelecidos, com tecnologia que se adapta ao processo criativo, e nunca o contrário.

O Google DeepMind deixou claro que sua missão é criar IA junto com artistas e cineastas profissionais e esse projeto mostra essa visão na prática. O curta não existiria sem a colaboração próxima entre diferentes áreas. A tecnologia permitiu explorar estilos visuais que seriam muito mais complexos de realizar com métodos tradicionais dentro de prazos e orçamentos apertados. Mesmo com IA, cada frame ainda carrega decisões humanas, crítica artística e intenção narrativa forte.

Produtoras, estúdios independentes e criadores de conteúdo podem olhar para esse projeto e encontrar um caminho claro de aplicação prática: usar a IA como apoio estratégico para ampliar possibilidades criativas, mantendo controle sobre todas as decisões essenciais.

Por que saber integrar IA é mais importante do que a ferramenta escolhida

Ferramentas de inteligência artificial estão cada vez mais acessíveis. Veo, Imagen e modelos semelhantes avançam rapidamente para uso profissional e já fazem parte do dia a dia de muitos criadores.

O diferencial não é mais usar IA, mas como fazer a integração dela na prática criativa, respeitando uma visão artística consistente e desenvolvendo seu próprio jeito de trabalhar. É isso que separa a experimentação de resultados de qualidade.

“Dear Upstairs Neighbors” mostra na prática como a colaboração entre humanos e IA pode transformar o resultado final. Mais do que técnicas e ferramentas, o projeto revela uma mentalidade: artistas conduzem as decisões criativas, adaptam a tecnologia às suas necessidades, enquanto pesquisadores atuam como artistas técnicos, não fornecedores de soluções prontas. O resultado é colaboração de verdade para evolução constante.

Para quem atua com criação de conteúdo, animação ou audiovisual, a mensagem é clara: a tecnologia já está disponível, existem exemplos profissionais e os caminhos estão sendo abertos. É hora de experimentar, errar, aprender e equilibrar tradição e inovação.

A pergunta não é mais se você vai usar IA ou não. O mercado já respondeu isso. A questão agora é aprimorar o seu controle artístico, excelência criativa e identidade, expandindo capacidades sem se limitar ao que é oferecido.

E é exatamente isso que você vai acompanhar no nosso primeiro VideoLab em 2026. Um workshop ao vivo, nos dias 28/02 e 01/03, com 12 horas de estúdio aberto, mostrando a Human criando projetos do zero e como uma ideia se transforma em algo profissional com foco em animação com IA, do conceito até a finalização.

Se você quer sair do improviso e produzir com intenção, clareza e consistência, o AI VideoLab é o próximo passo. Não é preciso já dominar IA nem ser animador, basta vontade de aprender e desenvolver um olhar mais apurado sobre criação, independentemente da ferramenta que você vai escolher usar.

👉 Faça sua inscrição no AI VideoLab: Animação com IA

Para ir ainda mais a fundo, vale conferir também como a Human recriou a abertura clássica de Dragon Ball Z em um breakdown completo que mostra decisões criativas, erros, acertos e todo o caminho até o resultado final.