Nando

CEO | FOUNDER

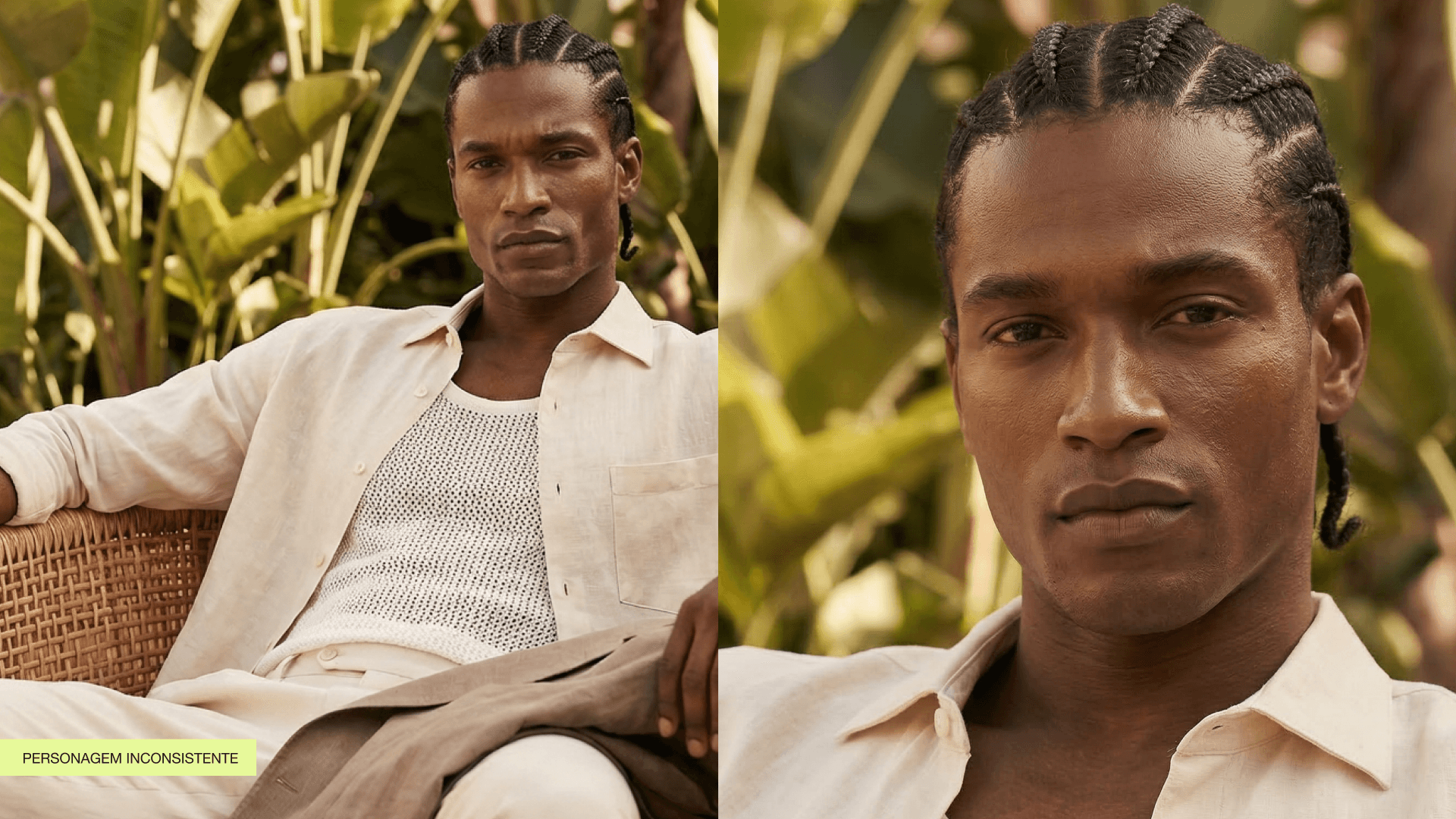

A maior parte das pessoas que tenta manter um personagem consistente ao longo de várias cenas geradas com IA comete o mesmo erro: acha que consistência é só questão de prompt. Troca palavras, testa variações, torce para que a imagem saia como imaginou. No começo, até funciona. Na décima cena, algo já começa a escorregar. Na décima quinta, já é uma pessoa diferente.

Esse fenômeno tem nome técnico: deriva de identidade, ou identity drift. Mas ele não acontece por distração nem por prompt mal escrito. Acontece porque esses modelos trabalham de forma imprevisível. Cada geração começa “do zero”, reinterpretando o personagem com pequenas diferenças a cada vez, influenciadas pela composição da cena, ângulo ou iluminação. Em 20 cenas, essas pequenas mudanças se acumulam até que, no final, o personagem se transforma em algo irreconhecível.

Os modelos de IA são poderosos, mas sem direção clara podem ser instáveis. Hoje vamos olhar três abordagens técnicas que resolvem a consistência de personagem. Não são truques, é preciso entender como funciona e onde pode falhar. Como fazer a combinação funcionar é o que separa um resultado controlado de um caos visual.

Como preparar um personagem antes de gerar cenas com IA

Existe uma etapa que muita gente pula, mas é a base de tudo: definir o personagem de forma estruturada antes de abrir qualquer ferramenta de IA.

Especialistas chamam isso de “DNA do personagem”. Pense nisso como um briefing completo para a IA. A ideia é simples, mas exige atenção. Termos vagos como “bonito”, “estiloso” ou “jovem” raramente ajudam. O modelo não tem sentimentos nem referências afetivas. Ele só entende padrões, então descrições imprecisas se refletem diretamente em imagens instáveis.

O jeito profissional é criar uma descrição detalhada do personagem, incluindo proporções do rosto, ângulo dos olhos, formato da mandíbula, textura e estilo de cabelo. Pode parecer exagero, mas esses detalhes são exatamente os parâmetros que o modelo usa para manter coerência entre cenas.

Pode ser realista, em 2D, 3D ou o estilo que preferir, o que importa é ter uma base sólida e consistente o bastante para dar início.

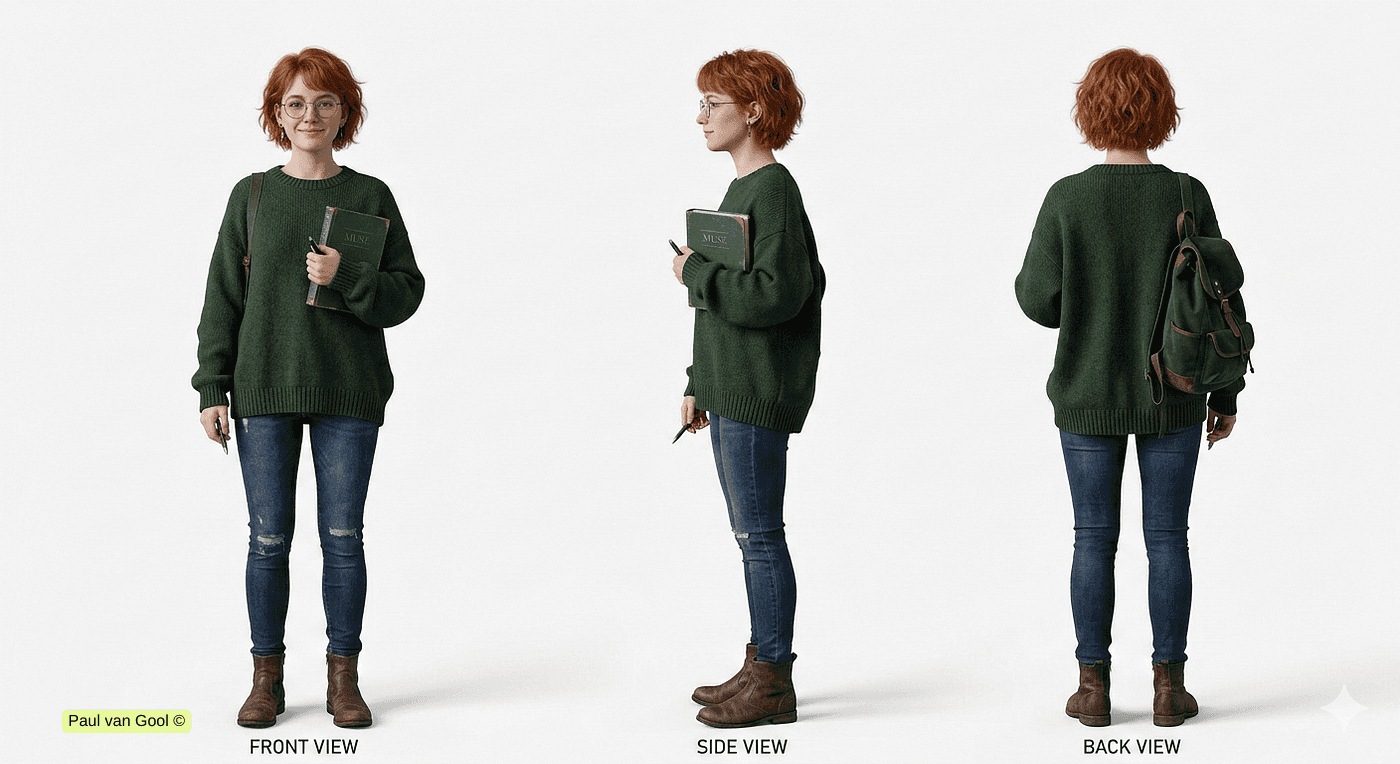

A partir dessa descrição, cria-se a imagem âncora: o personagem em corpo inteiro, posicionado de forma neutra, com iluminação simples e fundo limpo. Esses elementos não fazem parte do DNA do personagem em si, mas ajudam o modelo a enxergar só o personagem, sem interferência de luz, sombra ou cenário. É a referência visual pura que vai guiar todas as gerações seguintes. Seedream e Nano Banana funcionam bem para gerar essas primeiras bases visuais.

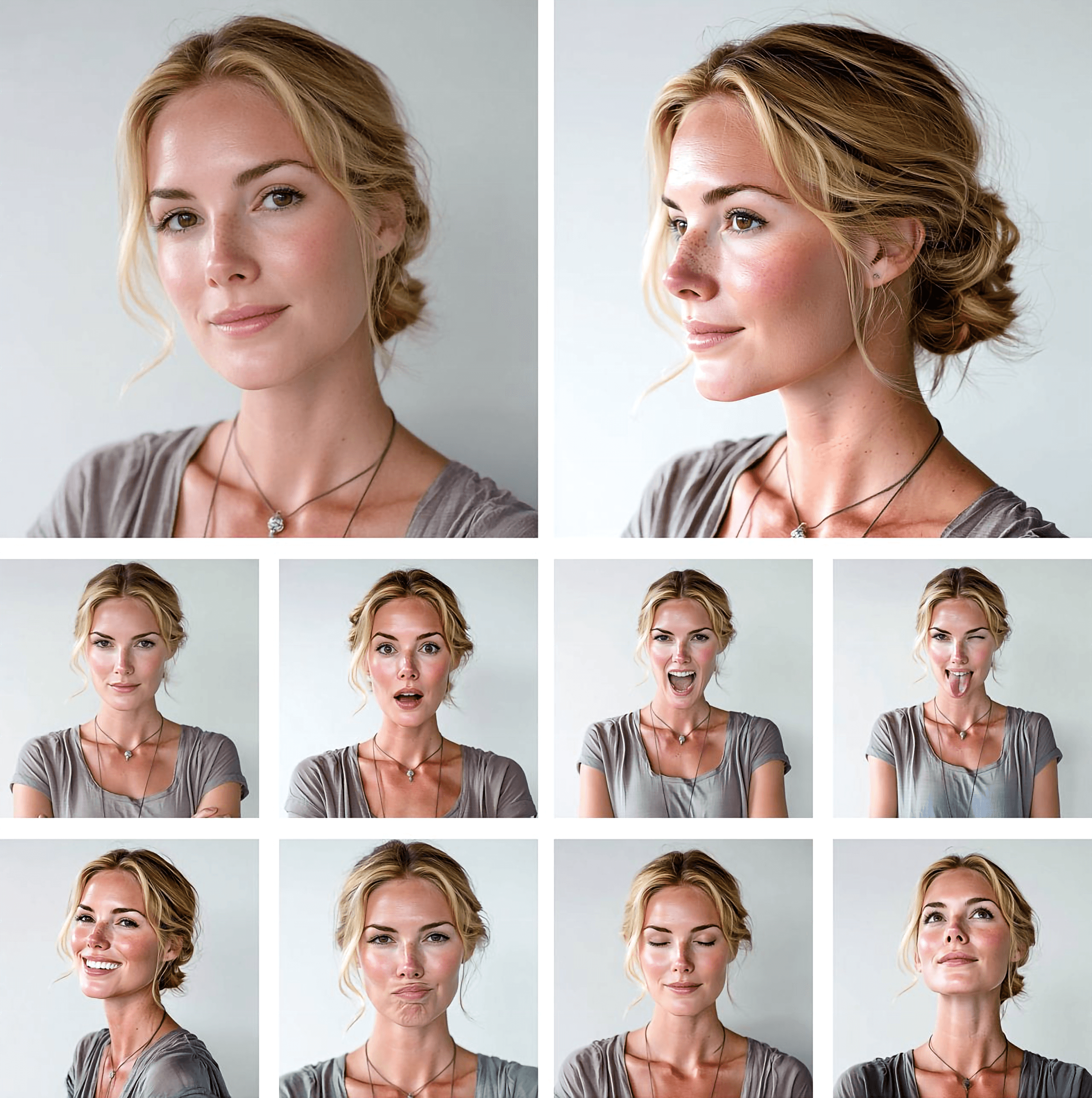

Depois, é hora de gerar várias imagens do personagem em diferentes ângulos: de frente, perfil e três-quartos. Na prática, isso funciona como a chamada folha de rotação, usada na animação tradicional para manter consistência e referência visual de um personagem. Essas imagens passam a guiar todas as gerações seguintes, garantindo que cada cena mantenha a identidade original.

Sem esse passo, qualquer técnica avançada parte de uma base frágil.

Técnica 1: como treinar um personagem consistente em IA usando LoRA

Se você seguiu o passo anterior e já criou o DNA do personagem, com imagem âncora e variações de ângulo, boa parte do trabalho já está feita. Esse material pode servir como base para treinar um LoRA.

O LoRA, ou Adaptação de Baixo Rank, é uma forma de ensinar um modelo de IA a reconhecer um personagem específico. Em vez de depender apenas do que o modelo já conhece, você cria um pequeno treinamento para que ele aprenda aquela identidade.

Esse método é especialmente útil quando o personagem não faz parte do repertório do modelo. Pode ser um herói de quadrinhos, um avatar de marca ou qualquer ser que você inventar. Se o modelo nunca viu nada parecido, ele não sabe como reproduzir coerência sozinho. É aí que o LoRA entra, ensinando o modelo a reconhecer e manter aquela identidade específica.

Como usar o LoRA na prática

Nesse processo, você vai criar um pequeno treinamento com imagens do seu personagem. Cada LoRA precisa de uma palavra “gatilho” exclusiva, que você vai usar nos prompts para acionar aquela identidade. Por exemplo: se seu personagem se chama KARVOX, você vai escrever algo como “KARVOX, standing in a rainy alley” no prompt. O modelo vai entender que “KARVOX” se refere àquele personagem específico e tentar manter a mesma aparência em todas as cenas.

Evite nomes comuns como “Carlos” ou “Sofia”. O modelo já associa esses nomes a milhares de rostos diferentes, e isso cria confusão. Prefira combinações únicas de letras e maiúsculas, tipo “KARVOX” ou “Zyla_v2”.

Como escolher as imagens para treinar um LoRA

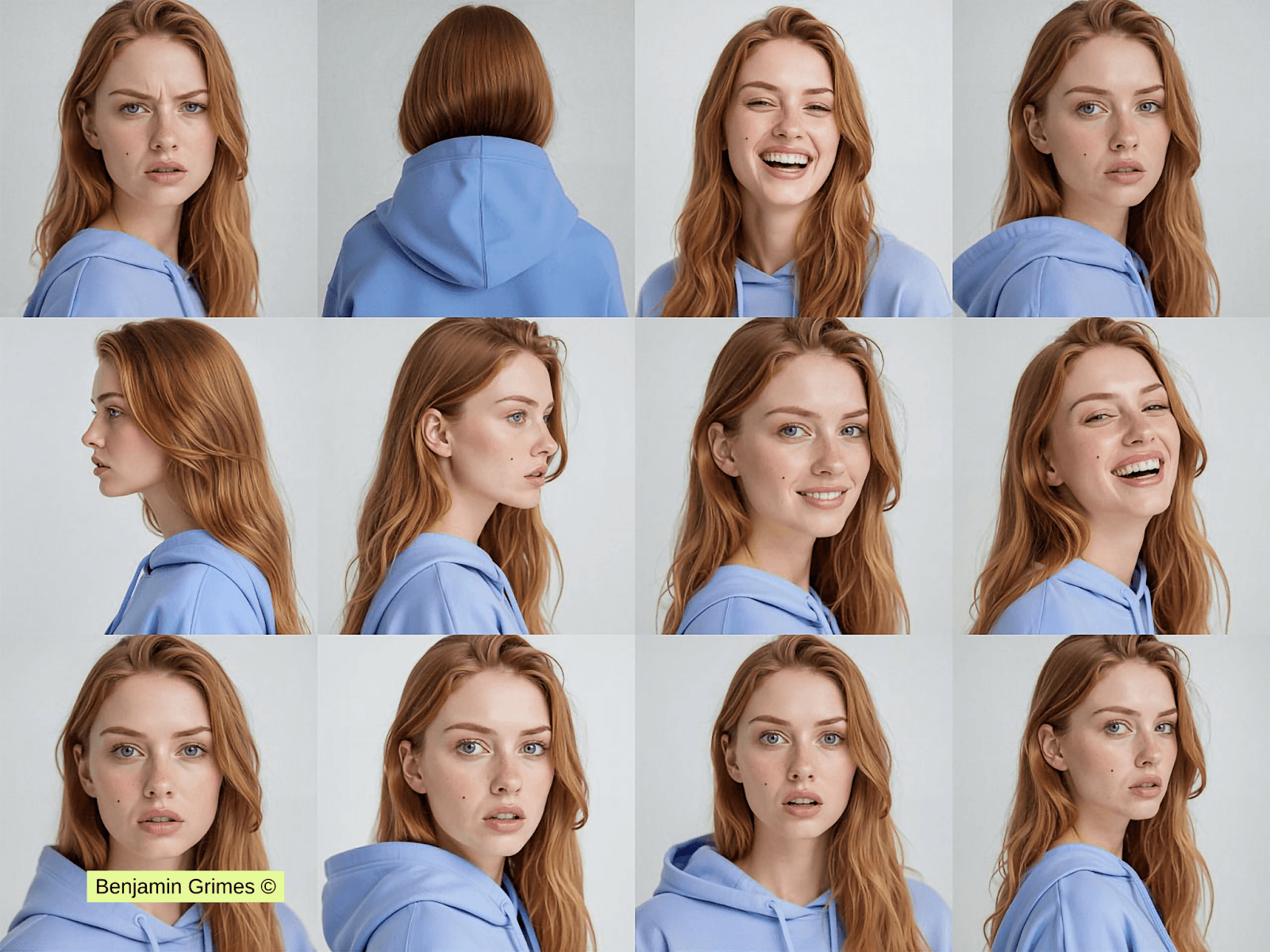

O segredo do LoRA não está no treinamento em si, mas na qualidade das imagens que você usa para treinar. É melhor ter 5 imagens bem feitas do que 20 fotos aleatórias. O ideal é ter entre 15 e 20 imagens que mostrem o personagem em vários ângulos, expressões e tipos de iluminação.

Se você treinar o LoRA apenas com fotos sorrindo, o modelo vai ter dificuldade em gerar cenas de conflito ou drama. Por isso, variedade é essencial.

Como testar um LoRA antes de gerar suas cenas

Antes de começar a gerar suas 20 cenas, faça testes em situações extremas: luz diferente, ângulos complicados, expressões exageradas. Se o personagem sair estranho, não tente consertar no prompt, volte e ajuste suas imagens de treino.

Onde treinar e usar o LoRA

Para treinar seu LoRA, você tem algumas opções de plataformas com sistema próprio de treinamento:

Freepik (via Custom Characters)

Krea AI

Leonardo.ai (via fine-tuning proprietário)

Depois de treinado, você pode usar o LoRA nessas mesmas plataformas ou em outras que aceitam LoRA externo. Nas plataformas que não permitem carregar LoRAs, como Midjourney ou Adobe Firefly, você vai precisar da segunda técnica que vamos ver a seguir.

Leia também: Animação com IA e os novos fluxos de criação com Midjourney e Freepik

Técnica 2: como manter o mesmo personagem usando imagem de referência

Nem sempre você precisa treinar um LoRA para manter um personagem consistente. Muitas plataformas de IA já permitem fazer isso usando uma imagem de referência do personagem.

Na prática, você mostra para a IA quem é o personagem e pede para ela gerar novas cenas mantendo aquela aparência.

Esse método funciona porque o modelo analisa a imagem de referência e tenta preservar elementos como rosto, estrutura do corpo, roupas e estilo visual, permitindo criar sequências de imagens diferentes sem perder a identidade do personagem.

A grande vantagem é a velocidade. Você não precisa treinar a IA e nem juntar vários materiais, basta ter uma boa imagem de referência.

Como funciona a referência de personagem no Midjourney

Nas versões antigas do Midjourney, esse controle era feito com o parâmetro --cref (character reference).

No V7, esse sistema evoluiu para o Omni Reference (--oref), que analisa a identidade visual do personagem de forma mais completa. Em vez de focar só no rosto, ele também considera corpo, roupas e estilo artístico.

Com ele, você usa uma imagem do personagem como referência no prompt.

Exemplo:

personagem caminhando com sacolas de compra --oref [imagem do personagem]

O Midjourney tenta manter aquela identidade ao gerar novas cenas:

Também existe um parâmetro chamado Omni Weight (--ow), que controla o quanto a referência influencia o resultado.

Valores moderados costumam funcionar melhor quando você quer criar várias cenas diferentes. Se o peso for alto demais, o personagem fica muito travado e a cena começa a se adaptar a ele de forma artificial.

Um detalhe importante sobre o Omni Reference: ao contrário do sistema anterior (--cref), ele foi desenvolvido para funcionar bem tanto com imagens geradas na plataforma quanto com fotos externas. Isso expande bastante as possibilidades, já que você pode usar uma foto de referência real como ponto de partida sem perder consistência.

Um truque útil para sequências longas

Se você seguiu a primeira dica e já criou o DNA do personagem, com imagens em diferentes ângulos, esse material já serve perfeitamente para aplicar essa técnica.

Em vez de usar apenas uma imagem como referência, vale reunir essas variações em uma única composição mostrando o personagem de frente, de perfil ou em três-quartos.

Essa pequena colagem ajuda a IA a entender melhor a estrutura do personagem e reduz erros quando ele aparece em ângulos diferentes ao longo da sequência.

Na prática, você está oferecendo ao modelo um mapa visual mais completo do personagem, em vez de depender de uma única imagem que pode não cobrir todas as situações da história.

Ferramentas que usam referência de personagem

Hoje várias ferramentas criativas já oferecem sistemas de referência de identidade.

Entre as mais usadas estão:

Midjourney V7 (Omni Reference)

Leonardo.ai (Character Reference)

Higgsfield (SOUL ID)

OpenArt (Character feature)

Adobe Firefly

Luma AI

Cada plataforma usa nomes diferentes, mas a lógica é sempre a mesma: você fornece uma imagem e a IA usa essa imagem como guia para gerar novas cenas.

Ferramentas mais avançadas em ambientes abertos

Em fluxos de trabalho mais técnicos, especialmente em ferramentas como ComfyUI, existem módulos que fazem esse mesmo tipo de referência de identidade de forma mais controlada.

Os dois mais conhecidos são:

IP-Adapter

Analisa uma imagem de referência e usa essas informações para manter o rosto e os principais traços do personagem durante a geração.

InstantID

Uma versão mais avançada desse processo, que costuma manter a identidade com mais precisão quando o personagem aparece em ângulos diferentes.

Essas ferramentas são muito usadas por quem trabalha com pipelines mais complexos, mas a lógica continua sendo a mesma que vimos acima: usar uma imagem para guiar a identidade do personagem.

Quando usar referência em vez de LoRA

A técnica de referência funciona melhor quando:

você precisa gerar imagens rapidamente

o personagem aparece em poucas cenas

você não quer treinar um modelo

Já o LoRA tende a ser mais estável quando o personagem aparece em muitas imagens ou em projetos mais longos.

Por isso, muitos fluxos profissionais acabam usando as duas abordagens em momentos diferentes do processo.

Técnica 3: gerar várias cenas ao mesmo tempo para manter consistência

As duas técnicas anteriores funcionam bem quando você gera uma cena por vez. A IA cria uma imagem, depois outra, sempre tentando manter o personagem consistente a partir de um treinamento ou de uma referência visual.

A terceira abordagem muda essa lógica. Em vez de tratar cada imagem isoladamente, algumas ferramentas conseguem gerar várias cenas como parte da mesma sequência. Na prática, o modelo entende que aquelas imagens pertencem à mesma história e tenta preservar a continuidade visual entre elas.

Quando cada cena é gerada separadamente, pequenas variações acabam aparecendo. Um detalhe da roupa muda, o cabelo ganha outro formato, algum acessório desaparece. Em imagens isoladas isso passa despercebido, mas em uma sequência longa essas diferenças começam a se acumular e o personagem perde consistência.

Quando o sistema trabalha com várias cenas ao mesmo tempo, ele consegue comparar os quadros durante a geração e manter os elementos visuais mais estáveis ao longo da narrativa. Por isso essa abordagem costuma ser usada em projetos como quadrinhos, storyboards ou sequências maiores.

StoryDiffusion e geração de sequência

Uma das ferramentas que popularizou esse tipo de fluxo foi o StoryDiffusion. Em vez de gerar uma única imagem por vez, ele permite criar várias cenas dentro do mesmo processo de geração.

Como essas imagens são calculadas juntas, o modelo consegue “olhar” para os outros quadros enquanto constrói cada cena. Isso reduz mudanças inesperadas de aparência e ajuda a preservar detalhes do personagem ao longo da sequência.

Esse tipo de sistema funciona quase como uma memória temporária. As cenas vão sendo geradas levando em conta o que já apareceu antes, o que ajuda a manter coerência visual quando a narrativa começa a se estender.

Flux e o uso de múltiplas referências

Outra abordagem aparece nos modelos da família Flux, que permitem trabalhar com várias imagens de referência ao mesmo tempo. Em vez de apresentar uma única imagem do personagem para a IA, você pode fornecer diferentes versões dele antes de gerar as cenas principais.

Esse processo cria uma base visual mais rica para o modelo. Ele passa a entender melhor a estrutura do personagem porque vê o rosto, o corpo e diferentes expressões antes de começar a construir a sequência narrativa.

Em projetos maiores, muitos criadores começam gerando algumas imagens do personagem em ângulos e estados diferentes. Essas imagens iniciais funcionam como uma espécie de conjunto de referência que acompanha o restante da geração. A partir daí, as cenas da história são criadas usando esse material como base, o que reduz as mudanças acumuladas que costumam aparecer em sequências muito longas.

Ferramentas que permitem esse tipo de fluxo

Esse tipo de geração em sequência ainda aparece mais em ambientes abertos ou ferramentas voltadas para narrativa.

Algumas das opções mais usadas hoje são:

StoryDiffusion no ComfyUI

Flux com múltiplas referências no ComfyUI

LTX Studio para geração de cenas narrativas

Cada uma dessas ferramentas implementa a ideia de forma diferente, mas o objetivo é o mesmo: manter continuidade visual quando você precisa gerar muitas cenas do mesmo personagem.

Quando usar essa técnica

Esse tipo de abordagem faz mais sentido quando o projeto envolve muitas imagens conectadas. Em narrativas visuais longas, tratar as cenas como parte de um mesmo bloco costuma produzir resultados mais estáveis do que gerar cada quadro de forma completamente independente.

Para sequências curtas, as técnicas de LoRA ou de referência de imagem costumam ser mais rápidas. Mas quando a história começa a crescer, trabalhar com geração em sequência ajuda bastante a preservar a identidade visual do personagem.

Erros comuns que quebram a consistência de personagem em IA

Conhecer as três técnicas ajuda muito, mas não resolve tudo. Mesmo com um fluxo de trabalho bem montado, existem situações específicas em que a identidade do personagem começa a quebrar.

O problema é que essas falhas nem sempre aparecem logo de cara. Em uma imagem isolada tudo parece correto. Quando você olha a sequência inteira percebe pequenas mudanças que fazem o personagem parecer outra pessoa.

Existem alguns tipos de cena em que isso acontece com mais frequência:

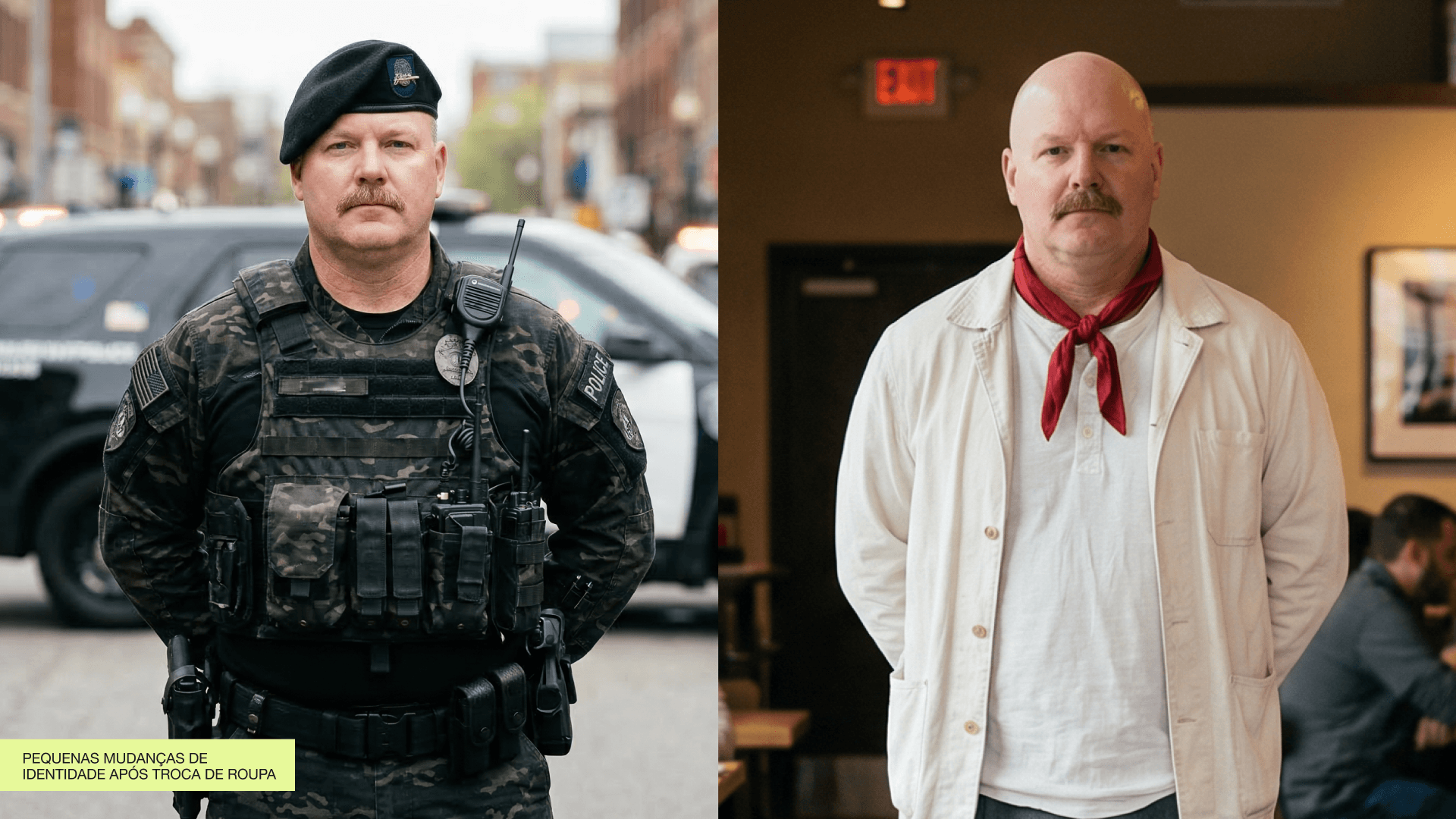

Trocas de roupa

Mudanças de roupa são um dos pontos mais críticos em sequências longas.

Modelos de imagem aprendem associações fortes entre aparência e estilo visual durante o treinamento. Certos tipos de rosto acabam sendo ligados a determinados estilos de roupa dentro do material usado para treinar o modelo.

Quando o mesmo personagem aparece primeiro em uniforme e depois em roupas casuais, por exemplo, o modelo pode tentar ajustar levemente o rosto para combinar com o novo contexto visual. A mudança é pequena, mas suficiente para criar inconsistência quando você compara as imagens lado a lado.

Uma forma simples de reduzir esse problema é criar uma imagem âncora para cada roupa importante da história. Se o personagem aparece com três figurinos diferentes ao longo da narrativa, vale ter três referências separadas mostrando aquele mesmo personagem com cada roupa.

Detalhes que aparecem do nada

Outro problema comum é quando o modelo começa a adicionar elementos que nunca fizeram parte do personagem.

Isso acontece porque a IA tenta completar a cena com base no contexto. Um personagem em um ambiente urbano noturno pode ganhar barba sem que você tenha pedido. Em uma cena de verão ele pode aparecer usando óculos escuros, mesmo que isso nunca tenha sido definido antes.

Essas adições parecem naturais isoladamente, mas acabam criando inconsistência quando você olha a sequência completa. Por isso, vale repetir algumas restrições ao longo dos prompts, principalmente quando você quer manter características muito específicas do personagem, como cor de cabelo, ausência de barba ou acessórios que não devem aparecer.

Rostos que mudam em planos abertos

Cenas mais abertas também costumam gerar inconsistências, especialmente quando o personagem aparece longe da câmera.

Quando o rosto ocupa poucos pixels da imagem, o modelo tende a simplificar os detalhes para priorizar outros elementos da composição. O resultado é que o personagem parece correto em um close, mas ligeiramente diferente quando aparece ao fundo em outra cena.

Em fluxos de trabalho mais avançados, algumas ferramentas conseguem detectar automaticamente o rosto e refinar apenas essa região da imagem. Isso ajuda a preservar os traços mesmo quando o personagem não está em primeiro plano.

Sem esse tipo de correção, é comum que o close de uma cena mostre um rosto consistente enquanto o mesmo personagem, em um plano aberto da sequência, pareça outra pessoa.

Conclusão: onde a consistência realmente nasce

A consistência de personagem em IA deixou de ser um problema sem solução. As ferramentas existem, os fluxos de trabalho já são conhecidos e os resultados deixaram de ser sorte. O que ainda falta é encarar o processo com a mesma seriedade com que um diretor de arte encara a construção de um personagem em uma produção convencional.

Gerar 20 cenas com o mesmo personagem usando IA é tecnicamente possível, desde que você entenda uma coisa importante: a coerência não é uma propriedade do modelo, é uma consequência do seu método de trabalho.

A pergunta que vale se fazer antes de iniciar qualquer produção de personagem não é “qual ferramenta usar”, mas qual âncora estou fornecendo ao modelo em cada cena. Se a resposta for nenhuma, as técnicas não vão ajudar muito. Se a resposta for uma imagem âncora bem construída, uma palavra-chave do personagem treinada e um fluxo de referência consistente, você passa a ter o nível de controle que esse tipo de produção exige.

O resto ainda é direção criativa. E essa parte continua dependendo de você.

Se você quiser levar esse controle visual ainda mais longe, vale explorar também a construção de moodboards para geração de imagens com IA. Eles ajudam a organizar referências de estilo, cor e atmosfera antes mesmo da primeira geração, o que reduz bastante a inconsistência nas imagens finais. Neste guia, mostramos como usar moodboards em ferramentas como Midjourney, Higgsfield e Freepik para orientar o processo criativo desde o início.