Nando

CEO | FOUNDER

Você com certeza já passou por isso: gerou uma imagem com IA, o resultado ficou impressionante, com ótima luz, composição forte, exatamente como imaginou. Aí você chega mais perto para admirar e lá está o problema: o personagem principal tem seis dedos na mão. Ou então você cria um anúncio lindo, paleta de cores impecável, produto no ângulo ideal, mas o texto na embalagem virou um borrão ilegível ou um monte de letras inventadas.

É sempre aquele detalhe quase imperceptível à primeira vista que acaba quebrando tudo que você descreveu cuidadosamente no prompt.

E então surge a dúvida estratégica: gerar tudo de novo e torcer para a IA acertar ou corrigir apenas o detalhe?

A maturidade no uso de IA para imagem começa justamente aí. Quando o foco deixa de ser apenas gerar e passa a ser decidir, refinar e intervir com critério.

Neste conteúdo vamos aprofundar:

edição localizada

ajuste inteligente

fluxos híbridos (IA + edição manual)

critérios profissionais de decisão estratégica

Porque ficar preso à regeneração infinita não é método, é só desperdício de tempo, de créditos e, principalmente, de energia criativa.

O que é edição localizada e por que ela é uma habilidade importante para imagem com IA

Gerar imagens por prompt já deixou de ser diferencial. O que diferencia profissionais hoje é controle e consistência.

A edição pontual, também chamada de inpainting, permite alterar apenas uma área específica da imagem, preservando o restante intacto. Na prática, você cria uma máscara sobre o trecho problemático e orienta a IA a recriar apenas aquela região, respeitando luz, textura e contexto ao redor.

Esse recurso está presente em diferentes níveis de refinamento em ferramentas como Nano Banana Pro, Photoshop, Stable Diffusion, Midjourney, Leonardo.ai e Canva.

A lógica é simples: se 90% da imagem atende ao briefing e apenas 10% apresenta erro, descartar tudo que funciona é ineficiente.

No contexto de mercado ou de produção em escala, isso significa mais créditos consumidos, mais tempo gasto e maior risco de gerar novos problemas em áreas que já estavam aprovadas.

Aqui o que vai diferenciar um profissional criativo de um amador é o entendimento real de saber quando preservar o que funciona, corrigindo apenas o que compromete, e quando reiniciar o projeto. É uma lógica simples de eficiência.

Leia também: Introdução ao Briefing para IA: dicas práticas para criar prompts que funcionam

A decisão que realmente impacta sua produtividade: editar a imagem com IA ou começar de novo?

Apesar de parecer uma escolha simples, essa é uma decisão que pode mudar totalmente o seu tempo de criação, sua entrega e até o orçamento do projeto. Saber quando vale ajustar e quando é melhor regenerar tudo do zero é uma escolha estratégica.

Sendo bem honestos, nem todo erro precisa de inpainting e nem toda imagem “quase boa” merece ser salva. O critério é: edite quando a estrutura geral está certa e regenere quando a base está errada.

Se o ângulo da câmera não conversa com o objetivo, se a perspectiva compromete a credibilidade ou se a iluminação inteira transmite um clima diferente do que você precisa, insistir em ajustes locais costuma virar um remendo sobre outro remendo. A imagem pode até melhorar em partes, mas continua incoerente no todo. Quando o problema é estrutural, o mais inteligente é assumir o erro, repensar a intenção e reconstruir.

A base precisa funcionar antes do refinamento. Sem isso, você só está gastando tempo tentando salvar algo que nasceu sem propósito.

Agora, do outro lado, existe uma composição em que a imagem de IA está boa, o enquadramento funciona, a luz conversa com a proposta, mas há um detalhe fora do lugar. E aí, em vez de corrigir pontualmente, você começa a regenerar tudo de novo, na esperança de que venha perfeito. Resultado: perde uma base excelente por causa de algo que levaria poucos minutos para ajustar.

Em ambiente de agência, por exemplo, essa decisão pesa diretamente no prazo e no custo. Não faz sentido gerar dez variações esperando que uma saia impecável se você já tem uma boa fundação. Nesse caso, ajuste com precisão a melhor versão disponível.

Duas regras práticas ajudam muito nesse sentido:

- se a composição geral já está aprovada, você está na fase de edição.

- se ainda está testando caminhos criativos, está na fase de geração.

Misturar essas fases é o erro mais caro de quem trabalha com IA.

Leia também: O futuro da composição visual: IA como ferramenta, humano como critério

Os erros mais comuns que exigem edição pontual em imagens de IA

Mesmo com evolução acelerada dos modelos, algumas falhas permanecem recorrentes:

Anatomia ainda é um dos principais desafios. Mãos com dedos extras, articulações incoerentes, proporções levemente distorcidas ou expressões desalinhadas pesam especialmente em cenas com interação física complexa.

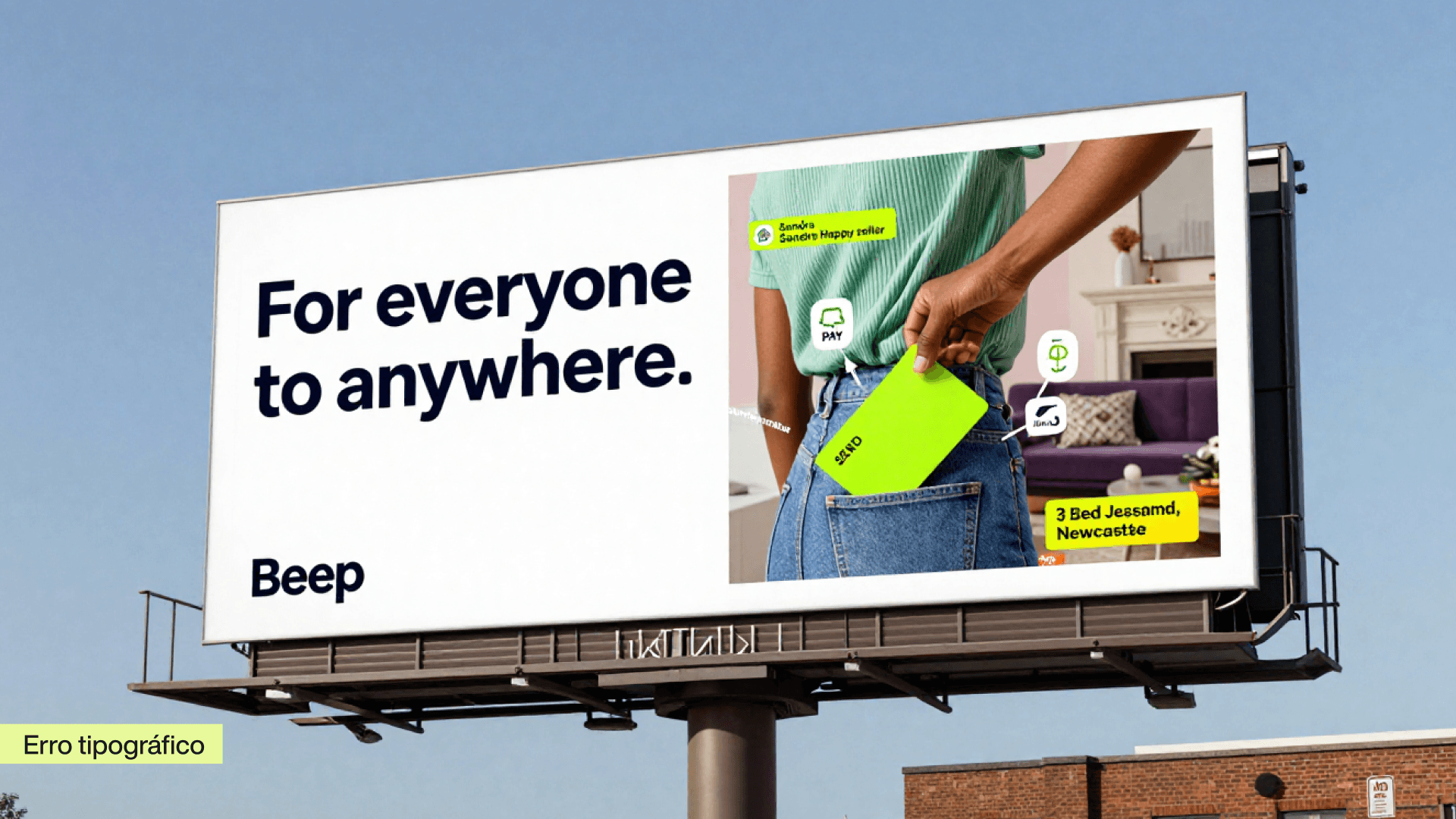

Outro ponto crítico é o texto. Embalagens, placas, rótulos e tipografia institucional continuam sendo áreas sensíveis. Embora os modelos estejam mais competentes, ainda é comum ver letras distorcidas ou inconsistentes, o que compromete imediatamente qualquer peça publicitária.

Objetos também sofrem com distorções estruturais. Cadeiras que não tocam o chão, copos com base impossível, sombras incoerentes e reflexos errados denunciam a natureza sintética da imagem. Em branding de produto, pequenos desvios de proporção já são suficientes para invalidar uma peça inteira, já que um produto levemente diferente do real pode comprometer a confiança e a conversão.

Em todos esses casos, a edição localizada é mais inteligente do que recriar a imagem inteira.

Por que esses erros em IA existem e quais são as alternativas para resolver

Texto ilegível: quando o modelo não consegue escrever

Este é um dos erros que mais frustram designers trabalhando com mockups, campanhas publicitárias ou qualquer peça visual que precise incluir palavras legíveis.

O problema começa na maneira como esses modelos aprendem. Modelos de difusão como DALL·E, Midjourney e até Stable Diffusion aprendem a partir de pixels, não de símbolos linguísticos. Eles veem o texto como textura visual, sem entender que cada letra tem uma forma específica que precisa ser preservada.

Hoje, o Nano Banana Pro já ajuda a resolver esse problema com raciocínio visual. Ao contrário de modelos de difusão puros, ele planeja a lógica da cena antes de gerar. Um diferencial técnico também é a capacidade de inserir até 14 imagens de referência para guiar a criação. Isso significa que você pode carregar o logotipo real de uma marca, a tipografia oficial, exemplos de produtos e instruir o modelo a manter esses elementos visuais idênticos enquanto compõe a cena.

Para mockups, a diferença é grande. Você gera uma embalagem base com qualquer ferramenta e depois usa o Nano Banana Pro para inserir o nome da marca, ingredientes, código de barras, tudo legível em alta resolução.

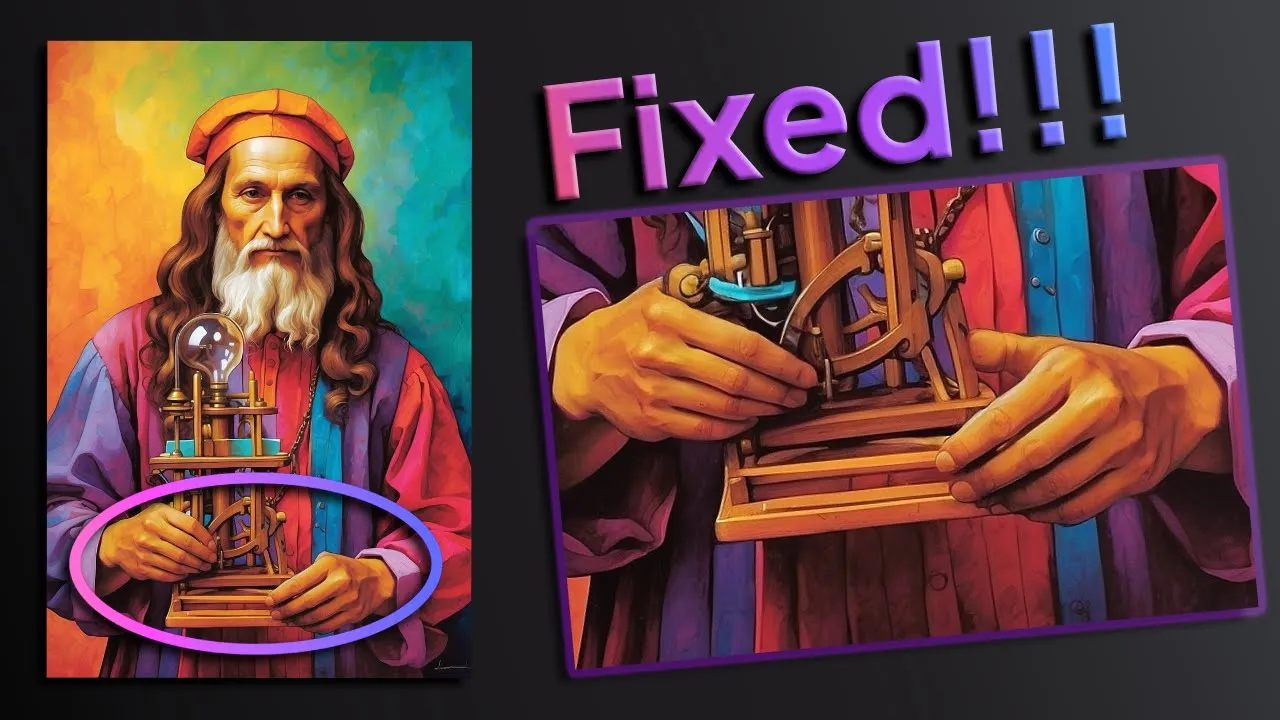

Mãos deformadas: anatomia e refinamento controlado

Mão é aquele detalhe que entrega tudo. Você pode ter criado uma cena linda, luz ideal, composição equilibrada e aí a pessoa tem dedos a mais ou um polegar que parece ter sido colado depois.

Isso não é acaso. Mãos são, historicamente, o ponto fraco dos modelos generativos. Eles aprendem com bilhões de imagens planas, mas não “entendem” volume como um humano entende. Em fotos reais, mãos aparecem em infinitas sobreposições e ângulos, tornando difícil para a IA entender os padrões e as formas. E o resultado a gente já conhece.

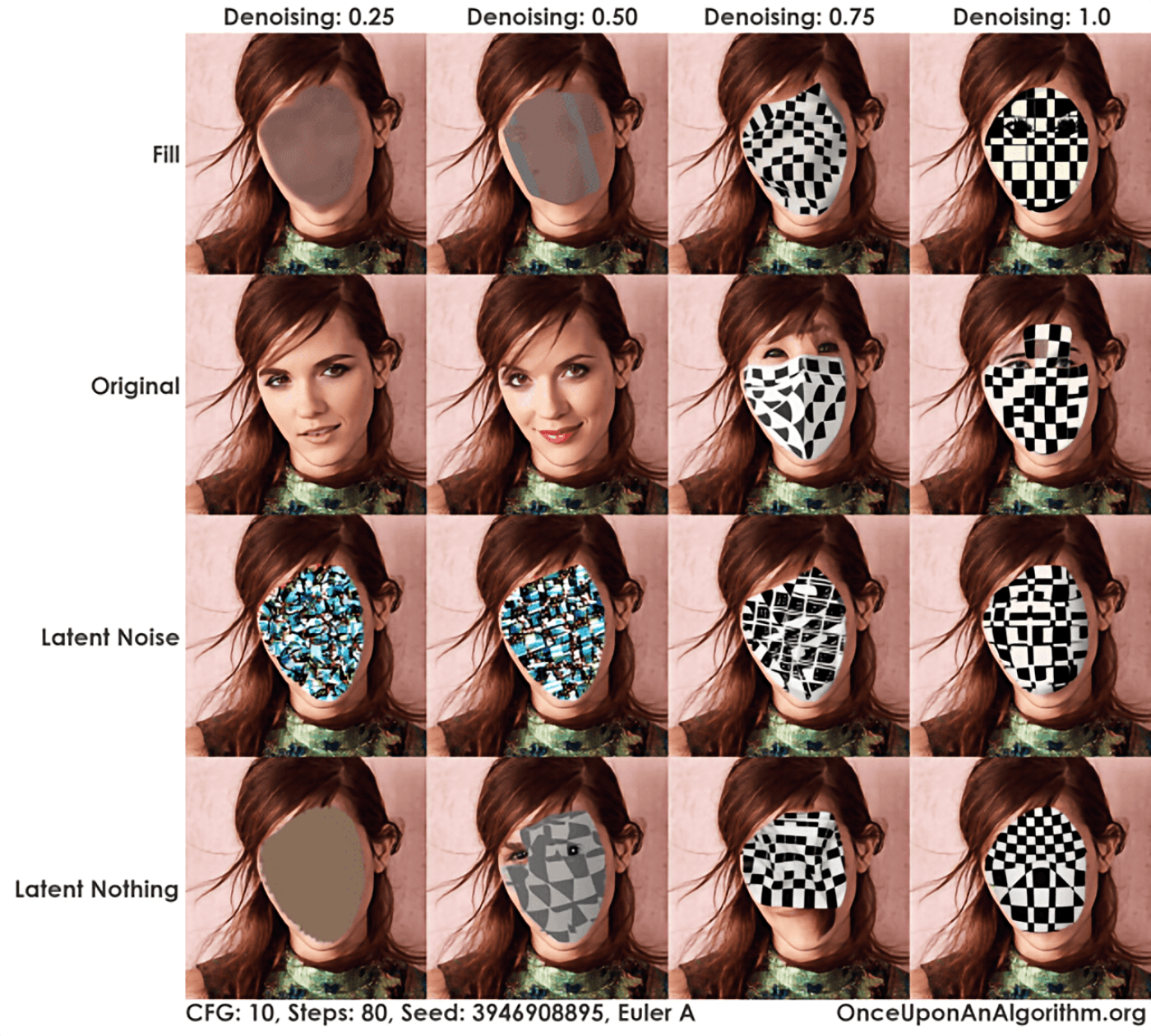

Se você usa Stable Diffusion, tem um jeito bem eficiente de resolver isso sem bagunçar o resto da imagem, com o modo Only Masked. Em vez de regenerar tudo, você seleciona apenas a área da mão e corrige ali. O sistema amplia essa região, trabalha com mais definição e depois encaixa de volta na imagem. Isso evita aquele efeito borrado que aparece quando você tenta ajustar um detalhe minúsculo na imagem inteira.

Vale reforçar um ponto importante: o equilíbrio aqui vem do recurso Denoising Strength, que deve ficar entre os parâmetros 0.60 e 0.75, e é o que vai dizer o quanto você quer que a IA edite da sua imagem. Em resumo, se você quase não deixa a IA mexer, ela mantém a deformação original. Se deixa o parâmetro solto demais, ela perde a referência de luz e perspectiva. O segredo é ajustar o suficiente para reconstruir a mão, mas não tanto a ponto de desmontar o contexto. Quando você combina isso com ferramentas como ControlNet DWPose que reconhecem a estrutura do corpo, as chances de sair um resultado bem posicionado aumentam muito.

Agora, se a sua ideia for simplificar o processo, o Nano Banana Pro também entra como um assistente interessante. Em vez de ficar calibrando parâmetros, você pode simplesmente pedir algo como: corrija a mão para ter cinco dedos em posição natural, mantendo a iluminação e as dobras da pele. O modelo interpreta a intenção e executa respeitando o contexto da cena.

Na prática, isso reduz bastante o vai e vem de tentativa e erro.

Consistência de identidade em múltiplas imagens

Um dos problemas mais persistentes da IA generativa é manter a mesma pessoa, produto ou personagem consistente ao longo de múltiplas imagens. Você gera uma foto de um modelo para uma campanha, mas quando tenta gerar a mesma pessoa em outra pose ou cenário, o rosto muda completamente.

Antes do Nano Banana Pro, por exemplo, a solução exigia workflows complexos de LoRAs no Stable Diffusion: você treinava um modelo personalizado com 20 a 50 fotos da pessoa, um processo que levava horas e exigia conhecimento técnico mais avançado.

Agora, com a combinação de referências, você carrega até 14 imagens de base antes de gerar ou editar. Uma marca de moda que precisar criar catálogo com 50 looks diferentes da mesma modelo pode fotografar a modelo em cinco poses base com roupa neutra. Carregar essas cinco fotos como referência no Nano Banana Pro e instruir: substitua a roupa por vestido midi azul marinho com estampa floral, mantendo exatamente os traços faciais, a postura e a iluminação de estúdio.

Leia também: Inteligência artificial na moda: dados, criação e o novo processo das marcas

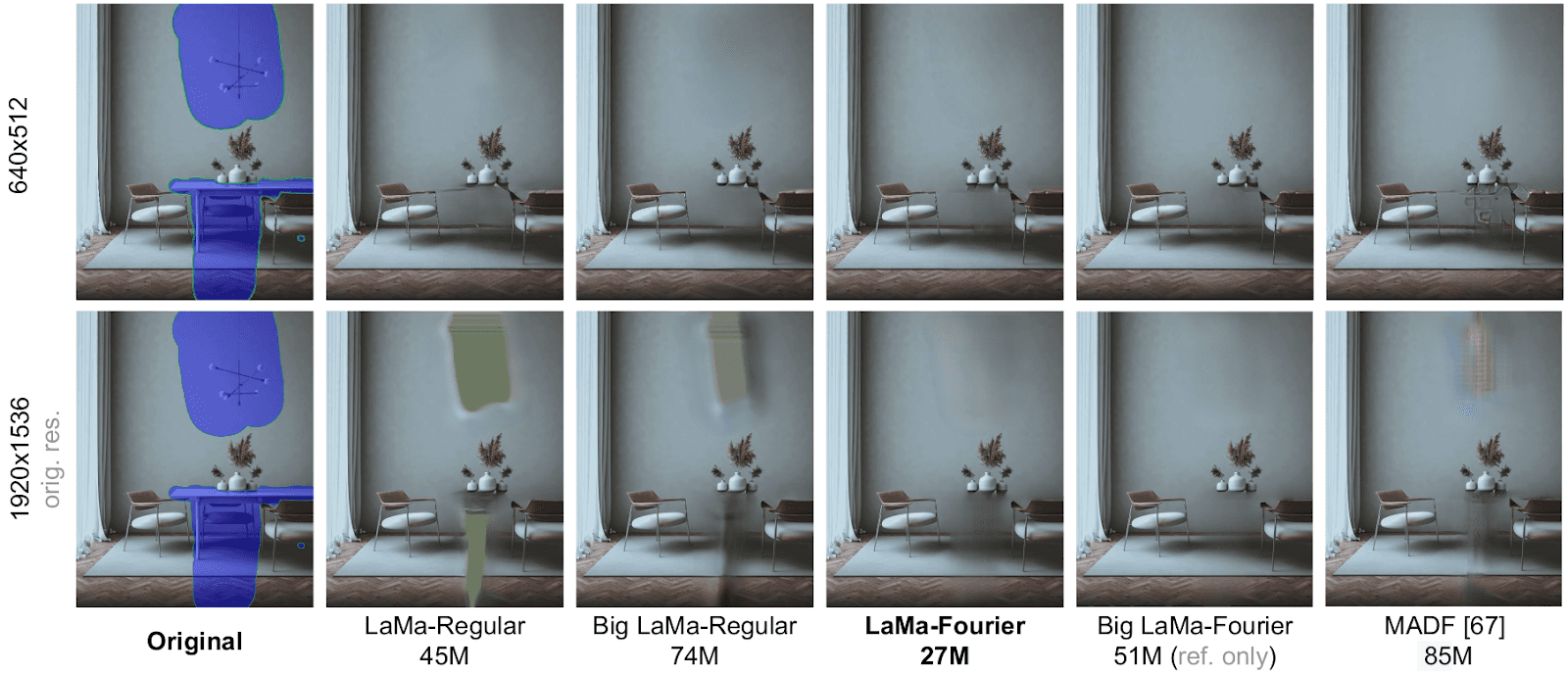

Remoção de objetos complexos

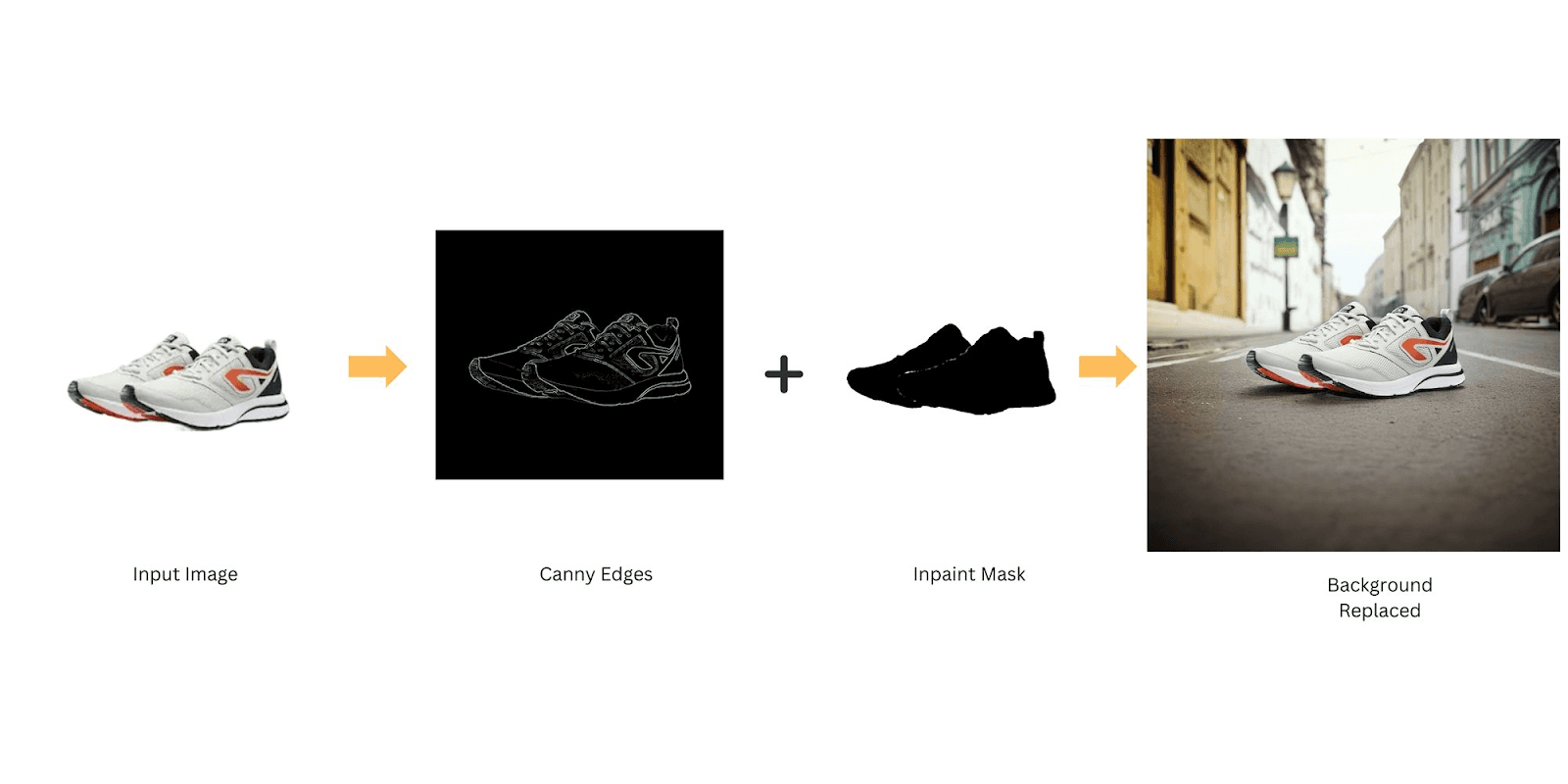

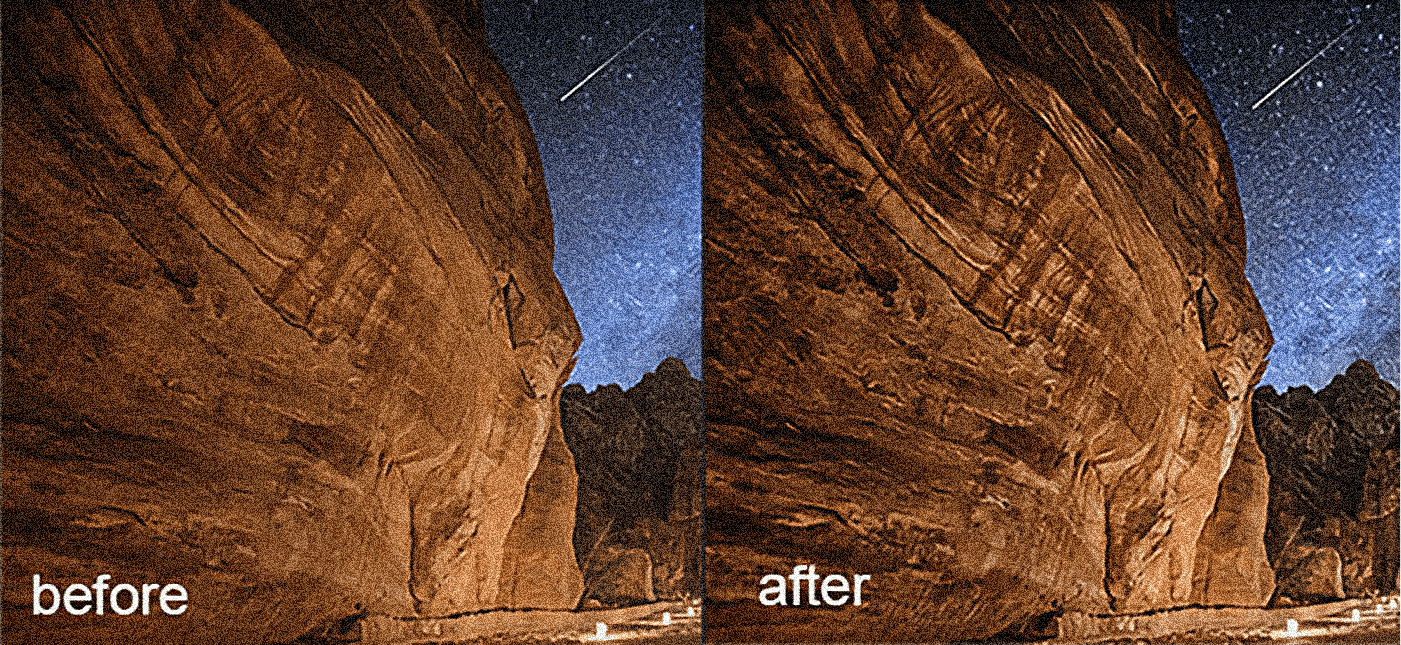

Quando você precisa remover objetos complexos de uma cena, como carros, placas, fios elétricos, turistas em fotos de monumentos, o inpainting padrão frequentemente deixa artefatos ou reconstruções inconsistentes. O pré-processador conhecido como LAMA (Large Mask Inpainting) foi desenvolvido especificamente para resolver isso.

O LAMA é um modelo treinado especificamente para reconstruir o que está atrás do objeto que você quer remover. Em vez de só “tampar o buraco”, ele refaz o fundo de maneira mais coerente. Funciona muito bem em cenas urbanas, por exemplo. Tirar fios do céu, apagar pessoas ao fundo ou remover elementos que poluem a composição costuma ficar bem mais natural com ele.

A diferença está na forma como ele trabalha: não olha apenas para os pixels colados na máscara, mas tenta entender a lógica da cena inteira. A partir disso, reconstrói aquele trecho como se o objeto nunca tivesse estado ali, respeitando padrões de textura, luz e continuidade do espaço.

No Stable Diffusion, o caminho é relativamente simples. Você marca o objeto com uma máscara um pouco mais ampla, incluindo sombras e reflexos, ativa o ControlNet Inpaint com o LAMA como pré-processador e ajusta a intensidade da intervenção para que o modelo realmente reescreva aquela área.

Aqui, diferente de correções mais sutis, é importante permitir uma reconstrução mais profunda, mexendo nos parâmetros do inpaint para não preservar rastros do objeto original. Quando bem calibrado, o resultado parece uma continuação natural da cena, mesmo em texturas mais complexas como asfalto, céu ou fachadas.

Passo a passo de como fazer edição pontual em imagens de IA

Ao criar a máscara, evite selecionar apenas o objeto exato. Amplie levemente a área ao redor. Essa margem permite que a IA ajuste transições de sombra e textura de forma natural. Máscaras muito apertadas tendem a gerar efeito de colagem.

A instrução textual precisa ser específica. Em vez de “corrigir mão”, prefira algo como “ajustar mão direita para proporção natural, com cinco dedos definidos e iluminação lateral suave, mantendo a textura de pele consistente com o restante da cena”. Quanto mais clara a intenção, maior a chance de coerência.

O mesmo vale para remoções em cenários abertos. Em vez de “tirar fios”, descreva: “remover os fios elétricos que cruzam o céu atrás da tabela de basquete, reconstruindo o fundo com céu azul contínuo e nuvens suaves, preservando a iluminação natural da cena e a profundidade do horizonte”. Assim, você orienta o modelo não só sobre o que deve desaparecer, mas sobre como o espaço precisa ser reconstruído para que a imagem continue natural.

Em ambientes como Stable Diffusion, o controle de intensidade da alteração é crucial para um resultado satisfatório. Valores baixos preservam textura original, enquanto valores altos substituem completamente o conteúdo selecionado.

Saber calibrar esse parâmetro é o que diferencia um resultado refinado de uma imagem genérica. Após a geração, sempre revise em zoom real. Muitos erros passam despercebidos em visualização reduzida e aparecem apenas em resolução total.

Agora vamos mostrar algumas ferramentas que ajudam no processo de edição localizada:

Adobe Photoshop: hub profissional com múltiplos modelos

O Photoshop hoje funciona como um hub de IA dentro do fluxo profissional. A Adobe vem ampliando o sistema para permitir o uso de diferentes motores generativos diretamente na Barra de Tarefas Contextual, sem que o designer precise sair do ambiente de trabalho.

O preenchimento generativo é um marco porque transforma o conteúdo criado em uma camada que preserva a imagem original. Isso significa que você pode ajustar cor, máscara, mesclagem e contraste depois da geração, sem comprometer a base da imagem.

Um fluxo comum é gerar a cena-base em ferramentas generativas e finalizar no Photoshop. É ali que entram integração de luz, correções anatômicas via inpainting e ajustes técnicos para impressão.

Entre os modelos disponíveis, destacamos:

Adobe Firefly

Foco em segurança comercial e integração com o ecossistema Adobe.

FLUX.1

Alto nível de realismo e fidelidade ao prompt.

Gemini (Nano Banana Pro)

Especialmente eficiente na geração de texto legível e raciocínio visual.

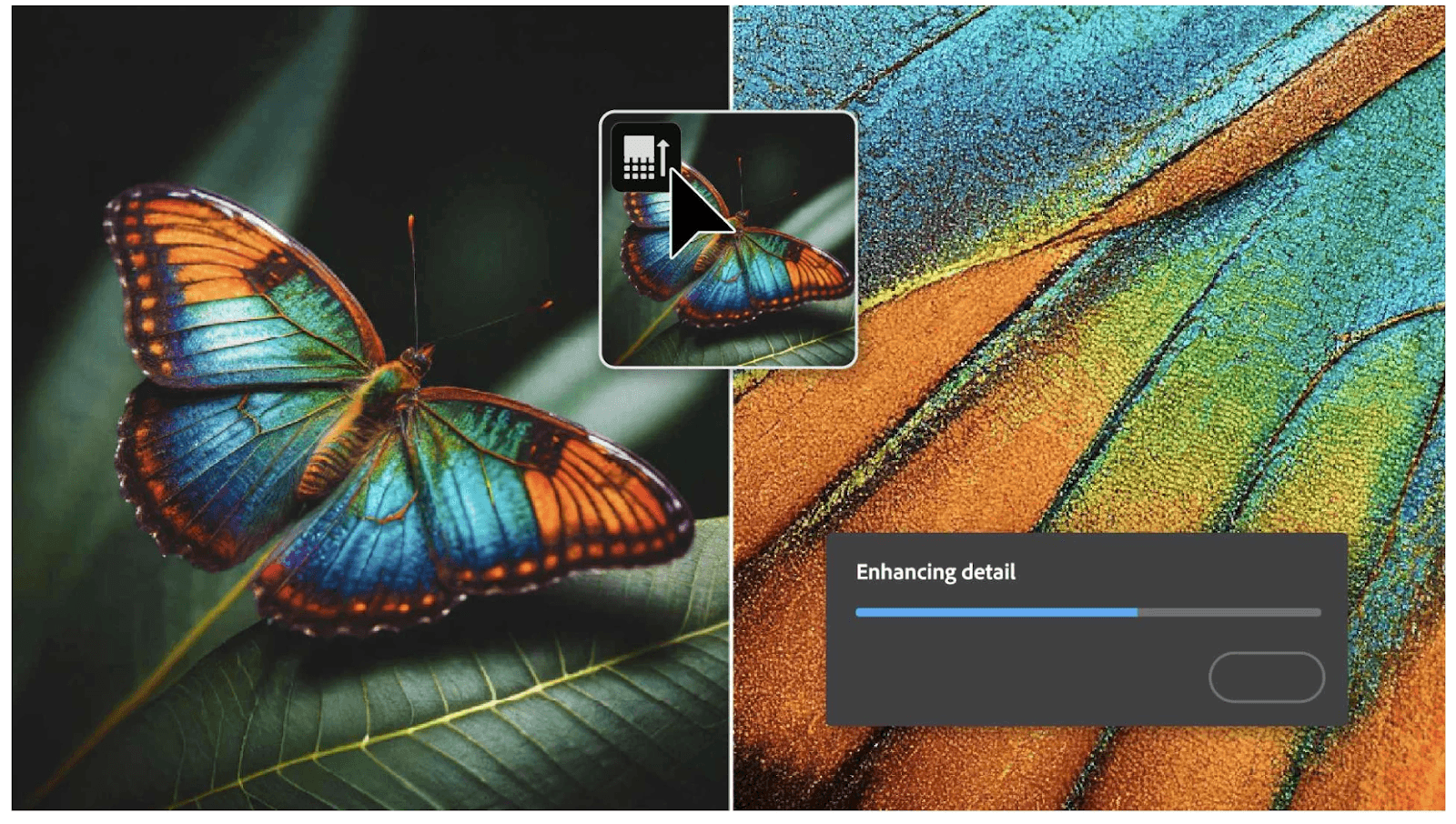

O recurso Enhance Detail também é relevante para arquivos de grande formato, adicionando nitidez e microtexturas após a geração inicial.

Vale lembrar que o Photoshop já está integrado ao ChatGPT. Isso fortalece especialmente o inpainting e a edição localizada. Em vez de testar variações aleatórias, você pode descrever exatamente o que precisa naquela área específica da imagem e ajustar um detalhe sem comprometer o todo.

Essa combinação de seleção precisa, camadas que preservam a imagem original e instruções em linguagem natural transforma a IA em ferramenta de refinamento, não apenas de geração. É aí que o Photoshop mostra seu valor no fluxo profissional.

Stable Diffusion e o controle estrutural

O Stable Diffusion continua sendo a escolha de quem precisa de controle fino sobre a imagem de IA. É um ambiente voltado à direção criativa, com arquitetura e integração com o ControlNet para guiar a geração a partir de mapas de profundidade, contornos ou poses. Aqui, a geração deixa de ser automática e passa a ser mais conduzida.

Entendendo o Denoising Strength

No inpainting, o parâmetro central do Stable Diffusion é o Denoising Strength. Ele define o quanto da área selecionada será reconstruída e pequenas variações alteram significativamente o resultado.

0.00 a 0.20

Preservação quase total. Indicado para remover imperfeições, corrigir brilho ou realizar ajustes sutis de cor mantendo a estrutura original.

0.30 a 0.45

Modifica textura preservando forma. Funciona bem para suavização de pele, ajustes de maquiagem ou mudanças discretas de material.

0.50 a 0.65

Permite reconfigurações moderadas. Correções anatômicas leves, ajustes de expressão ou pequenas alterações de pose se encaixam nessa faixa.

0.70 a 0.85

Reestruturação intensa. Adequado para adicionar acessórios ou modificar partes relevantes do cenário.

A diferença entre um retoque preciso e uma distorção inesperada costuma estar nessa calibragem.

Inpainting com ControlNet

Ao combinar inpainting com ControlNet, o nível de precisão aumenta consideravelmente. Mapas de borda ou de pose permitem reconstruções mais profundas preservando a base original.

Em e-commerce, por exemplo, você pode manter o design exato de um produto e alterar apenas material, textura, fundo ou acabamento. A forma permanece, mas a superfície muda. Esse tipo de controle pode ser difícil de alcançar em plataformas mais fechadas.

Existe, claro, um custo: a curva de aprendizado é maior. Mas para quem trabalha com produção recorrente ou precisa de previsibilidade, o retorno compensa. O Stable Diffusion exige ajuste, teste e intenção, mas entrega controle proporcional ao investimento técnico.

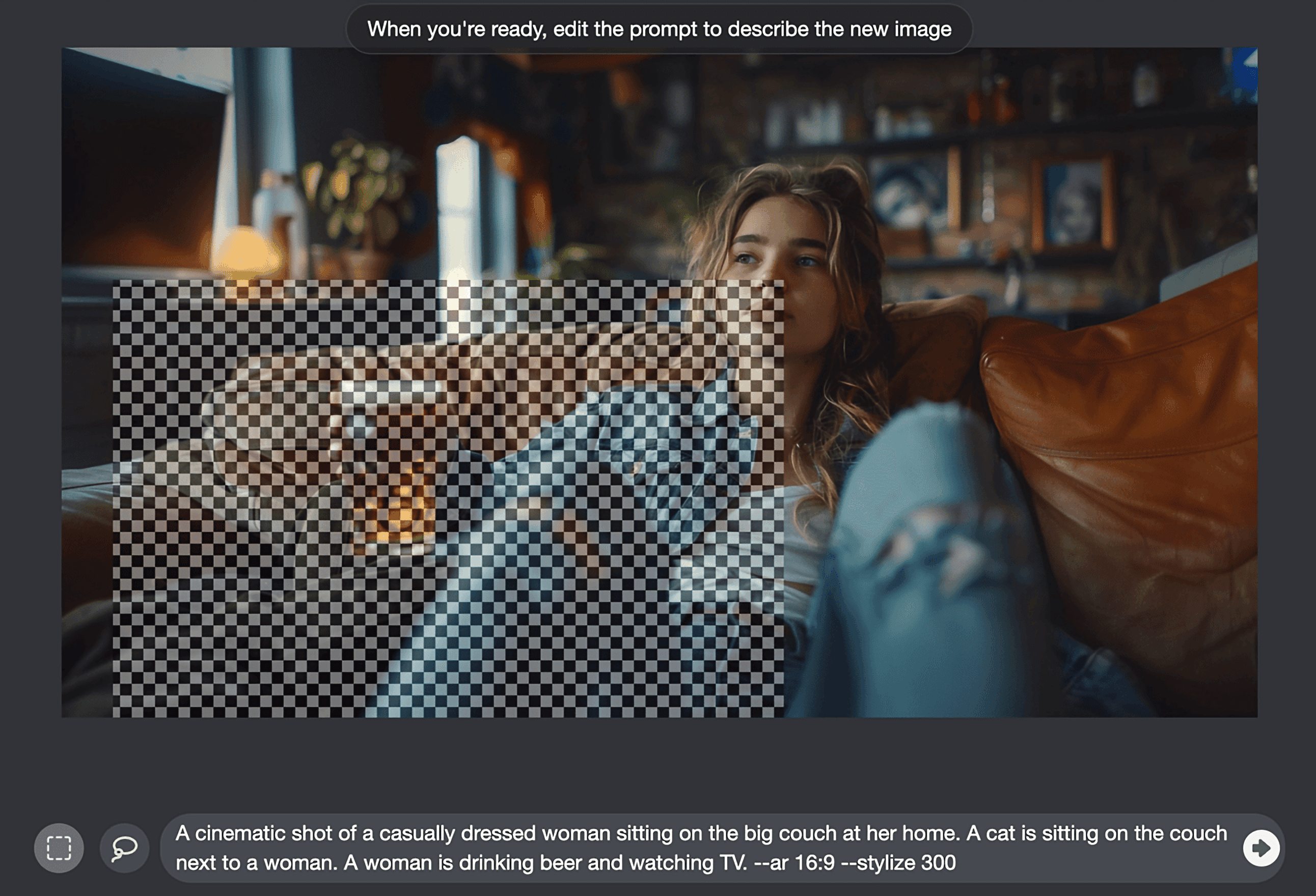

Midjourney: excelência estética e Vary Region

O Midjourney se destaca pela consistência estética e pela coerência artística entre luz, textura e composição. Ele busca manter fidelidade na integração de elementos orgânicos complexos, como fios de cabelo e reflexos em superfícies curvas, apresentando acabamento mais uniformes.

Vary Region e Remix Mode

A edição localizada acontece via Vary Region. Quando combinada ao Remix Mode, a ferramenta permite selecionar uma área específica e reescrever o prompt apenas para aquele trecho da imagem. O sistema preserva automaticamente o estilo geral, mantendo paleta de cores, grão e direção de luz alinhados ao restante da composição.

O resultado é visualmente mais coeso, com intervenções que se integram de forma natural ao conteúdo original.

Editor Web e fluxo contínuo

Com o Editor Web unificado, o inpainting passou a compartilhar o mesmo ambiente de controles de câmera como Pan e Zoom (outpainting). Isso cria um fluxo circular de trabalho: é possível expandir o cenário e, em seguida, ajustar detalhes localizados sem interromper o processo.

Limitações técnicas

A principal restrição está nas ferramentas de seleção. O sistema trabalha com pincel básico, sem caneta vetorial ou detecção automática de objetos. Projetos que exigem precisão fina demandam mais esforço manual.

A escala da máscara também influencia o desempenho. Intervenções muito pequenas podem perder definição, enquanto áreas amplas tendem a modificar luz e atmosfera de maneira mais intensa.

Para concept art, campanhas publicitárias e imagens orientadas a impacto visual, o Midjourney entrega resultados fortes. Em contextos que exigem controle cirúrgico de cada contorno, o fluxo de trabalho se torna mais limitado.

Leonardo.ai: agilidade com controle técnico

Leonardo.ai combina controle técnico com praticidade. A proposta é permitir iteração rápida em projetos que exigem consistência visual e continuidade entre versões.

AI Canvas e edição espacial

O centro da experiência é uma área de trabalho infinita, onde a edição acontece diretamente sobre a imagem. Você move a caixa de geração sobre a área marcada, e a integração é processada ali mesmo. O fluxo é contínuo e facilita ajustes sucessivos sem quebra de contexto.

Subject Reference e consistência de personagem

Dentro do editor, o recurso de Subject Reference amplia o controle em projetos narrativos. Ao alterar roupa, acessórios ou detalhes específicos via inpainting, é possível utilizar uma imagem de referência externa para preservar traços faciais, proporções e estilo visual. Isso reduz variações indesejadas entre cenas ou composições.

Liberdade de modelo

No Leonardo.ai, você pode escolher qual modelo usar na hora de editar. Dá para optar pelos modelos próprios da plataforma, como o Phoenix, que responde melhor ao comando escrito e lida bem com texto na imagem, ou usar modelos da comunidade baseados em SDXL, uma versão mais avançada do Stable Diffusion, conhecida por gerar imagens com mais definição e melhor compreensão de detalhes.

Na prática, isso permite ajustar o estilo da área editada conforme o objetivo, seja algo mais realista ou mais ilustrado.

Live Canvas

O Live Canvas permite desenhar diretamente sobre a imagem para guiar a edição. Você faz um esboço simples e a IA usa esse desenho como base para gerar o resultado final. É uma forma de direcionar a edição localizada com a própria mão, em vez de depender só do texto.

Canva: rapidez e edição prática

O Canva se firmou como a ferramenta ideal para quem precisa produzir muito, em pouco tempo. A proposta é simples: resolver rápido, sem exigir conhecimento técnico de edição avançada.

Dentro do Magic Studio, o processo de inpainting vira algo direto. Para marketing digital e redes sociais, a Edição Mágica resolve trocas de objetos, fundo ou cor em poucos passos. O nível de controle é mais básico do que em softwares profissionais, mas a agilidade é um ponto forte.

Seleção automática

O Canva identifica automaticamente pessoas e objetos na imagem. Isso elimina a necessidade de criar máscaras complexas ou ajustar parâmetros técnicos.

Captura Mágica (Magic Grab)

Permite destacar um objeto ou pessoa da foto. A própria ferramenta reconstrói o fundo e transforma o elemento recortado em algo que pode ser movido dentro do layout, como um adesivo editável.

Edição Mágica (Magic Edit)

Você pinta a área que quer alterar e descreve a mudança. A ferramenta faz a substituição local. Funciona bem para trocar cores de roupa, incluir acessórios ou ajustar elementos de cenário em peças para redes sociais.

Integração com o layout

Um dos pontos fortes do Canva é que a edição acontece dentro da própria peça final. Isso facilita adaptar a mesma criação para diferentes formatos sem sair do ambiente de criação.

O ganho está na velocidade e na padronização visual, sem depender de conhecimento técnico aprofundado.

O workflow híbrido que profissionais de IA estão adotando

A tendência mais interessante no mercado profissional hoje é combinar ferramentas, em vez de depender de apenas uma. Muitos criadores estão montando fluxos de trabalho próprios, usando sistemas de automação baseados em nós, como ComfyUI ou Spaces, para estruturar processos mais eficientes e personalizados.

A lógica é simples: explorar estética em um ambiente, corrigir estrutura em outro e finalizar a composição em um terceiro. A diferença está em sair do uso isolado da ferramenta e passar a construir um processo.

Produção em quatro etapas

Fase 1: Exploração estética (Midjourney)

Use para definir o clima e a composição inicial da cena. Modelos como o Midjourney têm forte repertório visual e funcionam bem para gerar direção criativa e referências.

Fase 2: Refino estrutural (Stable Diffusion local)

Leve a imagem gerada para o Stable Diffusion para corrigir anatomia com ControlNet, aplicar texturas específicas usando modelos complementares treinados com a identidade visual da marca ou realizar ajustes que exigem controle preciso de parâmetros.

Fase 3: Consistência e texto (Nano Banana Pro)

Utilize o modelo da Google para inserir elementos de marca, gerar textos legíveis em embalagens ou manter o mesmo personagem consistente em diferentes poses por meio da combinação de múltiplas referências.

Fase 4: Finalização e composição (Photoshop)

Faça a fusão final de elementos, ajuste níveis de cor, aplique tratamento profissional e prepare o arquivo para impressão ou exportação em alta resolução.

Leia também: Workflow híbrido: combinando IA com ferramentas tradicionais

O que a IA ainda não consegue fazer bem no inpainting

O inpainting evoluiu muito, mas ainda funciona com base em probabilidade de pixels, não em física real ou compreensão 3D. Entender isso ajuda a evitar frustração e a saber quando vale insistir e quando é melhor intervir manualmente.

1. Limites em perspectiva e rotação

A IA não “enxerga” objetos em 3D. Quando a tarefa exige rotacionar um produto com precisão técnica ou corrigir perspectiva estrutural profunda, o resultado pode parecer convincente à primeira vista, mas não fiel ao design original.

2. Contato físico complexo

Interações delicadas ainda são um ponto sensível: mãos segurando objetos específicos, tecidos sob tensão, peças mecânicas com encaixes funcionais.

Quando há contato, sobreposição ou partes parcialmente escondidas, aumentam as chances de erro. Em áreas como engenharia ou design industrial, a revisão humana é e sempre será indispensável.

3. Texto e identidade visual

A geração de texto melhorou bastante. Ainda assim, manter consistência tipográfica, com espaçamento, peso da fonte, alinhamento, pode falhar, especialmente em séries de imagens.

Para materiais institucionais ou uso de logotipos, o ideal é tratar o inpainting como base visual e finalizar a tipografia manualmente.

4. Textura e acabamento

Em imagens de alta resolução, a área editada pode apresentar textura diferente do restante da foto, ficando limpa demais, suave demais ou com ruído inconsistente. Sem ajuste fino posterior, isso quebra a unidade visual.

Reconhecer essas limitações não diminui as ferramentas de IA. Pelo contrário, permite usar com mais inteligência e decidir o momento certo de migrar para o ajuste tradicional.

Por que a IA ainda erra e como antecipar problemas

Entender por que a IA erra é o que transforma frustração em vantagem competitiva. Quando você compreende a lógica por trás das falhas, passa a prever inconsistências antes mesmo de elas aparecerem na imagem.

As chamadas ‘alucinações visuais’ acontecem porque a IA não “entende” o mundo. Ela não tem consciência, intenção nem senso físico das coisas. O que ela faz é reconhecer padrões estatísticos e prever qual combinação de elementos parece mais plausível com base nos dados que recebeu durante o treinamento.

Isso significa que qualquer geração é, no fundo, uma aposta. Se o comando é ambíguo ou o contexto não está claro, o modelo preenche as lacunas com a solução mais provável, não necessariamente a mais coerente. Quando surgem distorções, proporções estranhas ou incoerências sutis, o problema costuma ser a ausência de direção precisa.

Exemplos práticos de antecipação

Se você está adicionando um objeto metálico brilhante em uma cena, antecipe que o modelo pode não calcular reflexos corretamente. Inclua no prompt a descrição da fonte de luz e o tipo de reflexo esperado.

Se está editando uma pessoa em movimento (correndo, pulando), antecipe problemas de equilíbrio. Use ControlNet Pose para estabelecer uma anatomia válida antes de aplicar textura.

Se está inserindo texto em perspectiva, como uma placa na rua ou um logotipo aplicado em uma caixa, antecipe que o modelo pode distorcer letras ou ignorar a inclinação correta do plano. Tente especificar o ângulo da superfície, o ponto de fuga e a direção da câmera no prompt.

Esse raciocínio preventivo é o que separa o uso casual de IA de um uso profissional. Mesmo assim, nenhuma ferramenta substitui o olhar treinado.

O papel do designer continua central na curadoria e na correção final dos detalhes. É a compreensão humana de proporção, gesto, coerência espacial e leitura visual que permite identificar quando um inpainting falhou e, principalmente, saber como recalibrar o prompt para conduzir a IA até a solução adequada.

Quando insistir na edição da imagem com IA se torna erro

Existe um ponto em que a tentativa de correção começa a deteriorar a imagem. Textura borrada, luz incoerente e microartefatos acumulados são sinais de que a base já não sustenta novas intervenções.

Se você percebe que está corrigindo a correção anterior, provavelmente é hora de começar de novo do zero. Saber abandonar também faz parte do processo criativo profissional e a produtividade real não está só em salvar todas as imagens possíveis, mas em identificar rapidamente quais merecem refinamento e quais precisam ser reconstruídas.

Essa consciência é especialmente importante em ambientes profissionais onde prazo e consistência de marca importam mais do que apego criativo.

Conclusão: o quase perfeito é oportunidade, não frustração

A edição localizada em imagens com IA se tornou um marcador de maturidade criativa. Em um mercado saturado, o diferencial já não está em gerar, mas em decidir, refinar e ajustar com inteligência. O que separa o amador do profissional é a capacidade de observar o resultado da IA com distanciamento crítico e intervir com intenção.

Quando você domina recursos como inpainting e aplicação de fluxos de trabalho híbridos, deixa de depender da sorte do prompt e assume a condução da narrativa visual. A imagem “quase perfeita”, que antes parecia um impasse, passa a ser matéria-prima, deixando de representar frustração e se convertendo em campo de decisão.

É nessa virada, quando você sai da tentativa e erro e começa a trabalhar com método, que a autoridade criativa começa a ganhar corpo. O profissional estratégico entende que esse equilíbrio entre persistência técnica e senso crítico é o que separa quem apenas executa comandos de quem constrói soluções com intenção.

Ferramenta, qualquer pessoa aprende a usar relativamente rápido. O que leva tempo é formar repertório, desenvolver olhar e ganhar segurança para sustentar escolhas. Critério não nasce pronto, ele é construído na prática, no erro consciente, na revisão constante.

Aprofundar a base técnica fortalece suas decisões, mas é o olhar que sustenta um portfólio consistente e de alto nível. No fim, qualidade nasce de escolhas bem feitas ao longo do processo, com consciência do que está sendo construído.

A verdadeira vantagem competitiva na criação de imagens com IA está na capacidade de enxergar potencial e conduzir a imagem até um resultado que faça sentido dentro do seu próprio padrão de qualidade.

Quer levar sua prática com IA ainda mais longe e não deixar que pequenos deslizes comprometam seu trabalho? Então confira também este artigo: 5 erros que estão sabotando a qualidade dos seus vídeos com IA.