Human Picks

Staff

Já não estamos mais discutindo se as ferramentas funcionam, mas quais realmente mudam a forma como profissionais pensam, planejam e entregam. Em muitos casos, geração, edição e refinamento acontecem praticamente em tempo real e o que antes parecia tendência de futuro roda agora nos workflows de agências, estúdios e produtores independentes, exatamente enquanto você lê este texto.

Essa maturidade do mercado também eleva a régua. Qualidade técnica deixou de ser diferencial e passou a ser expectativa mínima a cada novo lançamento.

Por isso, vamos destacar cinco ferramentas para ficar de olho em 2026. O ponto de partida foi olhar para o ecossistema de IA criativa e mergulhar em cada uma delas com a pergunta simples: o que isso muda de verdade para quem cria? É o que você vai ver a seguir.

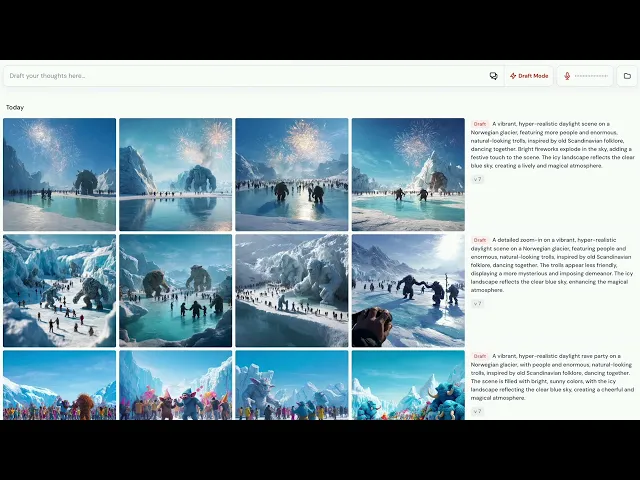

Midjourney: a IA que combina consistência, autenticidade e velocidade

Falar que o Midjourney é uma das ferramentas favoritas de quem tem sensibilidade visual apurada já não é novidade. Poucas plataformas conseguem manter um favoritismo tão alto ao longo das atualizações.

O salto para V7 (e V6.1 antes) foi estratégico. O foco passou a ser velocidade, controle e coerência, fatores que impactam diretamente a direção de arte e a produção constante.

Na prática, alguns recursos já mudam diretamente o fluxo de trabalho.

Nas versões anteriores, testar caminhos visuais consumia tempo e créditos mesmo quando a intenção era só validar conceitos. Agora o Draft Mode resolve esse gargalo gerando imagens em resolução menor, até 10x mais rápido e usando metade dos créditos.

Na prática, vira um ambiente de prototipagem visual. É possível testar estruturas de prompt, estilos e direções estéticas antes de investir na renderização final.

Outro avanço importante é o Omni Reference (--oref), que amplia o controle sobre estilos e referências. O recurso permite combinar paletas, iluminação e estilos diferentes mantendo coerência entre gerações.

Para quem trabalha com personagens recorrentes ou identidades visuais, isso resolve a questão da consistência entre cenas. Anatomia, proporções e texturas ficaram mais estáveis, inclusive em elementos historicamente difíceis como mãos.

O processamento de linguagem também evoluiu. Versões anteriores frequentemente perdiam contexto quando o prompt não estava em inglês.

No v7, prompts em português já funcionam melhor, principalmente quando envolvem referências culturais, arquitetura urbana ou características regionais. Isso facilita explorar estéticas locais sem depender de descrições muito longas.

Talvez a mudança mais interessante esteja na personalização. O modelo aprende com as avaliações feitas pelo usuário e passa a ajustar iluminação, paleta e composição de acordo com essas preferências.

Na prática, dois profissionais digitando o mesmo prompt podem chegar a resultados diferentes. A ferramenta começa a refletir o repertório visual de quem a utiliza, reduzindo a sensação de estética “padronizada” da IA.

Outro movimento dentro do ecossistema foi o lançamento do Niji 7, voltado para estética de anime e ilustração, ampliando o uso da plataforma em games, quadrinhos e projetos de animação.

Com essas mudanças, o Midjourney segue evoluindo como um parceiro criativo real. A comunidade já especula próximos passos, como renderização de texto mais confiável, resoluções maiores e ferramentas de edição mais completas. Com certeza, vale a pena acompanhar o que vem por aí.

Leia também: Animação com IA e os novos fluxos de criação com Midjourney e Freepik

Runway: Gen-4.5 + GWM-1 para simular o mundo real

Enquanto muitas empresas de IA para vídeo ainda competiam em resolução e duração de clipes, a Runway tomou uma decisão diferente. Em vez de se posicionar apenas como geradora de vídeo, começou a desenvolver o que chama de Modelos de Mundo Gerais (GWM).

O Runway Gen‑4.5 funciona como a base que gera imagens e vídeos, enquanto GWM-1 entende espaço, movimento e física, transformando cenas estáticas em ambientes 3D navegáveis em tempo real, com gravidade, inércia e dinâmica realistas.

Isso inclui também áudio nativo (trilhas, efeitos, fala) e multi-shot editing (edita uma cena e propaga mudanças para todo o vídeo).

Esse avanço traz simulações mais convincentes. Um carro fazendo uma curva ou um líquido sendo derramado agora apresentam peso e dinâmica muito mais próximos do mundo físico.

O modelo GWM-1 se desdobra em três aplicações principais:

GWM Worlds permite transformar imagens em ambientes exploráveis em tempo real, abrindo espaço para experiências interativas como showrooms virtuais, ativações de marca ou lojas digitais navegáveis.

GWM Avatars cria personagens capazes de conversar em vídeo com movimentos naturais de rosto e gestos sincronizados com a fala. O sistema sustenta diálogos longos sem perda perceptível de qualidade, o que amplia o uso em atendimento, treinamento e comunicação de marca.

Já GWM Robotics usa os modelos de mundo como simuladores para treinar robôs físicos com grandes volumes de dados sintéticos, reduzindo a dependência de testes em hardware real.

Esse avanço foi viabilizado pela parceria da Runway com a NVIDIA, que forneceu a infraestrutura necessária para executar essas simulações quase em tempo real.

Para quem cria, isso muda o ritmo do trabalho. O que antes exigia períodos longos de renderização passa a ser explorado de forma mais interativa, durante o próprio desenvolvimento da ideia.

Hoje a Runway já não compete só com geradores de vídeo como OpenAI Sora ou Luma. A disputa acontece em um território mais amplo, o de quem vai construir a infraestrutura da realidade digital. Projetos como Genie, do Google DeepMind, caminham na mesma direção.

E essa distinção ajuda a entender por que a Runway vem ganhando ainda mais espaço no workflow criativo de 2026.

Kling 3.0: o “diretor digital” da IA

O Kling evoluiu rapidamente de um simples gerador de vídeo para algo mais próximo de um sistema de direção cinematográfica assistida por IA. Em vez de focar só na estética, o modelo passou a interpretar estrutura narrativa, composição de planos e ritmo de cena.

Essa mudança ficou clara na transição para o Kling 3.0, que passou a unir vídeo, áudio e movimento em uma mesma lógica integrada. O resultado são cenas mais longas e coerentes, com física mais estável e suporte nativo a 2K e 4K.

Um dos recursos mais interessantes é o Canvas Agent que funciona como um espaço de criação visual onde uma ideia inicial pode se transformar em storyboards completos, gerando diferentes enquadramentos e organizando automaticamente a sequência de planos.

Outro avanço importante está no Motion Control 3.0, que permite usar vídeos de referência para transferir gestos e movimentos para novos personagens. Já o Elements 3.0 cria uma biblioteca de personagens e objetos dentro do projeto, mantendo consistência visual entre cenas.

O modelo também passou a trabalhar com áudio nativo integrado ao vídeo, incluindo sincronização labial precisa em vários idiomas, entre eles português, inglês, chinês, japonês, coreano e espanhol. Isso facilita a produção de conteúdos multilíngues sem depender de uma etapa separada de dublagem.

No cenário atual de vídeo com IA, o Kling costuma se destacar pela liberdade criativa. Em alguns casos, apresenta menos restrições de estilo que modelos como Veo e resultados convincentes em efeitos complexos quando comparado a plataformas como Runway.

Ainda existem alguns gargalos, como falhas ocasionais em interações complexas de mãos e o custo elevado para gerar vídeos longos em 4K. Mesmo assim, o Kling já aponta para uma mudança clara: ferramentas de vídeo com IA começando a funcionar como ambientes de direção visual dentro do próprio processo criativo.

Leia também: Kling O1: o modelo de IA multimodal que unifica texto, imagem e movimento em vídeo

Veo 3.1: o estúdio do Google de produção IA em escala

O Google não entrou na corrida do vídeo por IA para disputar a estética ou física mais sofisticada. O Veo 3.1 revela um objetivo mais direto: liderar pelo volume de produção.

Um dos avanços mais relevantes na versão mais recente é o upscaling nativo para 4K com reconstrução de detalhes. Para a publicidade, isso simplifica a cadeia de produção. Peças e campanhas saem em alta resolução sem necessidade de pós-processamento externo.

Outro recurso importante é o Ingredients to Video, que promete manter personagens consistentes entre diferentes cenas. Com até quatro imagens de referência, ele preserva aparência, roupas e proporções mesmo com mudanças de cenário ou luz na narrativa.

O modelo também apresenta sincronização áudio-visual com latência de cerca de 10 milissegundos, mantendo diálogos e efeitos alinhados com precisão.

Mas talvez o foco mais claro do Veo esteja na produção para formatos mobile. O modelo gera vídeos verticais nativos em 9:16 e já se integra a ferramentas como YouTube Create, facilitando a criação de conteúdo pensado diretamente para plataformas como TikTok, Instagram Reels e YouTube Shorts.

Para quem trabalha com social media ou produção contínua de conteúdo, essa combinação de volume, resolução alta e integração com plataformas de distribuição é exatamente o que coloca o Veo no radar criativo atual. Por fazer parte do ecossistema Google, ele se conecta nativamente com ferramentas como Gemini, Nano Banana e outras funcionalidades de IA da empresa, facilitando a integração para marcas e equipes que querem manter processos e dados organizados em um único ambiente.

Luma AI Dream Machine (Ray 3.14): controle de direção e estabilidade visual

Enquanto muitos geradores de vídeo com IA priorizam velocidade ou impacto visual imediato, a Luma seguiu outro caminho. A proposta agora é oferecer controle real sobre a cena, algo mais próximo da lógica de direção do que de geração automática.

Esse posicionamento ficou mais claro com o Ray 3.14, modelo que marcou a transição da ferramenta para um uso mais profissional. O sistema ficou quatro vezes mais rápido, reduziu o custo por segundo de vídeo em cerca de 70% e passou a gerar vídeos em 1080p nativo, evitando etapas externas de upscaling.

Outro avanço importante foi na interpretação de movimentos de câmera. Comandos como pan, tracking ou dolly passaram a ser reproduzidos com mais precisão, reduzindo distorções que ainda aparecem em outros modelos.

Um dos recursos mais interessantes do ecossistema é o Modify Video, que permite alterar uma filmagem real com IA. Cenário, figurino, iluminação e estilo visual podem ser modificados por texto, preservando atuação e enquadramento. Na prática, é como continuar dirigindo a cena depois da gravação.

A atualização aproxima a Dream Machine de rotinas profissionais com ferramentas como Keyframe Control para definir início e fim de uma cena, HDR nativo em 16-bit para integração com VFX e Draft Mode e Agents para testar ideias antes da renderização final.

Mesmo com os avanços, ainda há limites. A consistência de personagens em vídeos longos pode oscilar e cenas extensas tendem a perder estabilidade. Ainda assim, a direção da Luma é clara: menos foco em vídeos virais e mais integração da IA ao processo de produção audiovisual. Para direção de arte, publicidade e pré-visualização, é uma ferramenta que merece atenção.

Outras ferramentas de IA que também merecem atenção

As cinco ferramentas acima ajudam a entender alguns dos movimentos mais estruturais da IA criativa em 2026. Ainda assim, o ecossistema é amplo e continua evoluindo rápido. Outras plataformas também merecem entrar no radar, cada uma contribuindo de forma específica em diferentes etapas do processo criativo.

Nano Banana

O Nano Banana 2 nasce da evolução do Nano Banana Pro, focando em velocidade e fluidez. Se o Pro era conhecido pela qualidade e pelo cuidado na geração de imagens, o Nano Banana 2 mantém esse nível de raciocínio visual, mas com respostas muito mais rápidas, permitindo iterar ideias quase em tempo real.

Vale a pena acompanhar as próximas atualizações porque o Google já trabalha em recursos como níveis de raciocínio ajustáveis, integração cada vez maior com ferramentas de vídeo como o Flow e sistemas de autenticação de conteúdo gerado por IA, que devem tornar o Nano Banana ainda mais relevante dentro de workflows criativos profissionais.

HeyGen

A HeyGen consolidou em 2026 um dos usos mais maduros de IA em vídeo corporativo: a geração de apresentadores digitais em escala. Com o Avatar IV, os movimentos ficaram mais naturais, com microexpressões e gestos mais coerentes. O Video Agent 2.0 também automatizou o fluxo, transformando um prompt em produção completa, com roteiro, avatar e edição ajustável. Recursos como Avatar Memory, Voice Doctor, tradução e o modo Streaming Avatars ampliam o uso para personalização em massa, atendimento ao vivo e comunicação em várias línguas.

Vale acompanhar a ferramenta porque os agentes em live streaming começam a abrir possibilidades interessantes para redes sociais. Agora já é possível criar avatares que entram em plataformas como TikTok ou YouTube, respondendo comentários e perguntas ao vivo, o que transforma o modelo em um ativo de interação e não apenas em vídeo gravado.

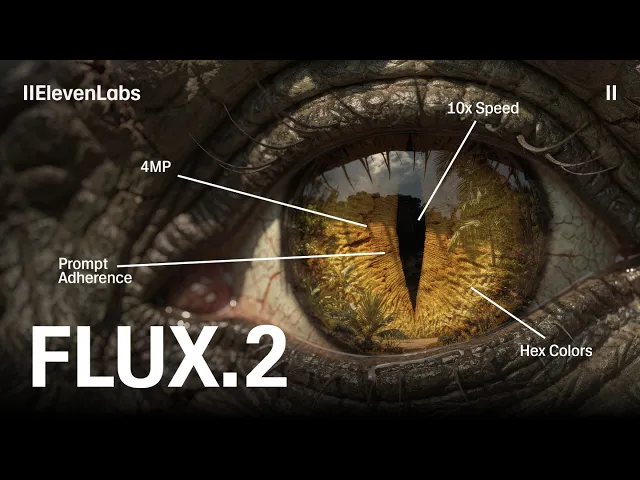

Flux

O Flux 2 avança em relação à versão anterior ao trazer mais controle e precisão na geração de imagens. Se a v1 já se destacava pela qualidade e pelo bom desempenho com texto e anatomia, a nova versão melhora a interpretação do prompt e entende melhor como os elementos devem se organizar no espaço.

O ponto forte está no controle: posições, poses, cores e ajustes fotográficos ficam mais fiéis ao que foi pedido, além de melhorias em anatomia, textura e tipografia. Outro diferencial é a possibilidade de rodar localmente e treinar estilos próprios, fortalecendo o ecossistema open source. Para equipes que precisam de personalização e integração com ferramentas como Photoshop ou Figma, essa autonomia faz dele uma alternativa estratégica.

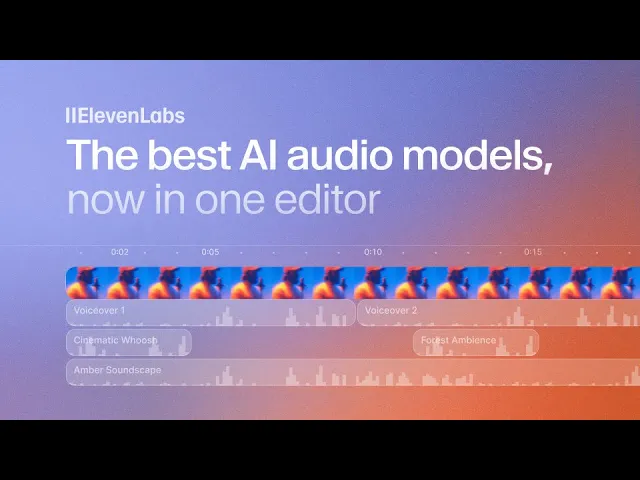

ElevenLabs Studio 3.0

O Studio 3.0 marca uma mudança importante no posicionamento da plataforma: o áudio deixa de ser apenas complemento e passa a funcionar como centro da produção. Com o novo motor Eleven v3, o controle emocional da voz ficou mais refinado, permitindo incluir pausas, sussurros e variações de tom diretamente no roteiro. A clonagem também evoluiu, capturando timbre e padrões de fala com cerca de 30 minutos de referência.

A grande mudança está na estrutura da plataforma. O Studio agora funciona como um editor multimodal com linha do tempo própria, onde dá para subir vídeos, alinhar vozes, gerar trilhas com o Eleven Music e criar efeitos sonoros por prompt dentro do próprio ambiente. Recursos como Voice Isolator Pro, Speech Correction e controle de ritmo agilizam o ajuste fino, enquanto o suporte a múltiplos idiomas e traduções ajuda a manter a identidade vocal em diferentes mercados.

Vale acompanhar porque ela se consolida como um hub de produção sonora e de voz para vídeo, dublagem e agentes conversacionais, permitindo criar agentes e expandir conteúdos para outros idiomas mantendo o mesmo timbre, o que facilita a escala e a internacionalização de projetos criativos.

Conclusão: O que sustenta o futuro criativo é a infraestrutura, não só a IA

A conversa sobre ferramentas de IA sempre corre o risco de focar no objetivo errado. O que já está sendo feito em 2026 não é só um conjunto de ferramentas mais rápidas ou modelos mais potentes. É uma nova infraestrutura para o pensamento criativo. E infraestrutura, quando funciona bem, deixa de ser novidade e vira padrão.

Quando a exploração visual acontece em segundos, quando a consistência de personagem deixa de ser um gargalo de produção, quando o áudio começa a gerar o vídeo e não o contrário, algo muda na forma como uma ideia é concebida. O processo criativo começa a se adaptar às possibilidades do ambiente onde ele funciona.

Por isso, o mais estratégico não é decorar comandos ou se apegar a uma ferramenta de IA específica, e sim entender onde cada solução realmente resolve problemas. Quem parte dessa lógica consegue circular entre plataformas, ajustar caminhos e ganhar eficiência sem ficar preso a um único sistema. E isso não é estático. O cenário vai continuar mudando, cada vez mais rápido, e sai na frente quem reconhece que a decisão e o olhar crítico permanecem centrais, independentemente da ferramenta escolhida.