Nando

CEO | FOUNDER

Depois de meses de expectativa, o Style Creator chega em versão beta no Midjourney e traz um jeito diferente de pensar a criação com IA. A proposta coloca mais foco na relação entre intenção estética e direção artística, permitindo montar estilos a partir de referências visuais sem depender tanto de prompts de texto.

É um movimento simples, mas que toca num ponto familiar pra quem cria com frequência: o prompt super detalhado não é mais o único caminho pra chegar no resultado esperado.

O mais interessante é que a ferramenta não se limita a uma mudança de técnica. Ela altera um pouco a dinâmica dentro de um ambiente popular como o Midjourney, dando mais espaço pra escolhas visuais e menos pra descrições.

Isso abre caminhos mais diretos para explorar nuances, testar combinações e entender melhor o que funciona. No uso real, o Style Creator encurta o caminho entre a intenção e a entrega, sem aquele esforço de transformar obrigatoriamente a ideia em texto.

O que é Style Creator e como funciona a combinação de estilos

Vamos começar pelo que o Style Creator ainda não faz: ele não cria estilos do zero, como uma espécie de gerador mágico que transforma suas escolhas em algo completamente novo e original. Na prática, ele funciona como uma interface que combina estilos que já existem dentro do sistema de referências do Midjourney, conhecidos como códigos SREF (style reference).

Os códigos SREF são números usados para “guardar” estilos visuais, como cores, luz e clima da imagem. Você coloca o código no prompt e a IA repete aquele estilo em qualquer criação.

Pense assim: o Midjourney tem uma biblioteca gigante de estilos visuais já catalogados e numerados e cada um desses estilos tem um código único que você pode usar nos seus prompts para aplicar aquela estética específica.

Com o Style Creator, o resultado final é um novo código numérico gerado pela fusão dessas referências, algo que fica mais próximo de curadoria guiada do que de criação absoluta.

Ainda não dá pra fazer upload de imagens externas e nem pra combinar referências de fora do Midjourney, mas o legal é que esse universo interno é imenso e já reúne milhares de estilos para explorar, que ao se combinarem entregam resultados que você provavelmente não conseguiria descrever tão facilmente em palavras.

A grande virada aqui não é a tecnologia em si, mas a forma como você interage com ela: o Midjourney está apostando que o seu olhar criativo, sua capacidade de reconhecer e escolher, pode funcionar tão bem quanto (ou até melhor que) a habilidade de descrever estilos com palavras. E isso tem consequências interessantes para quem cria.

Style Creator na prática: guia para geração de códigos SREF

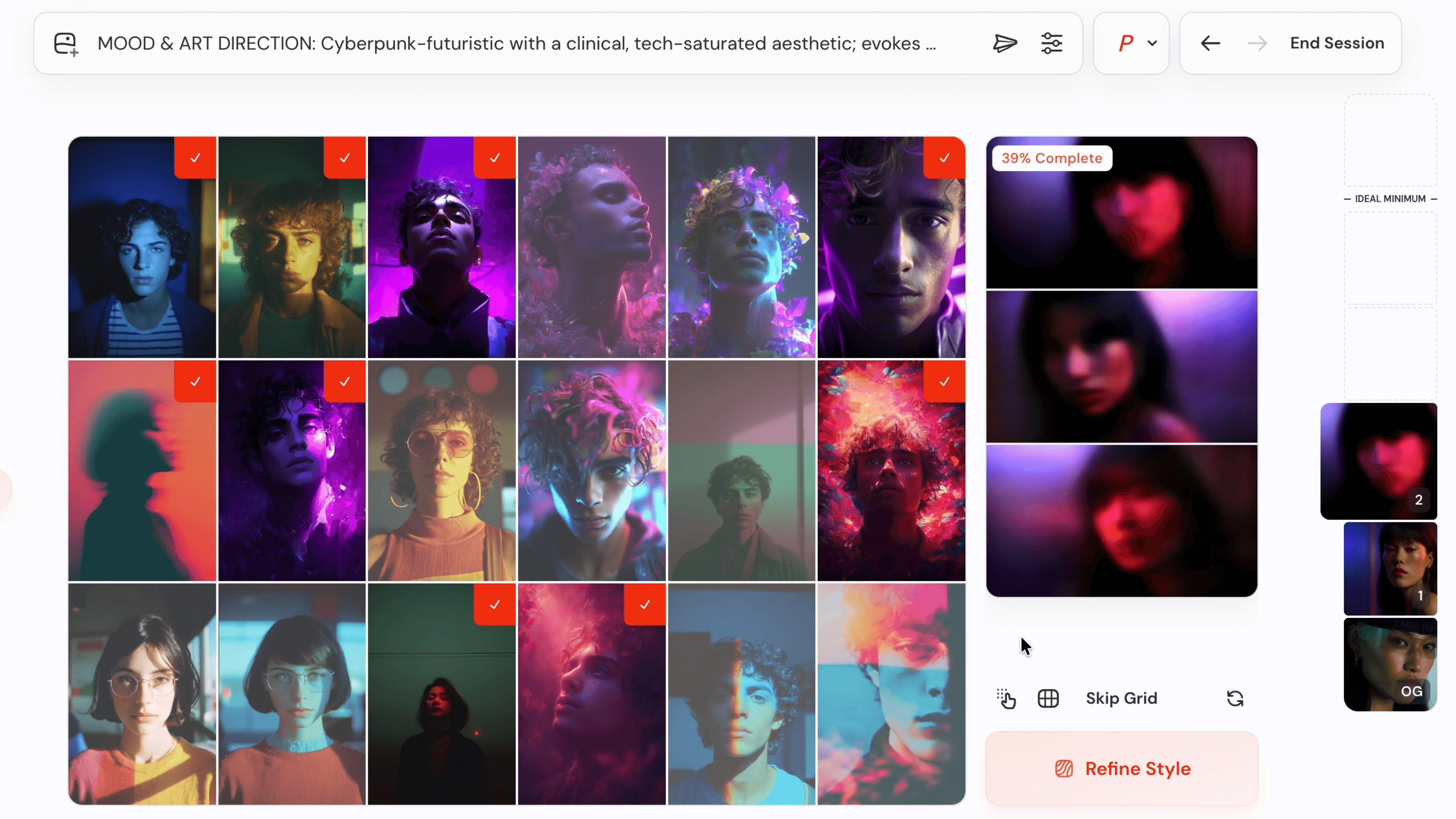

Basicamente, o Midjourney te pergunta “o que você quer”. Cada escolha que você faz ajuda a reduzir as dúvidas e deixa a imagem cada vez mais perto da sua visão, usando as referências que você seleciona como guia.

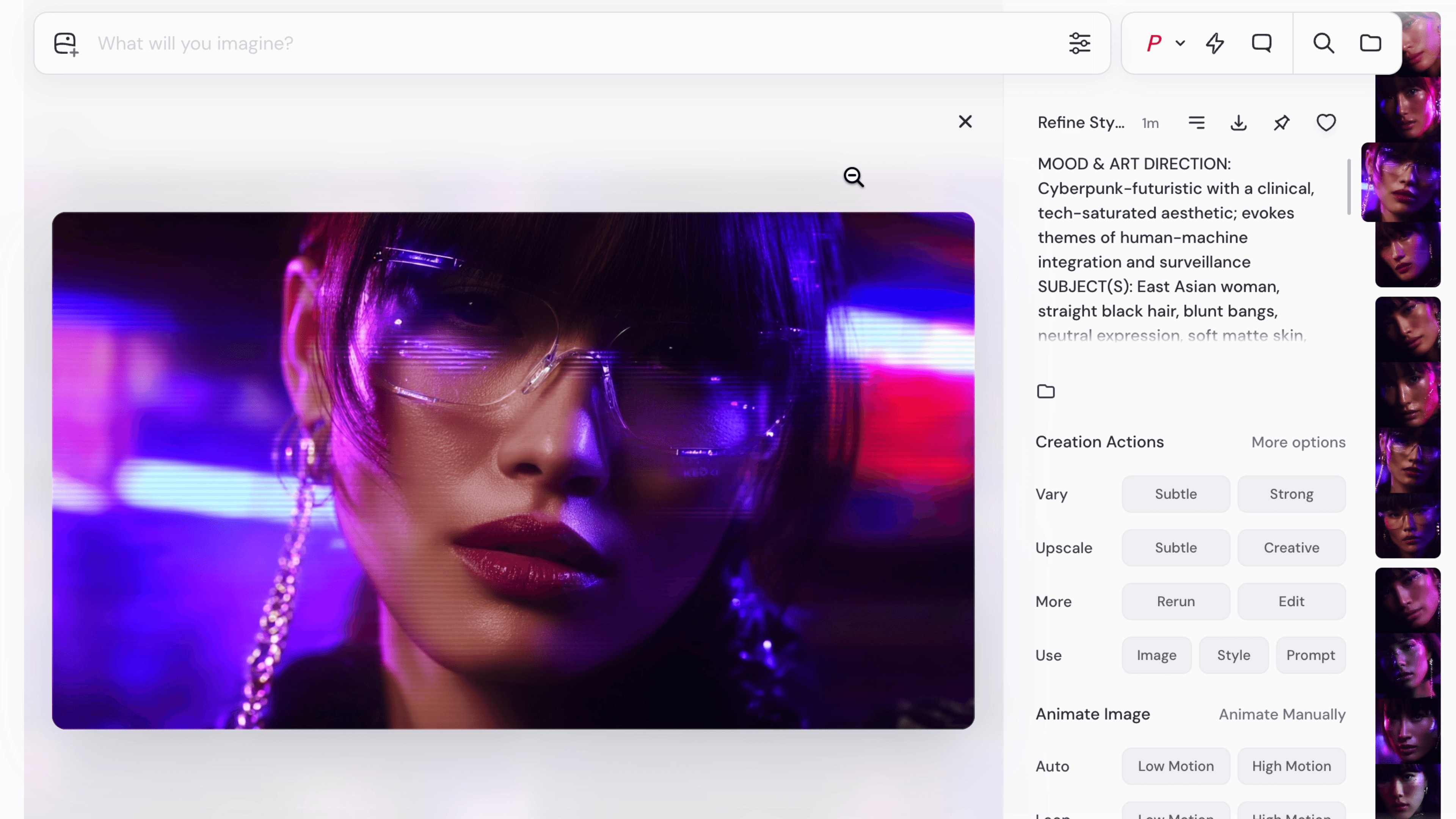

Tudo começa quando você digita um prompt inicial ou descreve um comando de estilo (que também pode ser algo pré-existente disponível) e recebe uma grade de imagens geradas automaticamente. A partir daí, você seleciona as imagens que melhor representam o estilo visual que você quer desenvolver.

O Midjourney então converte suas escolhas em um novo código SREF e você recebe outra grade de imagens para refinar ainda mais os resultados.

O processo funciona por repetição e exige paciência. O Midjourney recomenda pelo menos cinco rodadas de refinamento para que o estilo se torne estável, mas muitos usuários relatam que resultados realmente consistentes só aparecem entre as rodadas 10 e 15. Daí pra frente, as mudanças começam a ficar bem mais sutis. A operação é simples, mas demanda bastante dedicação.

Você precisa ter clareza sobre o que está buscando, porque o sistema aprende tanto com o que você escolhe quanto com o que você ignora. Nas primeiras rodadas, as sugestões podem parecer aleatórias ou distantes do que você imaginou, mas isso faz parte da calibração. O algoritmo está tentando entender suas preferências e quanto mais específico você for nas escolhas, mais focado o resultado final vai ser.

A cada etapa, ele gera novas ideias até chegar no estilo que você quer. Ao concluir o refinamento, você pode clicar em "finalizar sessão" para obter o código SREF único do estilo criado.

Uma característica interessante aqui é que os códigos SREF funcionam por se somarem: se você usar o novo código gerado em um prompt que já contém outro código SREF, o Midjourney irá combinar as referências dos dois em vez de substituir o estilo anterior. Na prática, isso permite que você junte referências e crie camadas de influência estética, mas é preciso ter cuidado para não acabar com uma mistura confusa de estilos que não conversam entre si.

Como otimizar o workflow no Style Creator

Quem já é familiarizado com o Midjourney vai encontrar algumas facilidades. Dá para ativar atalhos de teclado para acelerar a seleção das imagens, e você pode adicionar o comando --draft ao prompt inicial para economizar tempo de processamento e gerar previews mais rápidos. Isso é bem útil se você está fazendo muitas rodadas de teste e não quer gastar créditos com gerações completas.

Também vale destacar que você pode revisitar rodadas anteriores usando as setas de navegação ou os thumbnails de preview, o que permite ajustar as escolhas se perceber que o estilo começou a destoar do que você queria. Só tem um detalhe importante: depois que você fecha a sessão, não dá mais para reabrir. Então, antes de encerrar, é bom dar aquela conferida.

Prompt versus seleção visual: quando a escolha visual ganha protagonismo

Aqui é o ponto mais instigante de toda essa discussão: o Style Creator desafia a lógica do prompt como ferramenta central de criação. Desde que ferramentas de geração de imagem começaram a se popularizar, o prompt se tornou a linguagem universal da IA criativa. Aprendemos a usar termos como "volumetric lighting", "golden hour", "octane render", "in the style of", e todo um vocabulário específico que funciona como um código de acesso para resultados melhores.

Essa dependência do texto criou uma curva de aprendizado específica e quem domina a construção de prompts consegue ser mais assertivo e preciso nos resultados, chegando mais rápido no que quer. Mas o Style Creator tenta inverter isso: em vez de precisar articular verbalmente o que você quer, você só precisa reconhecer visualmente o que funciona.

Essa é uma mudança conceitual interessante, já que a habilidade deixa de ser sobre articulação verbal e passa a ser sobre julgamento visual, deixando a direção artística ainda mais direta. Você não precisa saber como descrever "tons pastéis com texturas de aquarela e iluminação difusa em composições minimalistas". Você só precisa olhar para uma imagem e dizer: "é isso que eu quero".

Isso aproxima a criação com IA de processos mais comuns de direção de arte, onde moodboards, referências visuais e a construção de repertórios imagéticos sempre foram mais importantes do que descrições textuais. Designers, diretores de arte e ilustradores trabalham assim há décadas. O Style Creator está trazendo essa lógica para o universo da IA, mesclando a otimização que a tecnologia oferece com a sensibilidade humana que é (e sempre vai ser) fundamental no processo criativo.

Acessibilidade e IA: menos texto, mais possibilidades

Uma das contribuições mais importantes do Style Creator é a redução das barreiras de idioma. Embora os modelos de geração de imagem já venham evoluindo nesse sentido e hoje seja possível ser assertivo em prompts na língua nativa, historicamente o inglês sempre teve vantagem. Dentro do próprio inglês, existem termos, referências e expressões que produzem resultados mais refinados do que outros, criando diferentes níveis de precisão dependendo do domínio linguístico de cada pessoa.

Quando você remove a necessidade de escrever tantos detalhes, você também remove esses gargalos. Não importa qual é sua língua materna, não importa se você conhece o vocabulário técnico de fotografia ou design. Se você tem olho treinado para reconhecer o que funciona, você consegue usar a ferramenta com a mesma eficiência de qualquer outra pessoa.

Quanto menos a tecnologia depende de habilidades linguísticas específicas, mais pessoas conseguem explorar seu potencial criativo de forma plena.

Além disso, modelos de texto-para-imagem carregam todos os vieses e associações que estão embutidos na linguagem. Termos como "profissional", "bonito" ou "elegante" trazem bagagens culturais e podem gerar resultados que refletem estereótipos. A seleção visual pode contornar essas armadilhas, porque você escolhe diretamente o que quer, sem passar pelo filtro das associações linguísticas que o modelo aprendeu.

O que a comunidade criativa está dizendo sobre o Style Creator

A recepção do Style Creator tem sido mista, mas interessante. Existe entusiasmo pelo potencial de explorar estéticas mais pessoais, mas também cautela por conta da dependência dos estilos pré-existentes. Muitos creators relatam que o processo de refinamento pode ser um pouco frustrante, especialmente nas primeiras rodadas, quando os resultados parecem aleatórios ou distantes do objetivo.

Outro ponto de crítica é que o sistema não separa ajustes de estilo dos ajustes de cor, o que acaba limitando o controle criativo. Você pode acabar escolhendo uma imagem por causa da paleta de cores, mas junto com ela vem toda uma série de outras características estéticas que você não necessariamente queria. Isso torna o refinamento menos preciso do que poderia ser.

Por outro lado, há um reconhecimento forte de que o Style Creator representa um movimento importante na direção de interfaces mais intuitivas. A comunidade enxerga valor na ferramenta, mesmo que ainda haja espaço para melhorias. O consenso é que estamos vendo uma versão beta de algo que tem potencial para se tornar muito mais poderoso à medida que o Midjourney incorpora feedback dos usuários e expande a biblioteca de estilos.

Style Creator e a tendência de aproximar intenção e resultado

O lançamento do Style Creator não é um evento isolado. Ele faz parte de um movimento mais amplo na indústria de IA, que busca diminuir o atrito entre a intenção humana e a execução da máquina.

Estamos vendo isso em várias frentes: o Runway Gen-3 permite transformar esboços e imagens estáticas em vídeos cinematográficos completos, o HeyGen cria vídeos com avatares realistas a partir de scripts ou clipes de referência, o Synthesia gera apresentações profissionais em mais de 140 idiomas apenas com texto, e ferramentas como ElevenLabs clonam vozes com apenas um minuto de áudio.

O futuro da interação com IA parece estar caminhando para longe das limitações de texto e em direção a formas mais diretas e intuitivas de criação. A lógica é clara: quanto mais natural for o processo, mais pessoas conseguem usar as ferramentas de forma eficaz, e mais rápido conseguimos iterar sobre ideias.

O Midjourney sempre teve uma reputação forte quando o assunto é qualidade estética e coerência visual, e o Style Creator reforça essa característica. Enquanto outros geradores de imagem focam em interpretação literal de texto ou velocidade de geração, o Midjourney vem construindo recursos dedicados a explorar e refinar identidades visuais. Não é à toa que a plataforma se tornou referência.

Próximos passos: perspectivas e possibilidades para o Style Creator

A expectativa dentro da comunidade é que o Midjourney continue desenvolvendo o Style Creator em algumas direções específicas. A primeira delas é permitir manipulação mais profunda dos estilos, não apenas combinação. Isso significaria poder ajustar individualmente aspectos como paleta de cores, textura, composição e iluminação dentro de um mesmo estilo, dando ao criador um controle bem detalhado sobre cada parte da imagem.

Outra expectativa é que a galeria SREF acabe ganhando mais estilos e talvez até permita integrar referências externas ou montar bibliotecas personalizadas de estilos salvos. Hoje você fica limitado ao que o Midjourney já mapeou, mas no futuro pode existir a chance de treinar o sistema com as suas próprias referências visuais.

Há também a questão da integração com outras funcionalidades do Midjourney, como Character Reference (o parâmetro --cref que permite consistência de personagens) e ferramentas de edição avançada. Imaginar um workflow onde você cria estilos personalizados, aplica esses estilos a personagens consistentes e ainda tem controle fino sobre edição é algo que está começando a se desenhar como possível.

Por que o Style Creator importa para o futuro da criação com IA

No fim das contas, o Style Creator é um sinal de que a indústria de IA está amadurecendo e reconhecendo que a criação visual não se reduz à capacidade de descrever com palavras. O nosso olhar também pensa: ter a sensibilidade de reconhecer e escolher o que funciona é tão inteligente e valioso quanto saber descrever uma cena verbalmente.

Para criativos, isso abre portas. Você pode confiar no seu próprio repertório, na sua capacidade de curadoria, no seu olho treinado. E isso muda a dinâmica do jogo de uma forma interessante, porque desloca a vantagem competitiva de volta para onde ela sempre deveria estar que é na visão criativa e não apenas na fluência técnica com comandos de texto.

Para o campo mais amplo da IA, o Style Creator é um experimento importante em interfaces multimodais que vão além do texto como único canal de input. À medida que a tecnologia avança, vamos ver cada vez mais ferramentas que combinam texto, imagem, voz, seleção visual e outras formas de interação para criar experiências mais fluidas e intuitivas.

O Style Creator ainda não é perfeito, e certamente não é a última palavra em criação de estilos visuais com IA, mas é um passo em uma direção que vale a pena explorar: um futuro onde a criação com IA deixa a rigidez dos códigos para abraçar a fluidez do processo artístico.