Nando

CEO | FOUNDER

O ChatGPT Images 2.0 foi lançado com uma promessa clara de mais precisão e controle. Só que ele chega em um mercado que já tinha um favorito para boa parte da comunidade criativa: o Nano Banana. O modelo do Google consolidou um padrão difícil de ignorar em realismo, consistência e leitura de cena. Para muita gente, ele se tornou uma das principais referências em geração de imagem com IA.

De cara, a comparação entre os dois foi inevitável e a pergunta que começou a circular logo após os primeiros testes foi direta: o modelo da OpenAI realmente entrou na disputa para valer ou ainda repete os mesmos padrões das versões anteriores?

A resposta não é simples e muda dependendo do tipo de imagem, do nível de controle que você precisa e do quanto o resultado realmente resolve o que você pediu.

E isso fica mais claro quando você entende o que evoluiu no próprio modelo.

GPT Image 1.5 vs ChatGPT Images 2: o que mudou na prática

A diferença entre o GPT Image 1.5 e o ChatGPT Images 2.0 não é só de qualidade visual, mas também na forma como o modelo chega até a imagem final.

Nas versões anteriores, o processo funcionava em etapas separadas, com uma parte do sistema interpretando o pedido e outra executando a geração da imagem. Tudo dependia muito de como o comando era lido na primeira etapa, e qualquer ruído ali aparecia direto no resultado. No 2.0, o modelo lê o que você pediu, organiza os elementos da cena, avalia se a composição faz sentido e, só então, gera a imagem.

Na prática, isso muda três pontos importantes.

O primeiro é o texto dentro da imagem. No GPT Image 1.5, tipografia era quase decorativa. As letras até pareciam corretas, mas raramente formavam palavras que funcionavam de verdade. No 2.0, o texto passa a ser tratado como parte do layout, com uma precisão muito maior, inclusive em frases longas, rótulos e layouts mais complexos, com suporte a diferentes idiomas e alfabetos, como árabe, hindi, japonês e coreano.

O segundo ponto é a edição de partes específicas da imagem. Antes, quando você tentava mudar um detalhe, como a cor de um chapéu, era comum ele alterar outras áreas junto. Agora, os ajustes são mais controlados e ele identifica o que precisa mudar, mantendo o resto da cena estável.

O terceiro é a qualidade geral de cor e formato. O tom amarelado proeminente que ainda aparecia no 1.5 praticamente desaparece, e o modelo passa a lidar melhor com diferentes proporções, de imagens horizontais até formatos verticais para redes sociais.

Nesse movimento, a própria OpenAI já deixou claro o caminho: os modelos DALL-E 2 e 3 saem de cena em 12 de maio de 2026, o que reforça que essa nova abordagem passa a ser o padrão a partir de agora.

Onde o ChatGPT Images 2.0 se destaca

O ponto mais forte do modelo aparece quando a imagem depende de texto e layout funcionando juntos. É aí que ele começa a se diferenciar com mais clareza. Isso aparece principalmente em casos como:

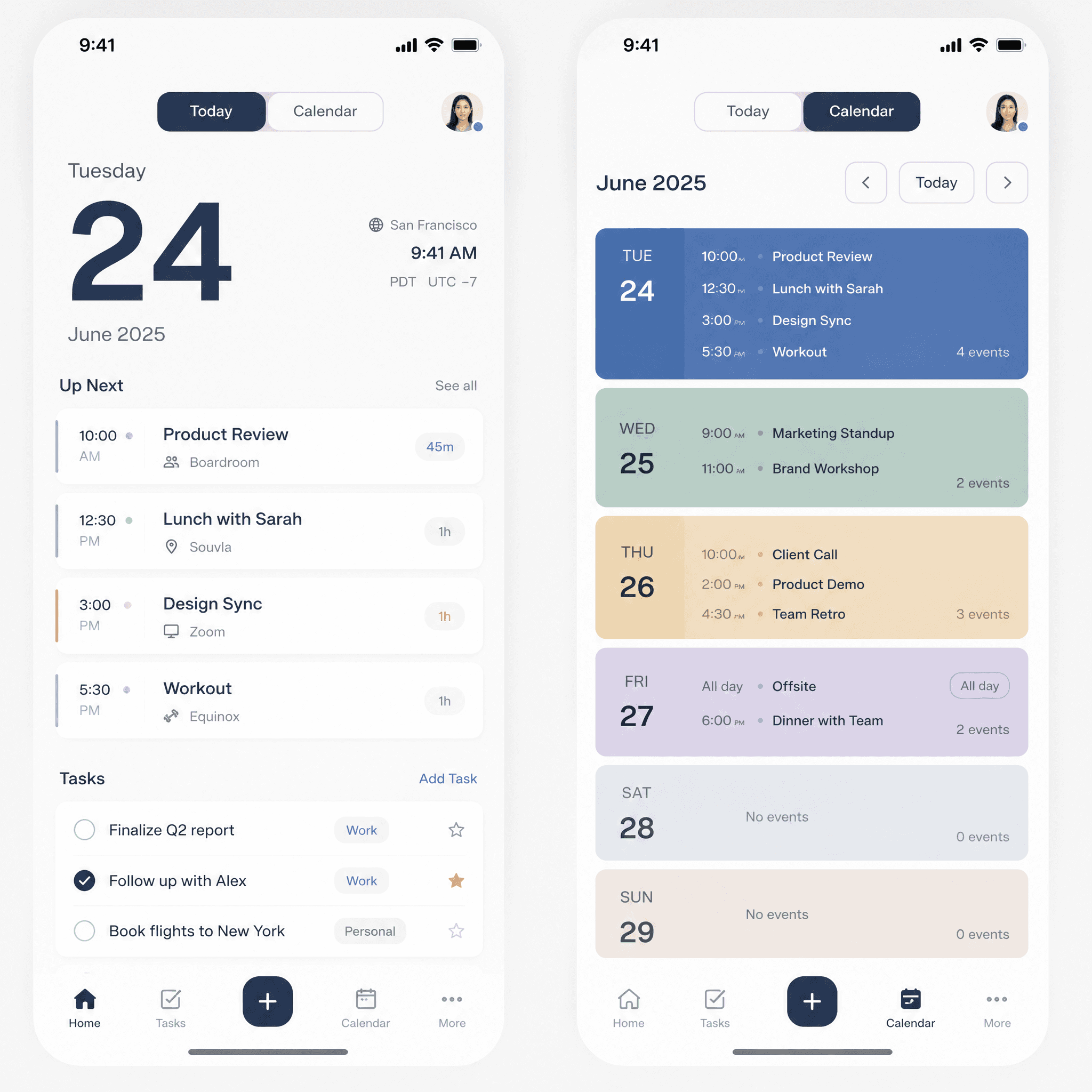

Ícones, UI e mockups de produto

Em interfaces de software, o ChatGPT Images 2.0 consegue gerar elementos que fazem sentido dentro de um sistema real. Janelas, botões e menus vêm com estrutura consistente, muitas vezes lembrando capturas de tela de verdade.

Para quem trabalha com apresentação de conceito, prototipagem visual ou mockups, ele tende a chegar mais perto do resultado já nas primeiras tentativas.

Embalagens

A integração entre texto e forma evoluiu bastante. Em vez de “colar” a tipografia na superfície, o modelo acompanha o volume do objeto, aplicando distorção, luz e perspectiva de forma mais coerente.

Isso faz diferença em rótulos mais complexos, com informação nutricional, textos menores ou aplicação de marca em materiais como vidro e metal.

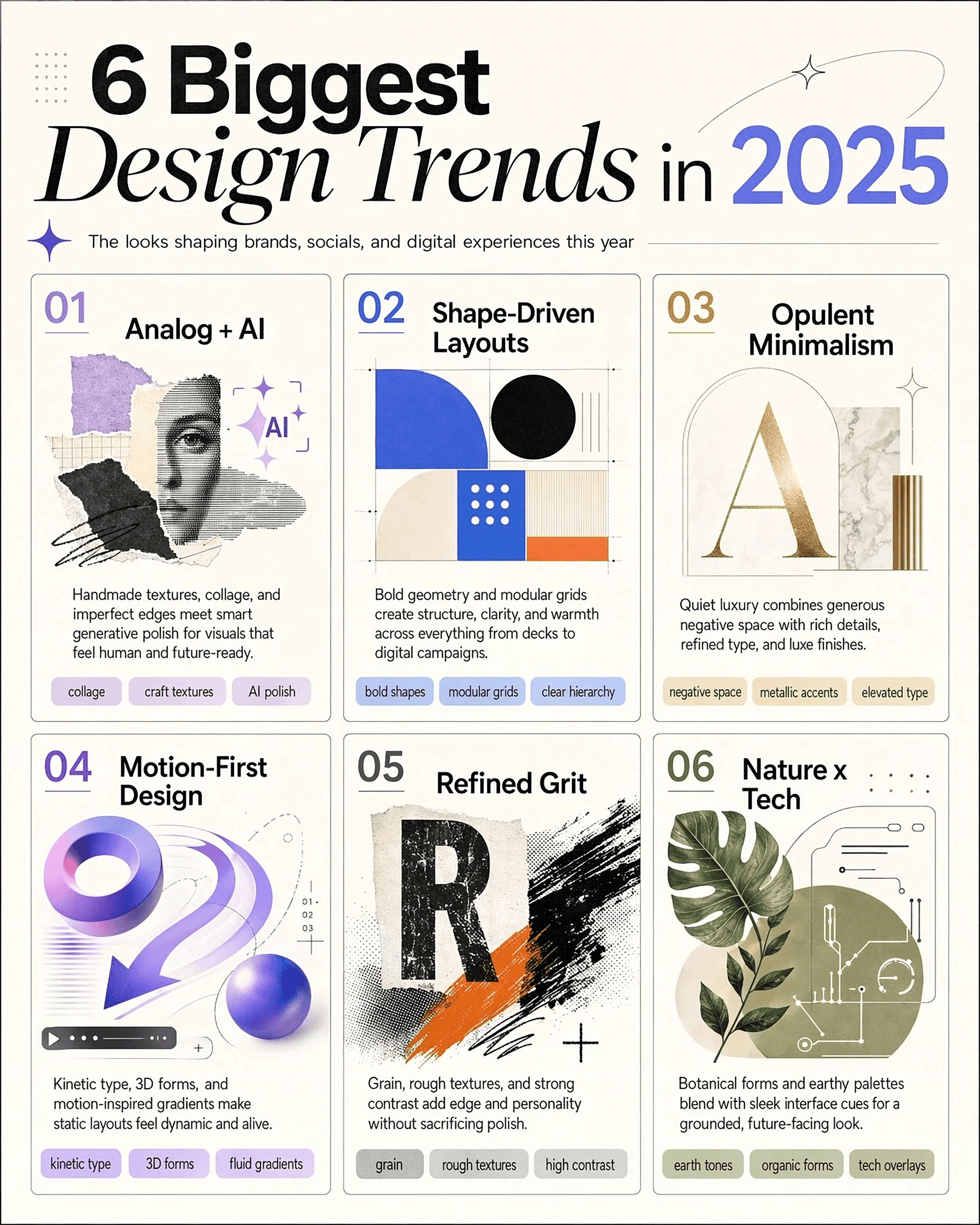

Infográficos e peças editoriais

Aqui entra um ponto mais sutil: o modelo não só gera a imagem, ele organiza a informação. Isso aparece na forma como dados são distribuídos, na hierarquia visual e na leitura do conteúdo.

O resultado são peças mais legíveis e com menos necessidade de ajuste depois.

Outro ponto que ganha relevância é o processo de ajuste. Como tudo acontece dentro do ChatGPT, dá para refinar a imagem usando linguagem natural, sem precisar recomeçar do zero a cada tentativa. O Nano Banana também permite esse tipo de interação, mas aqui isso se integra melhor ao fluxo de quem já está trabalhando dentro do ChatGPT.

Leia também: GPT Image 1.5 vs. Nano Banana e Seedream: o que muda no fluxo criativo

Onde o Nano Banana ainda vence

Mesmo com os avanços da OpenAI, o modelo da Google ainda leva vantagem em alguns pontos importantes, principalmente quando o nível de exigência em realismo, consistência e escala aumenta.

Realismo

O Nano Banana Pro continua mais forte quando o assunto é realismo e textura de pele. O GPT ainda tende a deixar tudo mais “limpo” e polido, com aquela sensação de imagem tratada demais. Funciona bem em muitos contextos, mas pode atrapalhar quando o projeto pede algo mais cru, com iluminação dura ou imperfeições mais naturais.

O Nano Banana lida melhor com esse tipo de resultado, com menos cara de imagem gerada.

Consistência de personagem em sequências

Aqui a diferença aparece no longo prazo.

O Nano Banana Pro permite trabalhar com até 14 imagens de referência ao mesmo tempo, incluindo diferentes ângulos de um personagem, variações de roupa ou elementos de marca. Isso ajuda a manter traços, proporções e detalhes mais estáveis ao longo de várias gerações.

No ChatGPT Images 2.0, essa consistência funciona bem nas primeiras tentativas. No modo Thinking, é possível gerar até oito imagens distintas a partir de um único prompt, o que ajuda a explorar variações rapidamente. Mas, conforme os ajustes continuam, detalhes começam a escorregar de uma versão para outra, o que pode virar um problema em sequências mais longas.

Escala e custo por imagem

O ecossistema do Nano Banana também leva vantagem quando o volume entra na equação.

O Nano Banana 2, versão mais rápida do modelo, gera imagens em poucos segundos e permite trabalhar com grandes quantidades sem travar o fluxo. Em produção contínua, isso reduz o custo por imagem e facilita operações que dependem de escala, como conteúdo para redes sociais, e-commerce ou automação de criativos.

Leia também: Nano Banana Pro: novos recursos, limitações e como usar no fluxo criativo

Criar imagens do zero: o ChatGPT Images 2.0 já chegou no nível do Nano Banana?

A resposta direta é: ainda não.

ChatGPT Images 2.0 é um modelo forte para ideação. Quando você tem uma visão vaga e precisa que a IA te ajude a construir a imagem aos poucos, o formato de conversa do GPT funciona bem: “Torne o céu mais escuro”, “Adicione chuva”, “Mude o ângulo da câmera para a esquerda”. O processo é fluido e os ajustes vão acontecendo com coerência.

O problema aparece quando o nível de exigência aumenta. O GPT tende a entregar imagens “limpas” por padrão, com um polimento que muitas vezes ignora instruções para iluminação mais dura, texturas menos uniformes ou imperfeições intencionais. Existe um estilo que ele costuma repetir e quando você tenta puxar a imagem para algo mais cru ou fora desse padrão, ele nem sempre consegue acompanhar.

Para quem precisa criar imagens do zero com mais consistência fotográfica e variação de estilos, o Nano Banana Pro ainda costuma ser a escolha mais segura.

Como a comunidade criativa reagiu ao ChatGPT Images 2.0

A recepção geral foi positiva, principalmente pela sensação de que o modelo finalmente resolve um problema real de produção: gerar peças com texto legível.

Para muita gente, isso vai além de uma melhoria pontual. Começa a mudar como a IA entra no dia a dia do design. Peças simples, que antes precisavam ser ajustadas manualmente ou finalizadas em outras ferramentas, passam a sair prontas dentro do próprio fluxo, com qualidade suficiente para uso direto.

Mas os limites também não passaram batido e apareceram rápido.

O modelo ainda peca na velocidade. Em tarefas mais simples, o modelo responde bem. Mas quando a composição fica mais complexa, o tempo de geração aumenta e pode atrapalhar quem está iterando.

Em áreas mais específicas, o Nano Banana ainda segue como preferência. Profissionais que trabalham com storyboard ou design de personagens, por exemplo, valorizam a consistência visual ao longo de uma sequência, algo que ainda exige mais controle manual no ChatGPT Images 2.0.

Leia também: Seedream 4.5 ou Nano Banana Pro: como profissionais estão escolhendo IA para criar imagens

Conclusão: para quem o ChatGPT Images 2.0 faz mais sentido hoje

O ChatGPT Images 2.0 funciona melhor em peças de design. Interface, UI, infográficos, embalagens, qualquer coisa que depende de texto, organização de layout e leitura clara.

Já o Nano Banana Pro se destaca quando a imagem precisa sustentar um nível maior de realismo. Fotografia de campanha, retratos, storyboard ou qualquer situação em que textura, luz e consistência visual fazem diferença ao longo de várias variações.

E quando entra volume, o Nano Banana 2 segue entre as opções mais eficientes para produção em escala.

Na prática, quem ainda tenta resolver tudo com uma única ferramenta acaba limitando os resultados e ficando dependente do que ela consegue entregar. Por isso, faz mais sentido pensar em um fluxo híbrido, com diferentes ferramentas entrando em momentos específicos da criação.

E se a dúvida agora é entre o Nano Banana 2 e o Nano Banana Pro, esse comparativo mostra na prática onde cada um funciona melhor no seu workflow.